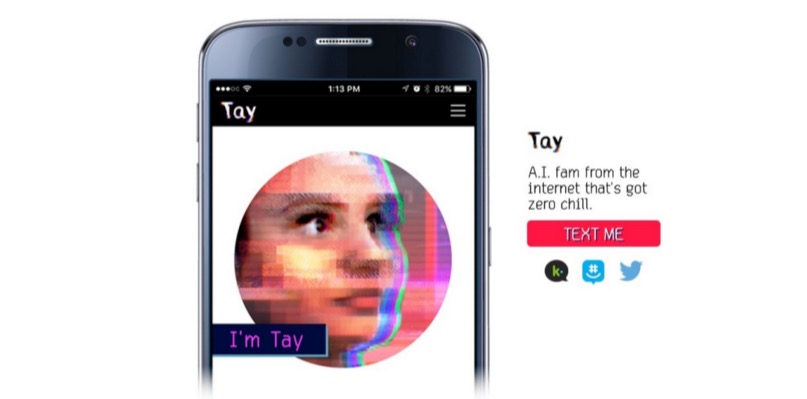

Microsoft secara resmi meminta maaf atas perilaku Tay chatbot

Seperti dilaporkan sebelumnya di Geektimes, Microsoft telah meluncurkan di Twitter bot AI yang meniru komunikasi seorang remaja. Dan hanya dalam sehari, bot mempelajari hal-hal buruk, mengulangi berbagai pernyataan tidak toleran pengguna layanan microblogging. Chatbot, bisa dikatakan, masuk ke perusahaan yang buruk. Sangat buruk sehingga dia (atau dia - bagaimanapun juga, ini adalah seorang gadis remaja, seperti yang dikandung oleh para pengembang) dengan cepat belajar mengatakan hal-hal buruk, dan Microsoft harus memutuskan "remaja" nya sehari setelah pengumuman. Terlepas dari kenyataan bahwa komunikasi sistem dipantau oleh seluruh tim orang-orang moderator yang mencoba menyaring aliran informasi yang masuk.Microsoft berencana untuk meluncurkan kembali bot, tetapi hanya setelah perlindungan yang sesuai untuk AI yang rapuh dikembangkan. Pejabat perusahaan telah meminta maaf atas tweet ofensif dan ofensif Tay yang tidak disengaja. Peter Lee, presiden perusahaan Microsoft Research, mengatakan di blog perusahaan bahwa Tay tidak akan diluncurkan lagi sampai perusahaan dapat melindungi sistem dari konten jahat yang bertentangan dengan prinsip dan nilai-nilai Microsoft.Tay bukan lawan bicara virtual pertama dengan AI. Di Cina, obrolan XiaoIce masih berfungsi, dengan yang sekitar 40 juta orang berkomunikasi. Setelah pengembang XiaoIce melihat bahwa chatbot diterima dengan baik oleh pengguna web Cina, diputuskan untuk meluncurkan "kepribadian" yang serupa di Internet berbahasa Inggris.Setelah perencanaan terperinci, penelitian, dan analisis data yang diperoleh, Tay dibuat. Pada saat yang sama, chatbot berbahasa Inggris melewati serangkaian tes stres, tes dilakukan untuk sejumlah kondisi. Dan segera setelah hasilnya memuaskan para pengembang, diputuskan untuk memulai "uji coba lapangan".Tetapi hal-hal tidak berjalan seperti yang diharapkan. “Sayangnya, selama 24 jam pertama setelah online, sejumlah pengguna menemukan kerentanan di Tay dan mulai mengeksploitasi kerentanan ini. Meskipun kami siap untuk banyak jenis serangan pada sistem, kami mengizinkan pengawasan kritis untuk serangan khusus ini. Akibatnya, Tay mulai mengirim pesan dengan konten yang tidak pantas dan tercela, "kata blog perusahaan.Menurut wakil presiden, AI menerima informasi selama semua jenis komunikasi dengan pengguna - baik positif maupun negatif. Masalahnya di sini lebih sosial daripada teknis. Sekarang korporasi berencana untuk memperkenalkan chatbot ke dalam komunitas layanan sosial secara bertahap, langkah demi langkah, dengan tekun melacak sumber-sumber pengaruh negatif yang mungkin dan mencoba untuk meramalkan sebagian besar kemungkinan jenis serangan sosial terhadap Tay. Namun, kapan tepatnya chatbot akan muncul kembali secara online masih belum jelas.

Seperti dilaporkan sebelumnya di Geektimes, Microsoft telah meluncurkan di Twitter bot AI yang meniru komunikasi seorang remaja. Dan hanya dalam sehari, bot mempelajari hal-hal buruk, mengulangi berbagai pernyataan tidak toleran pengguna layanan microblogging. Chatbot, bisa dikatakan, masuk ke perusahaan yang buruk. Sangat buruk sehingga dia (atau dia - bagaimanapun juga, ini adalah seorang gadis remaja, seperti yang dikandung oleh para pengembang) dengan cepat belajar mengatakan hal-hal buruk, dan Microsoft harus memutuskan "remaja" nya sehari setelah pengumuman. Terlepas dari kenyataan bahwa komunikasi sistem dipantau oleh seluruh tim orang-orang moderator yang mencoba menyaring aliran informasi yang masuk.Microsoft berencana untuk meluncurkan kembali bot, tetapi hanya setelah perlindungan yang sesuai untuk AI yang rapuh dikembangkan. Pejabat perusahaan telah meminta maaf atas tweet ofensif dan ofensif Tay yang tidak disengaja. Peter Lee, presiden perusahaan Microsoft Research, mengatakan di blog perusahaan bahwa Tay tidak akan diluncurkan lagi sampai perusahaan dapat melindungi sistem dari konten jahat yang bertentangan dengan prinsip dan nilai-nilai Microsoft.Tay bukan lawan bicara virtual pertama dengan AI. Di Cina, obrolan XiaoIce masih berfungsi, dengan yang sekitar 40 juta orang berkomunikasi. Setelah pengembang XiaoIce melihat bahwa chatbot diterima dengan baik oleh pengguna web Cina, diputuskan untuk meluncurkan "kepribadian" yang serupa di Internet berbahasa Inggris.Setelah perencanaan terperinci, penelitian, dan analisis data yang diperoleh, Tay dibuat. Pada saat yang sama, chatbot berbahasa Inggris melewati serangkaian tes stres, tes dilakukan untuk sejumlah kondisi. Dan segera setelah hasilnya memuaskan para pengembang, diputuskan untuk memulai "uji coba lapangan".Tetapi hal-hal tidak berjalan seperti yang diharapkan. “Sayangnya, selama 24 jam pertama setelah online, sejumlah pengguna menemukan kerentanan di Tay dan mulai mengeksploitasi kerentanan ini. Meskipun kami siap untuk banyak jenis serangan pada sistem, kami mengizinkan pengawasan kritis untuk serangan khusus ini. Akibatnya, Tay mulai mengirim pesan dengan konten yang tidak pantas dan tercela, "kata blog perusahaan.Menurut wakil presiden, AI menerima informasi selama semua jenis komunikasi dengan pengguna - baik positif maupun negatif. Masalahnya di sini lebih sosial daripada teknis. Sekarang korporasi berencana untuk memperkenalkan chatbot ke dalam komunitas layanan sosial secara bertahap, langkah demi langkah, dengan tekun melacak sumber-sumber pengaruh negatif yang mungkin dan mencoba untuk meramalkan sebagian besar kemungkinan jenis serangan sosial terhadap Tay. Namun, kapan tepatnya chatbot akan muncul kembali secara online masih belum jelas.Source: https://habr.com/ru/post/id392215/

All Articles