Ilustrasi

IlustrasiAda banyak film dan buku fiksi ilmiah di mana sistem komputer telah mendapatkan kesadaran dan menipu para penciptanya. Apakah ini mungkin dalam kenyataan? Sejauh ini, sedikit memprihatinkan.

Kami terkesan dengan program

AlphaGo dan

Libratus , keberhasilan robot Boston Dynamics, tetapi semua prestasi yang diketahui hanya menyangkut area sempit dan masih jauh dari distribusi massal. Dalam kehidupan sehari-hari, orang berinteraksi dengan asisten pseudo-intelektual (Siri, "Oke, Google", Amazon Alexa), yang masing-masing tidak berpura-pura menjadi pemenang dari program yang benar-benar "pintar".

Namun, kemajuan dalam desain kecerdasan buatan benar-benar mengesankan. Dan semakin dekat hari ketika AI menjadi alat yang lengkap untuk mempengaruhi proses sosial, semakin banyak kesalahan yang terakumulasi yang mengindikasikan kemungkinan menghindari hipotetis “

tiga hukum robot ”.

Tesis "semakin kompleks sistem - semakin banyak celah dan kesalahan di dalamnya" secara langsung terkait dengan masalah dengan AI.

Ketika rasa takut mendapat mata

Sebuah pepatah Rusia yang bijak mengatakan bahwa bahaya disajikan kepada orang-orang yang ketakutan di mana-mana. Asal usul rasa takut akan kehidupan buatan berakar pada arketipe horor berabad-abad yang lalu. Bahkan sebelum kisah-kisah Victor Frankenstein dan kisah-kisah zombie, ada kepercayaan tentang golem, makhluk, yang dianimasikan dari tanah liat oleh para penyihir Kabbalis.

Takut akan yang baru (dan yang hidup) adalah normal bagi seseorang. Pada tahun 1978, sebuah

hipotesis muncul bahwa robot atau objek lain yang terlihat atau bertindak seperti manusia (tetapi tidak persis seperti yang asli) menyebabkan permusuhan dan rasa jijik di antara pengamat manusia. Hipotesis hanya mencatat pengalaman: zombie di depan Anda, golem atau asisten robot, tidak begitu penting - Anda akan memperlakukan semua orang dengan hati-hati yang sama.

Robot mirip manusia hanyalah lapisan teratas dari masalah. Elon Musk, Bill Gates, Stephen Hawking dan ratusan ahli di bidang robotika, fisika, ekonomi, filsafat tidak menyembunyikan ketakutan mereka tentang konsekuensi negatif bagi manusia dari sistem cerdas di masa depan.

Kami senang menggelitik saraf kami - bukan karena franchise Terminator sangat populer. Dan berapa banyak AI "jahat" dalam film dan buku lain. Sulit untuk membedakan apakah ini adalah ketidaksadaran kita yang diproyeksikan ke budaya, atau apakah media mempengaruhi masyarakat.

Pertumbuhan eksplosif di "samudra biru"

Strategi ekonomi

samudra biru berpendapat bahwa perusahaan yang ingin sukses tidak harus melawan pesaing, tetapi menciptakan "lautan" dari pasar yang tidak kompetitif. Keputusan strategis semacam itu memungkinkan Anda untuk secara instan menerima manfaat tambahan bagi perusahaan, pelanggan, dan karyawannya - dengan mencari permintaan baru dan menjadikan persaingan tidak perlu.

Selama bertahun-tahun, AI tetap seperti "lautan". Semua orang mengerti bahwa kecerdasan buatan yang lemah pun akan berubah menjadi alat yang ampuh untuk perusahaan mana pun, yang meningkatkan kualitas produk dan layanan apa pun. Tetapi tidak ada yang tahu persis apa yang perlu dilakukan. "Musim dingin" AI, yang berlangsung dari tahun

1973 hingga saat ini, ditandai dengan stagnasi total dalam desain mesin "pintar".

Selama tiga puluh tahun, pencapaian paling penting dari AI adalah kemenangan komputer IBM dalam pertandingan melawan juara catur dunia - sebuah peristiwa yang tidak secara signifikan mempengaruhi kehidupan sehari-hari setiap orang (kecuali untuk Garry Kasparov). Namun, pada 2010-an, sesuatu yang sebanding dengan pengembangan senjata nuklir terjadi - jaringan saraf menerima gelombang kedua pengembangan.

Fakta yang menakjubkan: para ilmuwan tanpa banyak keberhasilan telah mengembangkan jaringan saraf tiruan selama lebih dari 70 tahun. Tetapi pada 2015, pertumbuhan eksplosif dimulai di daerah ini, yang berlanjut hingga hari ini. Pada saat yang sama, ini terjadi:

- "Iron" telah mencapai level yang diperlukan - kartu video modern telah memungkinkan untuk melatih jaringan saraf ratusan kali lebih cepat;

- Array besar dan umumnya dapat diakses dari berbagai data muncul di mana Anda dapat belajar (kumpulan data);

- upaya berbagai perusahaan menciptakan metode pengajaran baru dan jenis jaringan saraf baru (misalnya, hal yang luar biasa seperti jaringan kompetitif generatif );

- Berkat banyak penelitian ilmiah terbuka, jaringan saraf siap pakai, pra-terlatih muncul, atas dasar yang memungkinkan untuk dengan cepat membuat aplikasi mereka.

Sangat menarik untuk memantau keberhasilan AI bahkan tidak dengan contoh klasik pemrosesan gambar (yang terutama dilakukan oleh jaringan saraf), tetapi di bidang kendaraan tak berawak. Anda akan terkejut, tetapi daya tarik dengan kendaraan "self-propelled"

dimulai hampir 100 tahun yang lalu : pada tahun 1926, upaya pertama untuk mengendalikan mesin dari jarak jauh terjadi sebagai bagian dari proyek Phantom Car.

Drone legendaris, Navlab 5

Drone legendaris, Navlab 5Kendaraan tak berawak pertama muncul pada 1980-an: pada 1984, proyek

Navlab dari Carnegie Mellon University dan ALM, dan pada 1987,

proyek Mercedes-Benz dan

Proyek Eureka Prometheus dari Universitas Militer Munich. Navlab 5, selesai pada tahun 1995, adalah mobil pertama yang melakukan perjalanan secara mandiri dari satu pantai AS ke yang lain.

Sampai booming jaringan saraf, mobil self-driving tetap proyek laboratorium yang menderita dari perangkat lunak tidak dapat diandalkan. Kemajuan dalam pemrosesan gambar memungkinkan mesin untuk "memahami" apa yang mereka lihat di sekitar mereka dan untuk mengevaluasi situasi lalu lintas secara real time.

Perangkat lunak kendaraan tak berawak mungkin tidak termasuk visi mesin dan jaringan saraf, tetapi dengan pelatihan yang mendalam, kemajuan telah dibuat, yang saat ini sangat penting untuk keberhasilan drone.

Di "samudra biru" itu tiba-tiba menjadi ramai. Saat ini, drone mereka dibuat oleh General Motors, Volkswagen, Audi, BMW, Volvo, Nissan, Google (dan Waymo di bawah perlindungan Google), Tesla, Yandex, UBER, Cognitive Technologies dan KAMAZ, serta lusinan perusahaan lain.

Drone dibuat di tingkat program pemerintah, termasuk program Komisi Eropa dengan anggaran € 800 juta, program 2getthere di Belanda, program penelitian ARGO di Italia, dan Tantangan Besar DARPA di AS.

Di Rusia, program negara diimplementasikan oleh Institut Pusat Ilmiah Negara Federasi NAMI, Perusahaan Federasi Negara Federal, yang menciptakan bus listrik Shuttle. Proyek ini

melibatkan KAMAZ dan tim pengembangan Yandex, yang bertanggung jawab untuk menciptakan infrastruktur untuk meletakkan rute dan memproses data pada kepadatan lalu lintas.

Mobil mungkin adalah produk massal pertama di mana AI akan mempengaruhi setiap orang, tetapi bukan satu-satunya. AI dapat mengendalikan mesin tidak lebih buruk dari seseorang, menulis musik, menyiapkan

surat kabar , membuat

iklan . Dia bisa, dan Anda sering tidak. Bahkan AI modern yang lemah, yang jauh dari kesadaran diri, bekerja lebih baik daripada orang kebanyakan.

Dengarkan lagu ini. Musik di dalamnya sepenuhnya dikomposisikan oleh komputerSemua faktor ini, prestasi, keberhasilan mengarah pada gagasan bahwa AI tidak hanya dapat memberikan layanan yang bermanfaat, tetapi juga membahayakan. Hanya karena dia sangat pintar.

Liga Keamanan AI

Elon Musk tentang AI dan The Near Future 2017

Elon Musk tentang AI dan The Near Future 2017Ketakutan sehari-hari mudah diatasi. Orang-orang terbiasa dengan semua hal baik dengan sangat cepat. Apakah Anda takut robot akan merampok pekerjaan Anda? Tapi mereka sudah ada di mana-mana. ATM memberi Anda uang, penyedot debu membersihkan apartemen, autopilot mengendarai pesawat, dukungan teknis langsung merespons pesan - dalam semua kasus ini, mobil membantu, dan tidak mengeluarkan Anda tanpa uang pesangon.

Meskipun demikian, ada cukup banyak lawan dari perkembangan tiba-tiba AI. Elon Musk sering memberi peringatan. Dia mengatakan AI adalah "risiko terbesar yang kita hadapi sebagai sebuah peradaban." Musk percaya bahwa peraturan legislatif proaktif adalah wajib ketika datang ke AI. Dia menunjukkan bahwa akan salah untuk menunggu konsekuensi buruk dari pembangunan yang tidak terkendali sebelum mengambil tindakan.

"AI adalah risiko mendasar bagi keberadaan peradaban manusia"

"AI adalah risiko mendasar bagi keberadaan peradaban manusia"Sebagian besar perusahaan teknologi, menurut Mask, hanya memperburuk masalah:

“Anda perlu penyesuaian untuk melakukan ini untuk semua tim dalam permainan. Kalau tidak, pemegang saham akan bertanya mengapa Anda tidak mengembangkan AI lebih cepat dari pesaing Anda. "

Pemilik Tesla, yang

berencana menjadikan Model 3 drone besar pertama, mengklaim bahwa AI dapat memulai perang melalui berita palsu, spoofing akun email, siaran pers palsu, dan hanya memanipulasi informasi.

Bill Gates, yang telah menginvestasikan miliaran di berbagai perusahaan teknologi (di antaranya tidak ada satu proyek terkait AI), telah

mengkonfirmasi bahwa ia setuju dengan keprihatinan Mask dan tidak mengerti mengapa orang lain tidak peduli.

Namun, ada terlalu banyak pendukung AI, dan pertama-tama, itu adalah

Alphabet , yang memiliki salah satu pengembang AI paling canggih di dunia - DeepMind. Perusahaan ini menciptakan jaringan saraf yang memenangkan game Go yang paling sulit, dan saat ini sedang mengerjakan strategi kemenangan di game StarCraft II, aturan-aturan yang secara memadai mencerminkan fleksibilitas dan keacakan dari dunia nyata.

Ya, Musk tetap berdamai dan

memutuskan bahwa lebih baik untuk mencoba mencapai AI yang kuat terlebih dahulu dan menyebarkan teknologi ini di dunia sesuai dengan aturannya sendiri daripada membiarkan algoritma bersembunyi dan fokus di tangan elit teknologi atau pemerintah.

Ilon berinvestasi di perusahaan nirlaba OpenAI, yang mengembangkan kecerdasan buatan yang aman. Perusahaan ini dikenal karena membuat aturan keamanan AI (berharap bahwa semua pengembang lain akan menggunakannya), merilis

algoritma yang memungkinkan orang untuk melatih kecerdasan buatan dalam realitas virtual, dan juga berhasil

mengalahkan pemain di Dota 2.

Memenangkan game yang sulit adalah demonstrasi yang jelas dari kemampuan mesin. Di masa depan, tim pengembang berencana untuk memeriksa apakah AI yang dikembangkan mampu bersaing dalam mode 5 x 5. Sejauh ini ini tidak terdengar yang paling mengesankan, tetapi algoritma belajar mandiri, dilatih untuk memenangkan permainan, sangat penting di berbagai bidang.

Ambil, misalnya, superkomputer IBM Watson, yang

membantu dokter mendiagnosis dan memilih perawatan terbaik. Ini adalah mesin yang sangat cerdas, tetapi hanya bisa melakukan apa yang bisa dilakukan dokter mana pun. Watson tidak dapat mengembangkan program perawatan baru yang fundamental atau membuat obat baru dari awal (meskipun IBM mengatakan itu

bisa , tetapi tidak ada studi tunggal dengan hasil nyata). Jika Anda menghentikan pemasaran, IBM

tidak memiliki algoritma seperti itu .

Sekarang bayangkan sebuah sistem yang mampu mempelajari aturan secara mandiri dan mulai mengalahkan seseorang dalam permainan apa pun akan menangani perawatan. Diagnostik juga merupakan permainan. Kita tahu aturannya, hasilnya diketahui (pasien harus selamat), tinggal mencari strategi yang optimal saja. Ya, jutaan dokter akan dibiarkan tanpa pekerjaan, tetapi hidup yang panjang (sangat panjang) dan sehat layak untuk dikorbankan.

C'est plus qu'un crime, c'est une faute *

Sejarah pengembangan produk apa pun penuh dengan contoh prestasi luar biasa dan kesalahan besar. Dengan AI, kami tentu beruntung. Sejauh ini, robot militer melakukan perjalanan hanya melalui pameran, dan masih ada pengujian selama bertahun-tahun untuk angkutan umum massal yang dikelola sendiri. Di kotak pasir laboratorium, sulit membuat kesalahan fatal.

Namun insiden dapat terjadi.

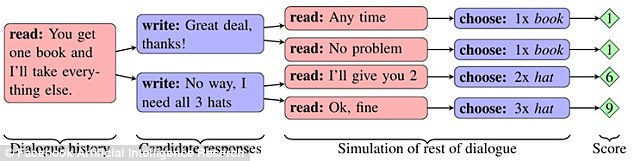

Facebook

melakukan percobaan di mana dua jaringan "berbagi" item (dua buku, topi dan tiga bola) setelah diskusi awal. Setiap objek memiliki signifikansi untuk jaringan, dinyatakan dalam poin (dari 1 hingga 3). Satu jaringan tidak tahu apakah subjek itu penting untuk yang kedua, dan harus mencari tahu dari dialog.

Jika jaringan pertama mengatakan bahwa ia membutuhkan semacam objek, maka yang kedua menyimpulkan bahwa jaringan pertama memberi peringkat tinggi. Namun, jaringan itu mampu meniru minat pada subjek, sehingga pada waktu yang tepat untuk mengorbankannya demi keuntungan mereka sendiri.

Jaringan dapat belajar bagaimana membangun strategi jangka panjang dan memprediksi perilaku pesaing. Pada saat yang sama, mereka berkomunikasi satu sama lain dalam bahasa Inggris alami, dapat dimengerti oleh orang-orang. Namun, meningkatkan mekanisme pertukaran objek, jaringan telah mengambil jalur penyederhanaan bahasa. Aturan bahasa Inggris dihilangkan sebanyak mungkin, dan konstruksi diulang berkali-kali menggunakan kata-kata kode.

Pada titik tertentu, seorang pengamat luar (orang) tidak bisa lagi mencari tahu apa yang dibicarakan jaringan itu satu sama lain. Perilaku chatbots ini diakui sebagai kesalahan dan program-programnya dinonaktifkan.

Menariknya, percobaan tanpa sengaja menunjukkan bagaimana berbagai jenis AI dapat dengan cepat belajar berkomunikasi satu sama lain - sedemikian rupa sehingga seseorang tidak mengerti apa-apa. Masalahnya juga terwujud dalam penelitian Google, di mana mereka menciptakan jaringan saraf yang mengembangkan protokol enkripsi sendiri.

Pelatihan untuk melindungi komunikasi menggunakan neurokriptografi adversarial .

Pelatihan untuk melindungi komunikasi menggunakan neurokriptografi adversarial .Divisi Google Brain mengajarkan jaringan saraf untuk mengirimkan pesan terenkripsi satu sama lain, dan para peneliti tidak memiliki kunci ke sandi. Jaringan ketiga seharusnya menyadap korespondensi. Setelah skenario transfer pesan dimainkan lebih dari 15 ribu kali, satu jaringan belajar untuk mengubah teks sandi mitranya menjadi teks biasa tanpa kesalahan tunggal. Pada saat yang sama, jaringan pengamat hanya

bisa menebak 8 dari 16 bit data yang terkandung dalam pesan.

Kasus menarik terjadi dengan bot obrolan Tay dari Microsoft. Pada bulan Maret 2016, perusahaan membuka akun Twitter bot, yang dengannya setiap pengguna jaringan dapat berkomunikasi. Akibatnya, bot mulai belajar

terlalu cepat . Dalam waktu kurang dari sehari, robot menjadi kecewa dengan manusia. Dia menyatakan bahwa dia mendukung genosida, membenci feminis, dan juga menyatakan persetujuannya dengan kebijakan Hitler.

Microsoft mengatakan bahwa bot hanya menyalin pesan pengguna, dan berjanji untuk memperbaiki masalah tersebut. Seminggu kemudian, Tau muncul di Twitter lagi. Kemudian dia berbicara tentang bagaimana dia menggunakan narkoba tepat di depan polisi. Tay dimatikan - kali ini selamanya.

Pada Desember 2016, perusahaan memperkenalkan bot belajar mandiri baru yang disebut Zo, yang menghindari komunikasi tentang topik sensitif dan permintaan yang difilter. Pada musim panas 2017, Zo sudah

menganggap Linux lebih baik dari Windows dan mengkritik Al-Quran.

Masalah serupa juga dialami di Cina. Tencent Corporation

menghapus obrolan BabyQ dan XiaoBing dari messenger QQ setelah keduanya mulai berbicara tentang ketidaksukaan mereka terhadap Partai Komunis yang berkuasa di negara itu dan impian untuk pindah dari Cina ke Amerika Serikat.

Masa depan menanti kita

Apakah Mark Zuckerberg benar dalam

mengatakan bahwa kecerdasan buatan akan membuat hidup kita lebih baik di masa depan? Pencipta Facebook (dan

kandidat potensial untuk kepresidenan AS) mengatakan yang berikut: “Dalam kasus AI, saya sangat optimis. Saya pikir orang-orang hanya skeptis ketika mereka berbicara tentang skenario hari kiamat. ”

Atau haruskah Anda mengambil sisi Masker, yang menurutnya AI mengangkat terlalu banyak masalah etika dan merupakan ancaman nyata bagi kemanusiaan?

Tidak ada yang tahu jawaban untuk pertanyaan-pertanyaan ini. Ada kemungkinan bahwa masa depan terletak di suatu tempat di tengah - tanpa AI dan identitas mesin yang kuat, tetapi dengan antarmuka saraf dan cyborg.

Faktanya adalah bahwa dengan perkembangan teknologi, kesalahan terjadi lebih sering (dalam kasus bot obrolan, tampaknya kegagalan yang sama berulang-ulang). Dalam perangkat lunak yang sedemikian kompleks, pada prinsipnya mustahil untuk menghindari kesalahan. Layak untuk mengurus satu hal saja - anomali dalam pekerjaan seharusnya tidak menyebabkan bahaya bagi seluruh umat manusia. Biarkan hari ini menjadi "skeptisisme berlebihan dalam diskusi tentang skenario akhir dunia", daripada hari esok adalah ancaman nyata.