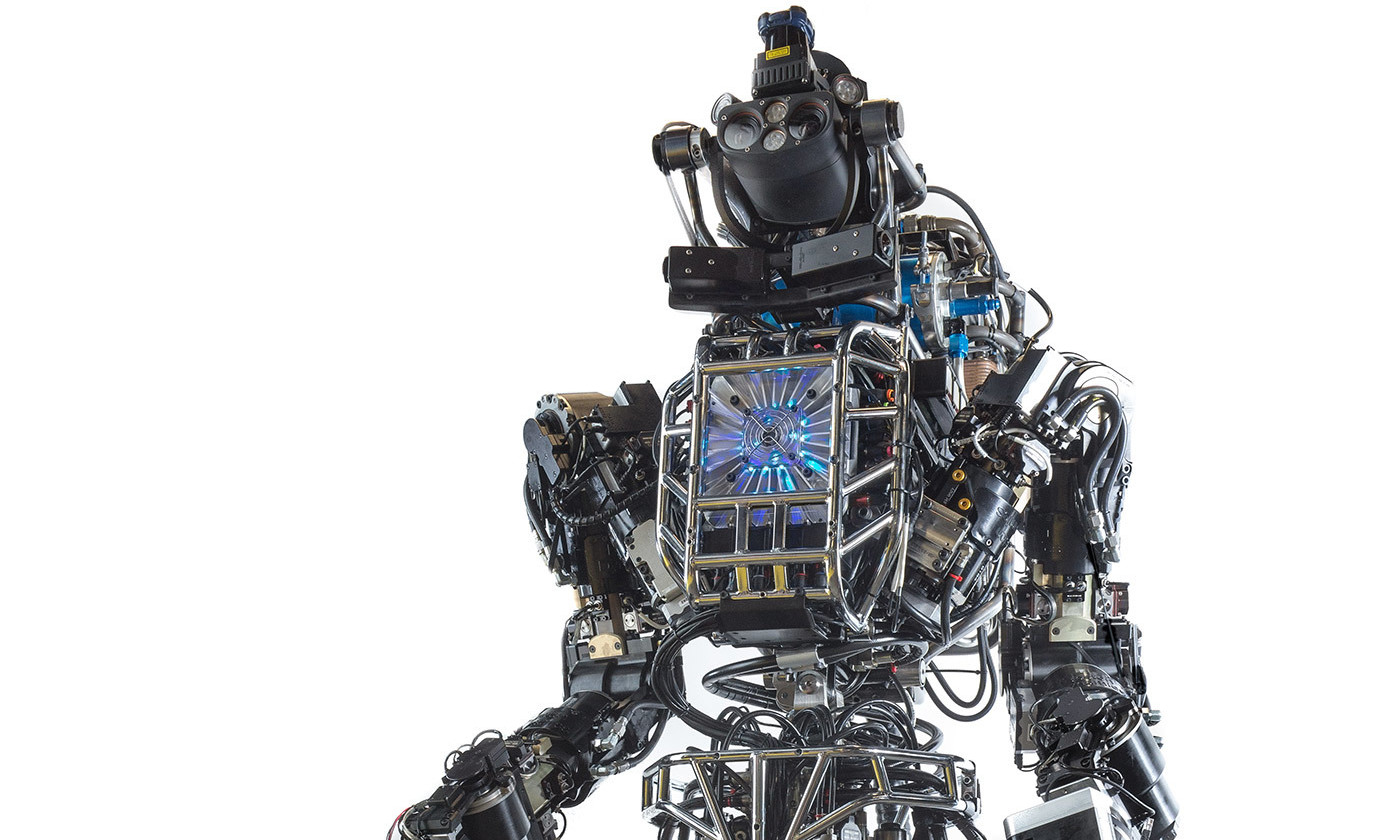

Senjata otonom - robot pembunuh yang dapat menyerang tanpa campur tangan manusia - ini adalah alat yang sangat berbahaya. Tidak ada keraguan tentang ini. Sebagaimana dinyatakan dalam

surat terbuka untuk PBB, Ilon Musk, yang menandatangani di bawahnya, Mustava Suleiman [

salah satu pendiri perusahaan AI DeepMind / approx. perev. ] dan penulis lain, senjata otonom dapat menjadi "senjata intimidasi, senjata yang dapat digunakan para tiran dan teroris terhadap populasi yang tidak bersalah, senjata yang dapat diretas dan dibuat untuk bekerja dengan cara yang tidak diinginkan."

Tetapi ini tidak berarti bahwa PBB harus memberlakukan larangan preventif pada penelitian lebih lanjut dari senjata-senjata tersebut, seperti yang didesak oleh penulis surat tersebut.

Pertama, terkadang alat berbahaya dibutuhkan untuk mencapai tujuan yang layak. Ingat

genosida di Rwanda ketika dunia berdiri dan tidak melakukan apa-apa. Jika senjata otonom ada pada tahun 1994, mungkin kita tidak akan melihat ke samping. Tampaknya jika biaya intervensi kemanusiaan hanya dapat diukur dengan uang, akan lebih mudah untuk mendapatkan dukungan publik untuk intervensi tersebut.

Kedua, naif untuk percaya bahwa kita dapat menikmati manfaat dari terobosan baru-baru ini dalam AI tanpa harus mengalami beberapa kekurangan mereka. Misalkan PBB memberlakukan larangan preventif terhadap teknologi senjata otonom. Kami juga berasumsi - sudah cukup optimis - bahwa semua pasukan dunia akan menghormati larangan ini dan membatalkan pengembangan program senjata otonom. Dan bahkan kemudian, kita masih harus khawatir tentang ini. Robomobile dapat dengan mudah diubah menjadi sistem senjata otonom: alih-alih berkeliling pejalan kaki, Anda dapat mengajarkannya untuk memindahkan mereka.

Secara umum, teknologi AI sangat berguna dan sudah menembus kehidupan kita, bahkan jika kadang-kadang kita tidak melihat ini dan tidak dapat sepenuhnya menyadarinya. Mengingat penetrasi ini, akan menjadi pandangan pendek untuk berpikir bahwa penyalahgunaan teknologi bisa dilarang hanya dengan melarang pengembangan senjata otonom. Mungkin justru sistem senjata otonom yang canggih dan selektif yang dikembangkan oleh berbagai pasukan di seluruh dunia yang dapat secara efektif melawan senjata otonom yang lebih kasar yang mudah dikembangkan dengan memprogram ulang teknologi AI yang tampaknya damai, seperti robomobiles yang sama.

Selain itu, gagasan larangan sederhana di tingkat internasional memberikan pendekatan yang terlalu disederhanakan untuk pertimbangan senjata otonom. Konsep semacam itu tidak mengakui sejarah panjang dari sebab dan akibat dari tindakan dan kesepakatan dari berbagai negara di antara mereka sendiri dan sendiri, yang, melalui ribuan tindakan kecil dan kelalaian, mengarah pada pengembangan teknologi tersebut. Sementara perdebatan tentang senjata otonom dilakukan terutama di tingkat PBB, rata-rata warga negara, tentara atau programmer dapat dimaafkan karena tidak menyiratkan kewajiban moral untuk kerusakan yang disebabkan oleh senjata otonom. Tetapi ini adalah asumsi yang sangat berbahaya, yang dapat menyebabkan bencana.

Semua orang yang entah bagaimana terkait dengan teknologi senjata otomatis harus berhati-hati karena kita masing-masing, dan kita masing-masing harus dengan hati-hati memikirkan apa kontribusi tindakan atau kelambanannya terhadap daftar potensi bahaya dari teknologi ini. Ini tidak berarti bahwa negara dan lembaga internasional tidak memiliki peran penting mereka. Ini menggarisbawahi fakta bahwa jika kita ingin menghilangkan potensi bahaya senjata otomatis, maka kita perlu mempromosikan etika tanggung jawab pribadi, dan propaganda ini harus mencapai tingkat terendah di mana keputusan dibuat. Untuk mulai dengan, sangat penting untuk berbicara secara rinci dan sepenuhnya tentang pengembangan senjata otonom - termasuk konsekuensi dari tindakan semua orang yang membuat keputusan di semua tingkatan.

Akhirnya, kadang-kadang diperdebatkan bahwa senjata otonom berbahaya bukan karena alat ini berbahaya, tetapi karena dapat mandiri dan mulai bertindak untuk kepentingannya sendiri. Ini adalah kesalahan yang salah, dan selain itu, larangan pengembangan senjata otonom tidak akan membantu mencegah bahaya ini. Jika kecerdasan super merupakan ancaman bagi umat manusia, kami sangat perlu mencari cara untuk secara efektif melawan ancaman ini, dan melakukannya terlepas dari apakah teknologi senjata otomatis akan dikembangkan lebih lanjut.

Surat terbuka untuk Konvensi PBB tentang Senjata Konvensional Tertentu

Karena beberapa perusahaan menciptakan teknologi yang terkait dengan kecerdasan buatan dan robotika yang dapat diarahkan ke pengembangan senjata otonom, kami merasakan tanggung jawab khusus untuk meningkatkan alarm ini. Kami dengan hangat menyambut keputusan konferensi PBB tentang adopsi "Konvensi tentang jenis senjata konvensional" tentang penunjukan

sekelompok ahli pemerintah (Kelompok Ahli Pemerintah, GGE) tentang sistem senjata otonom yang mematikan. Banyak peneliti dan insinyur kami siap memberikan saran teknologi untuk membantu masalah ini.

Kami menyambut penunjukan Duta Besar Amandip Singh Gill dari India sebagai Ketua GGE. Kami meminta Para Pihak Penandatanganan Tinggi yang berpartisipasi dalam GGE untuk secara aktif bekerja dalam menemukan cara untuk mencegah perlombaan senjata semacam ini, melindungi warga negara dari penyalahgunaan mereka, dan menghindari efek destabilisasi dari teknologi ini. Kami menyesal bahwa pertemuan GGE pertama, yang dijadwalkan untuk Agustus 2017, dibatalkan karena fakta bahwa beberapa negara tidak memberikan kontribusi keuangan kepada PBB. Kami mendesak Para Pihak Tinggi untuk melipatgandakan upaya mereka pada pertemuan GGE pertama yang akan diadakan pada bulan November.

Senjata otonom yang terperinci mengancam akan membawa revolusi ketiga dalam urusan militer. Setelah perkembangannya, akan memungkinkan untuk melakukan konflik militer pada skala yang belum pernah terjadi sebelumnya, dan pada periode waktu yang lebih pendek dari apa yang dapat dirasakan seseorang. Ini bisa menjadi senjata intimidasi, senjata yang dapat digunakan tiran dan teroris terhadap populasi yang tidak bersalah, senjata yang bisa diretas dan dibuat untuk bekerja dengan cara yang tidak diinginkan. Kami memiliki sedikit waktu tersisa. Setelah membuka kotak Pandora ini, akan sulit untuk menutupnya. Oleh karena itu, kami meminta Para Pihak Penandatanganan Tinggi untuk menemukan cara untuk melindungi kita semua dari ancaman ini.