Ilmu pengetahuan populer dan bahkan media hiburan saat ini penuh dengan berita tentang keberhasilan proyek AI. Entah kecerdasan buatan mengalahkan seseorang, atau belajar bermain StarCraft dan muncul sebagai pemenang dari pertarungan dengan juara yang diakui. Dan ini hanya sebagian kecil dari pencapaian, pada kenyataannya, ada banyak lagi. Orang biasa (dalam arti tertentu, tidak terkait dengan bidang TI) mungkin berpikir bahwa kecerdasan buatan "besar" akan segera muncul, tentang yang saya tulis fiksi ilmiah dan membuat film.

Tapi semuanya jauh dari cerah. Sebagai contoh, tempo hari ada informasi bahwa AI mencoba untuk lulus tes dalam matematika yang lebih tinggi (tes sekolah, standar untuk Inggris) dan tidak dapat melakukannya.

Pada prinsipnya, penyebab kegagalan dapat dijelaskan tanpa banyak kesulitan. Jadi, seseorang dalam memecahkan masalah matematika melibatkan kemampuan dan kemampuan berikut.

Itu memodifikasi untuk dirinya sendiri simbol pada dasarnya, seperti angka, operator aritmatika, variabel (yang membentuk fungsi dalam kompleks) dan kata-kata (mendefinisikan pertanyaan, makna tugas, dll).

- Perencanaan (misalnya, fungsi peringkat dalam urutan yang diperlukan untuk menyelesaikan masalah matematika).

- Menggunakan algoritma bantu untuk menyusun fungsi (penambahan, perkalian).

- Menggunakan memori jangka pendek untuk menyimpan nilai perantara (mis. H (f (x))).

- Menerapkan praktik sebelumnya memperoleh pengetahuan tentang aturan, transformasi, proses, dan aksioma.

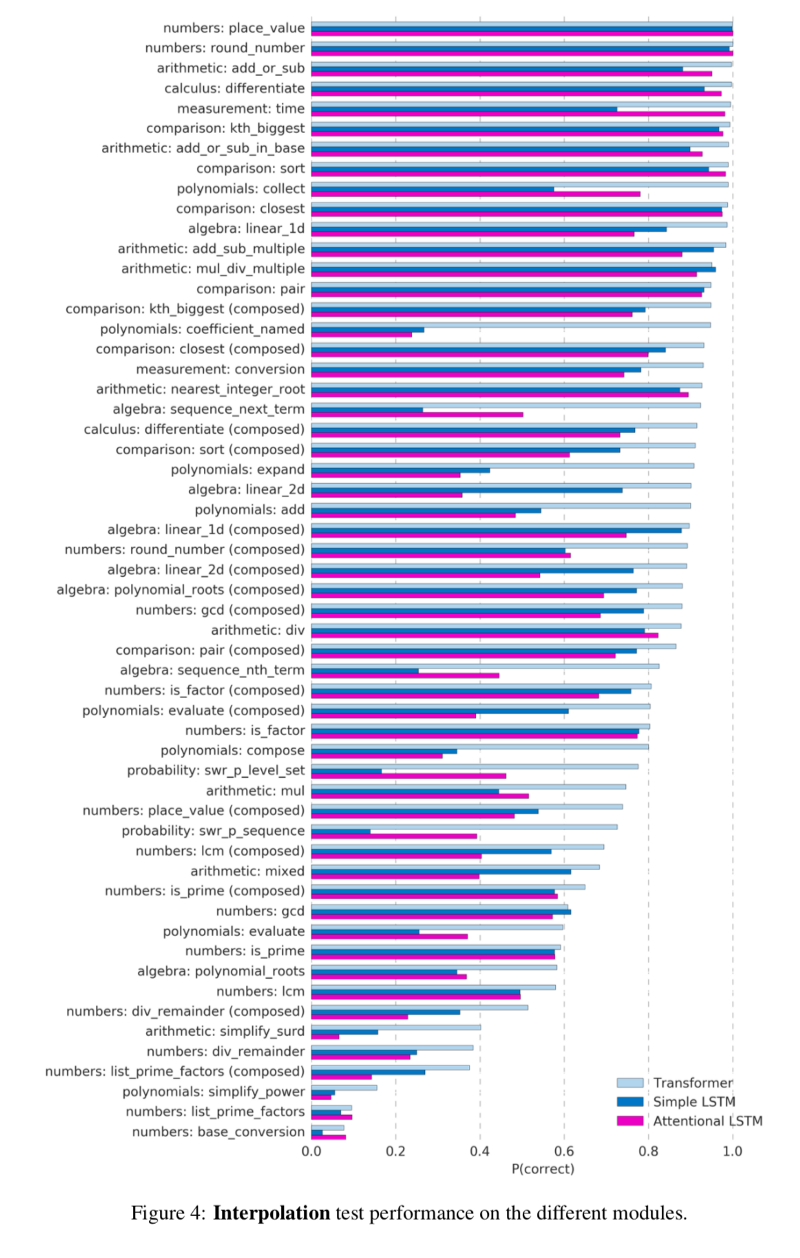

DeepMind dilatih dan diuji pada berbagai jenis masalah dan masalah matematika. Para pengembang tidak menggunakan crowdsourcing, melainkan, mereka mensintesis satu set data untuk menghasilkan sejumlah besar tugas pengujian, mengendalikan kompleksitasnya, dll. Tim pengembangan menggunakan format data teks "bentuk bebas".

Data awal didasarkan pada tugas dari pemilihan tugas untuk siswa di sekolah UK (di bawah 16 tahun). Tugas-tugas diambil dari arah seperti aritmatika, aljabar, teori probabilitas, dll.

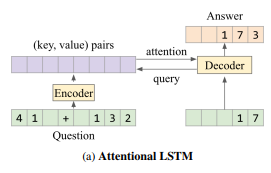

Tim DeepMind, memilih arsitektur jaringan saraf untuk menyelesaikan masalah matematika, memilih LSTM (

memori jangka pendek jangka panjang ) dan

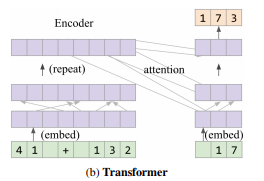

Transformer (arsitektur jaringan saraf untuk bekerja dengan urutan).

DeepMind menguji dua model LSTM untuk bekerja dengan masalah matematika: LSTM sederhana dan LSTM Attentional yang skema operasinya ditunjukkan pada gambar di bawah ini.

Di bawah ini adalah diagram dari model Transformer.

Hasilnya tidak terlalu bagus. Hanya 35% jawaban AI yang benar, ini adalah penilaian yang tidak memuaskan menurut standar sekolah mana pun.

Tentu saja, para peneliti dari DeepMind baru saja mulai bekerja dengan matematika dan AI. Di masa depan, kesuksesan yang lebih besar dapat diharapkan, seperti halnya dengan AlphaGo yang sama.

Data studi lengkap dapat ditemukan di

tautan ini .