Programa de previsão de crimes acusado de racismo

, . ,

. 2014

400 . ,

( 70% 2016 , ).

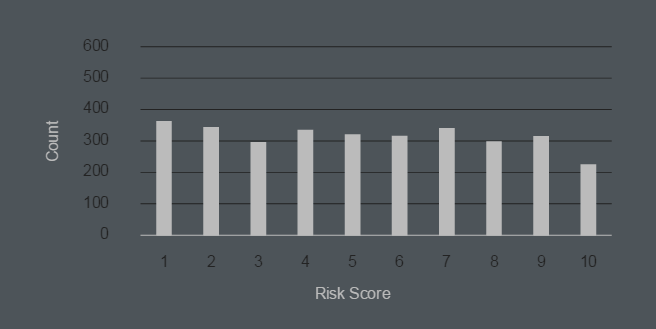

Recentemente, programas analíticos começaram a ser usados nos tribunais. O juiz deve determinar se deve punir o infrator na severidade mínima ou máxima prescrita por lei para um crime específico. Nesse caso, o programa calcula a chamada "pontuação da avaliação de risco" com base nos dados disponíveis. Este indicador determina a probabilidade de repetição do crime e, consequentemente, afeta a gravidade da sentença.Portanto, uma análise completa dos resultados do programa pelo ProPublica, revelou uma tendência estranha: por alguma razão, para afro-americanos (negros), o programa atribui uma classificação de risco mais alta do que para brancos. Em outras palavras, o algoritmo exibe discriminação racial! E isso apesar do fato de esse programa ter sido especificamente introduzido no sistema judicial precisamente para excluir essa discriminação.Um indicador de avaliação de risco é muito importante. Isso afeta a gravidade da sentença, o tamanho do montante sob o qual o suspeito é libertado sob fiança, bem como a escolha de uma medida preventiva e muito mais.Os repórteres do ProPublica analisaram mais de 7.000 casos no Condado de Broward, Flórida, onde a pontuação de risco do suspeito é calculada por um dos programas mais populares desse tipo na Northpointe .Como se viu, apenas 20% dos suspeitos para os quais o programa identificou um alto risco de cometer crimes realmente o cometeram dentro de dois anos após a exposição. Mesmo se você levar em conta pequenas violações, como ir além do perímetro de uma prisão domiciliar, "a precisão do programa é um pouco mais do que jogar uma moeda".Mas o pior é que o programa exibe discriminação racial. As taxas de avaliação de risco para afro-americanos são muito mais altas do que para criminosos brancos. A previsão errônea de recaída para negros é duas vezes maior que para brancos.Indicador de avaliação de risco para afro-americanos (1 - mínimo, 10 - máximo) Indicador de avaliação de risco para brancos (1 - mínimo, 10 - máximo)

Indicador de avaliação de risco para brancos (1 - mínimo, 10 - máximo) Os pesquisadores concluem que o programa viola a lei, considerando especificamente o fator de cor da pele como um dos parâmetros para determinar a probabilidade de um crime no futuro.Northpointe alega que a raça do suspeito não é de forma alguma levada em consideração na análise. Mas outros fatores que se correlacionam fortemente com a raça são levados em consideração: nível de escolaridade, status de emprego, histórico criminal de parentes, uso de drogas por amigos / conhecidos etc. O peso de cada fator na pontuação final é classificado - este é o algoritmo proprietário da Northpointe.

Os pesquisadores concluem que o programa viola a lei, considerando especificamente o fator de cor da pele como um dos parâmetros para determinar a probabilidade de um crime no futuro.Northpointe alega que a raça do suspeito não é de forma alguma levada em consideração na análise. Mas outros fatores que se correlacionam fortemente com a raça são levados em consideração: nível de escolaridade, status de emprego, histórico criminal de parentes, uso de drogas por amigos / conhecidos etc. O peso de cada fator na pontuação final é classificado - este é o algoritmo proprietário da Northpointe.Source: https://habr.com/ru/post/pt394313/

All Articles