O algoritmo de aprendizado profundo diagnostica câncer de pele não é pior do que um dermatologista qualificado

O aprendizado profundo é uma metodologia promissora para o ensino de algoritmos, envolvida em um grande número de áreas (segurança da informação, análise de resultados de pesquisas, reconhecimento de imagens). Quanto ao reconhecimento de imagens, não se trata apenas do fato de a máquina diferenciar um gato de um cachorro, como foi o caso da rede neural do Google. Não, uma tecnologia semelhante pode ser útil na medicina, em particular na oncologia.Cientistas de Stanford criaram um sistemaque pode diagnosticar analisando uma fotografia da pele do paciente. Testes recentes mostraram resultados impressionantes: o algoritmo diagnosticou com a mesma precisão que os dermatologistas, com vasta experiência e sérias qualificações. Para comparar as capacidades da tecnologia, os autores do projeto solicitaram um diagnóstico por imagem das áreas da pele de várias pessoas por dermatologistas profissionais (com verificação do diagnóstico) e, em seguida, as mesmas imagens foram mostradas na máquina."Criamos um algoritmo de aprendizado profundo muito poderoso que pode aprender usando dados", disse Andre Esteva, um dos autores do estudo. "Em vez de programar um sistema codificado como esse, deixamos que ele próprio tome decisões."O algoritmo é chamado de "rede neural convolucional profunda". Seus recursos são baseados no Google Brain., um projeto do Google desenvolvido para explorar o poder do aprendizado de máquina. O poder computacional do sistema Google Brain permite que desenvolvedores de terceiros criem vários projetos de aprendizado de máquina. Quando os cientistas começaram a trabalhar, a rede neural conseguiu identificar mais de 1,28 milhão de objetos em imagens, divididos em vários milhares de categorias diferentes. Mas os pesquisadores tinham um objetivo claro: precisavam treinar a rede neural para identificar corretamente o carcinoma e a queratose seborreica, além de ensinar o sistema a distinguir essas duas doenças de acordo com imagens com áreas da pele humana afetada.Além disso, o computador precisava distinguir esses elementos de manchas comuns da idade, erupções cutâneas e outras possíveis alterações na estrutura da pele. Um médico com muito conhecimento e experiência é capaz de fazer isso quase sem erros. E os cientistas se propuseram a tarefa de "educar" esse profissional a partir da rede neural.

O aprendizado profundo é uma metodologia promissora para o ensino de algoritmos, envolvida em um grande número de áreas (segurança da informação, análise de resultados de pesquisas, reconhecimento de imagens). Quanto ao reconhecimento de imagens, não se trata apenas do fato de a máquina diferenciar um gato de um cachorro, como foi o caso da rede neural do Google. Não, uma tecnologia semelhante pode ser útil na medicina, em particular na oncologia.Cientistas de Stanford criaram um sistemaque pode diagnosticar analisando uma fotografia da pele do paciente. Testes recentes mostraram resultados impressionantes: o algoritmo diagnosticou com a mesma precisão que os dermatologistas, com vasta experiência e sérias qualificações. Para comparar as capacidades da tecnologia, os autores do projeto solicitaram um diagnóstico por imagem das áreas da pele de várias pessoas por dermatologistas profissionais (com verificação do diagnóstico) e, em seguida, as mesmas imagens foram mostradas na máquina."Criamos um algoritmo de aprendizado profundo muito poderoso que pode aprender usando dados", disse Andre Esteva, um dos autores do estudo. "Em vez de programar um sistema codificado como esse, deixamos que ele próprio tome decisões."O algoritmo é chamado de "rede neural convolucional profunda". Seus recursos são baseados no Google Brain., um projeto do Google desenvolvido para explorar o poder do aprendizado de máquina. O poder computacional do sistema Google Brain permite que desenvolvedores de terceiros criem vários projetos de aprendizado de máquina. Quando os cientistas começaram a trabalhar, a rede neural conseguiu identificar mais de 1,28 milhão de objetos em imagens, divididos em vários milhares de categorias diferentes. Mas os pesquisadores tinham um objetivo claro: precisavam treinar a rede neural para identificar corretamente o carcinoma e a queratose seborreica, além de ensinar o sistema a distinguir essas duas doenças de acordo com imagens com áreas da pele humana afetada.Além disso, o computador precisava distinguir esses elementos de manchas comuns da idade, erupções cutâneas e outras possíveis alterações na estrutura da pele. Um médico com muito conhecimento e experiência é capaz de fazer isso quase sem erros. E os cientistas se propuseram a tarefa de "educar" esse profissional a partir da rede neural. O problema também era que os especialistas não tinham uma amostra suficientemente grandeimagens para treinar o sistema. Portanto, eles tiveram que criar um banco de dados de imagens por conta própria. "Coletamos fotos da Internet e pedimos aos médicos que nos ajudassem a classificar as imagens", diz um dos autores do estudo. Os autores tiraram algumas fotos de sites estrangeiros, então às vezes era simplesmente impossível entender o que estava escrito na descrição, uma vez que os textos anexos eram em árabe, alemão, latim e outras línguas.

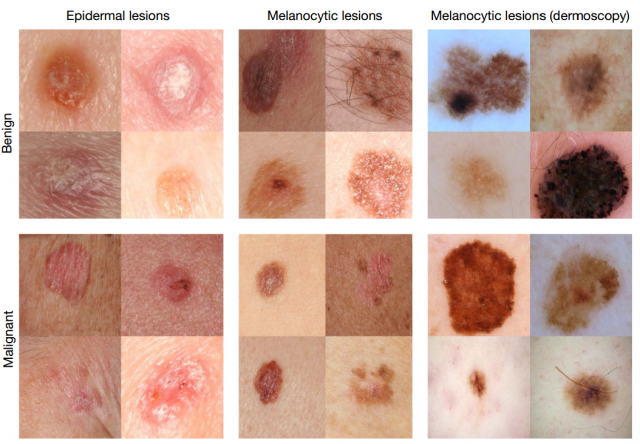

O problema também era que os especialistas não tinham uma amostra suficientemente grandeimagens para treinar o sistema. Portanto, eles tiveram que criar um banco de dados de imagens por conta própria. "Coletamos fotos da Internet e pedimos aos médicos que nos ajudassem a classificar as imagens", diz um dos autores do estudo. Os autores tiraram algumas fotos de sites estrangeiros, então às vezes era simplesmente impossível entender o que estava escrito na descrição, uma vez que os textos anexos eram em árabe, alemão, latim e outras línguas. Para estudar a condição da área da pele do paciente, os dermatologistas costumam usar uma ferramenta médica chamada dermatoscópio. Dá um certo nível de aumento, para que o médico possa ver a pele em detalhes. O dispositivo fornece aproximadamente a mesma "imagem", de modo que uma fotografia de uma área da pele tirada com esta ferramenta é compreensível para qualquer dermatologista de qualquer país do mundo. Infelizmente para os participantes do estudo, nem todas as fotos da Internet foram tiradas usando um dermatoscópio. O ângulo de disparo, iluminação, o grau de aumento - tudo isso foi diferente.Como resultado, os cientistas, analisando 130.000 imagens, identificaram cerca de 2.000 tipos diferentes de doenças de pele. Eles criaram um conjunto de dados para uma biblioteca de imagens e depois "alimentaram" todas essas redes neurais. Cada imagem foi apresentada em um bloco separado, um “pixel”, com uma breve descrição da doença. Em seguida, o algoritmo foi “solicitado” a mostrar os estágios de desenvolvimento da mesma doença, tendo previamente identificado padrões de aumento focal.

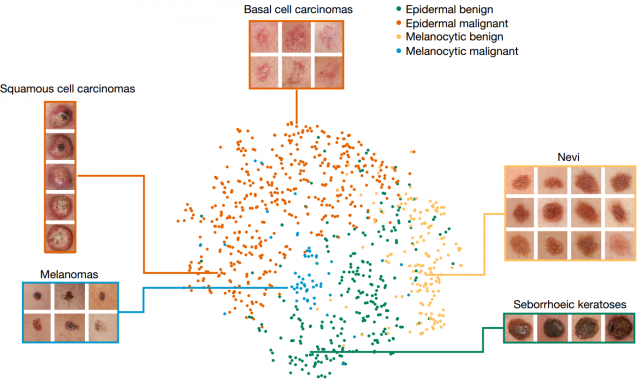

Para estudar a condição da área da pele do paciente, os dermatologistas costumam usar uma ferramenta médica chamada dermatoscópio. Dá um certo nível de aumento, para que o médico possa ver a pele em detalhes. O dispositivo fornece aproximadamente a mesma "imagem", de modo que uma fotografia de uma área da pele tirada com esta ferramenta é compreensível para qualquer dermatologista de qualquer país do mundo. Infelizmente para os participantes do estudo, nem todas as fotos da Internet foram tiradas usando um dermatoscópio. O ângulo de disparo, iluminação, o grau de aumento - tudo isso foi diferente.Como resultado, os cientistas, analisando 130.000 imagens, identificaram cerca de 2.000 tipos diferentes de doenças de pele. Eles criaram um conjunto de dados para uma biblioteca de imagens e depois "alimentaram" todas essas redes neurais. Cada imagem foi apresentada em um bloco separado, um “pixel”, com uma breve descrição da doença. Em seguida, o algoritmo foi “solicitado” a mostrar os estágios de desenvolvimento da mesma doença, tendo previamente identificado padrões de aumento focal. Diferentes categorias de imagens nas quais o algoritmo quebrou o banco de dados original de fotosDepois de tudo pronto, os autores do projeto compararam os resultados do diagnóstico realizado com o sistema com os resultados conhecidos do diagnóstico de doenças de pele de pacientes realizados por duas dúzias de dermatologistas da Stanford Medical School. Para testar o algoritmo, os cientistas usaram apenas imagens de alta qualidade feitas por profissionais. A precisão do diagnóstico foi de 91%, tanto para o algoritmo quanto para os médicos.Os autores planejam desenvolver gradualmente seu desenvolvimento. Em particular, os pesquisadores desejam criar um aplicativo que trabalhe diretamente com fotografias de áreas da pele com áreas problemáticas que os próprios pacientes baixam. Segundo os pesquisadores, isso simplificará o acesso a serviços médicos para um grande número de pacientes. E os smartphones aqui podem ser inestimáveis. “Meu principal ponto de vista de Eureka foi quando percebi o quão onipresente os smartphones seriam”, diz um dos iniciantes do projeto, descrevendo o processo de implementação do trabalho de uma idéia para um serviço em funcionamento. “Qualquer pessoa agora tem um computador poderoso com muitos sensores, incluindo uma câmera. E se você puder usá-lo para tirar fotos de câncer de pele ou outros tipos de doenças? ”De qualquer forma, os pesquisadores precisam realizar mais testes antes de finalizar sua tecnologia para as massas, a fim de finalizar o algoritmo. Nesse caso, é extremamente importante saber como a máquina classifica imagens.“As possibilidades de classificação de imagens auxiliada por computador são uma excelente ajuda para dermatologistas que podem fazer diagnósticos mais precisos. Mas, a longo prazo, é necessário confirmar o desempenho do algoritmo, é necessário fazer isso antes de implementar essa prática em hospitais ", disse Susan Svetter, professora de dermatologia de Stanford.

Diferentes categorias de imagens nas quais o algoritmo quebrou o banco de dados original de fotosDepois de tudo pronto, os autores do projeto compararam os resultados do diagnóstico realizado com o sistema com os resultados conhecidos do diagnóstico de doenças de pele de pacientes realizados por duas dúzias de dermatologistas da Stanford Medical School. Para testar o algoritmo, os cientistas usaram apenas imagens de alta qualidade feitas por profissionais. A precisão do diagnóstico foi de 91%, tanto para o algoritmo quanto para os médicos.Os autores planejam desenvolver gradualmente seu desenvolvimento. Em particular, os pesquisadores desejam criar um aplicativo que trabalhe diretamente com fotografias de áreas da pele com áreas problemáticas que os próprios pacientes baixam. Segundo os pesquisadores, isso simplificará o acesso a serviços médicos para um grande número de pacientes. E os smartphones aqui podem ser inestimáveis. “Meu principal ponto de vista de Eureka foi quando percebi o quão onipresente os smartphones seriam”, diz um dos iniciantes do projeto, descrevendo o processo de implementação do trabalho de uma idéia para um serviço em funcionamento. “Qualquer pessoa agora tem um computador poderoso com muitos sensores, incluindo uma câmera. E se você puder usá-lo para tirar fotos de câncer de pele ou outros tipos de doenças? ”De qualquer forma, os pesquisadores precisam realizar mais testes antes de finalizar sua tecnologia para as massas, a fim de finalizar o algoritmo. Nesse caso, é extremamente importante saber como a máquina classifica imagens.“As possibilidades de classificação de imagens auxiliada por computador são uma excelente ajuda para dermatologistas que podem fazer diagnósticos mais precisos. Mas, a longo prazo, é necessário confirmar o desempenho do algoritmo, é necessário fazer isso antes de implementar essa prática em hospitais ", disse Susan Svetter, professora de dermatologia de Stanford.Source: https://habr.com/ru/post/pt400967/

All Articles