Chegou a hora da computação inspirada na estrutura do cérebro. Algoritmos que usam redes neurais e aprendizado profundo que imitam alguns aspectos do cérebro humano permitem que os computadores digitais alcancem alturas incríveis na tradução de idiomas, busquem padrões ilusórios em grandes quantidades de dados e derrotem as pessoas no Go.

Mas enquanto os engenheiros continuam desenvolvendo ativamente essa estratégia computacional, capaz de muito, a eficiência energética da computação digital está chegando ao seu limite. Nossos data centers e supercomputadores já consomem megawatts - 2% de toda a eletricidade consumida nos EUA é destinada a data centers. E o cérebro humano vale 20 watts, e essa é uma pequena fração da energia contida nos alimentos diários consumidos. Se queremos melhorar os sistemas de computação, precisamos fazer os computadores parecerem cérebros.

Uma onda de interesse em tecnologias neuromórficas está associada a essa idéia, prometendo levar os computadores além das simples redes neurais, em direção a circuitos que funcionam como neurônios e sinapses. O desenvolvimento de circuitos físicos semelhantes ao cérebro já está bastante desenvolvido. O trabalho realizado em meu laboratório e em outras instituições ao redor do mundo nos últimos 35 anos levou à criação de componentes nervosos artificiais, semelhantes a sinapses e dendritos, que reagem e geram sinais elétricos da mesma maneira que os reais.

Então, o que é necessário para integrar esses componentes em um cérebro de computador completo? Em 2013, Bo Marr, meu ex-aluno de graduação no Instituto de Tecnologia da Geórgia, me ajudou a

avaliar o melhor dos avanços modernos em engenharia e neurobiologia . Concluímos que é possível criar uma versão em silício do córtex do cérebro humano usando transistores. Além disso, a máquina final ocuparia menos de um metro cúbico no espaço e consumiria menos de 100 watts, o que não é tão diferente do cérebro humano.

Não quero dizer que criar um computador assim será fácil. O sistema que inventamos exigirá vários bilhões de dólares para desenvolvimento e construção e, para ser compacto, incluirá várias inovações inovadoras. Também surge a questão de como vamos programar e treinar esse computador. Pesquisadores de neuromorfismo ainda estão lutando para entender como fazer com que milhares de neurônios artificiais trabalhem juntos e como encontrar aplicativos úteis para a atividade pseudo-cerebral.

No entanto, o fato de podermos criar um sistema desse tipo sugere que não tínhamos muito tempo antes do aparecimento de chips de menor escala, adequados para uso em eletrônicos portáteis e portáteis. Esses aparelhos consumirão pouca energia; portanto, um chip neuromórfico com alta eficiência energética - mesmo que faça apenas parte dos cálculos, digamos, do processamento de sinais - pode se tornar revolucionário. Recursos existentes, como reconhecimento de fala, podem funcionar em ambientes ruidosos. Você pode até imaginar os smartphones do futuro realizando a tradução da fala em tempo real em uma conversa entre duas pessoas. Pense nisso: nos 40 anos desde o advento dos circuitos integrados para processamento de sinais, a lei de Moore melhorou sua eficiência energética em cerca de 1.000 vezes. Os chips neuromórficos muito parecidos com o cérebro podem facilmente superar essas melhorias, reduzindo o consumo de energia em mais 100 milhões de vezes. Como resultado, os cálculos que antes precisavam de um data center cabiam na palma da sua mão.

Em uma máquina ideal que se aproxima do cérebro, será necessário recriar análogos de todos os principais componentes funcionais do cérebro: sinapses que conectam neurônios e lhes permitem receber e responder a sinais; dendritos combinando e realizando cálculos locais com base nos sinais recebidos; o núcleo, ou soma, é a região de cada nêutron, combinando a entrada de dendritos e transmitindo a saída para o axônio.

As versões mais simples desses componentes básicos já estão implementadas em silício. O início deste trabalho foi dado pelo mesmo semicondutor de óxido metálico, ou MOSFET, bilhões de cópias usadas para construir circuitos lógicos nos modernos processadores digitais.

Esses dispositivos têm muito em comum com os neurônios. Os neurônios funcionam por meio de barreiras controladas por voltagem, e sua atividade elétrica e química depende principalmente dos canais nos quais os íons se movem entre os espaços interno e externo da célula. Esse é um processo analógico suave no qual há um acúmulo ou redução constante do sinal, em vez de operações simples de ligar / desligar.

Os MOSFETs também são controlados por tensão e operam pelos movimentos de unidades de carga individuais. E quando os MOSFETs operam no modo "sublimiar", sem atingir o limite de tensão, alternando os modos ligado e desligado, a quantidade de corrente que flui pelo dispositivo é muito pequena - menos de um milésimo da corrente que pode ser encontrada em comutadores típicos ou portas digitais.

A idéia de que a física dos transistores sublimiares pode ser usada para criar circuitos semelhantes ao cérebro foi expressa por Carver Mead, da Caltech, que contribuiu para a revolução no campo dos circuitos integrados super grandes na década de 1970. Mil apontou que os projetistas de chips não usavam muitos aspectos interessantes de seu comportamento, usando transistores exclusivamente para a lógica digital. Esse processo, como

ele escreveu em 1990 , é semelhante ao fato de que "toda a bela física que existe nos transistores é esmagada em zeros e uns, e então os portões AND e OR são dolorosamente construídos nesta base para reinventar a multiplicação". Um computador mais "físico" ou baseado na física poderia fazer mais cálculos por unidade de energia do que um computador digital convencional. Mead previu que esse computador ocuparia menos espaço.

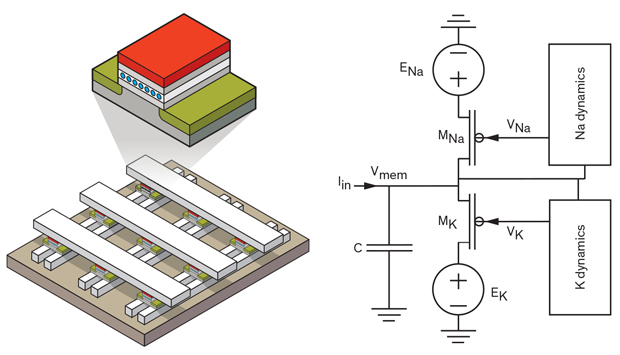

Nos anos seguintes, engenheiros de sistemas neuromórficos criaram todos os blocos básicos do cérebro a partir de silício com alta precisão biológica. Dendritos, axônio e soma de neurônios podem ser feitos a partir de transistores padrão e outros elementos. Por exemplo, em 2005, Ethan Farquhar e eu

criamos um circuito neural a partir de um conjunto de seis MOSFETs e um monte de capacitores. Nosso modelo emitia impulsos eletricamente muito semelhantes aos que emitem lulas neuronais para peixes-gato - um objeto de longa data de experimentos. Além disso, nosso esquema alcançou esses indicadores com níveis atuais e de consumo de energia próximos aos existentes no cérebro das lulas. Se quiséssemos usar circuitos analógicos para modelar as equações derivadas pelos neurocientistas para descrever esse comportamento, teríamos que usar 10 vezes mais transistores. A realização desses cálculos em um computador digital exigiria ainda mais espaço.

Sinapses e bagres: um transistor de porta flutuante (canto superior esquerdo), capaz de armazenar uma quantidade diferente de carga, pode ser usado para criar uma matriz coordenada de sinapses artificiais (canto inferior esquerdo). Versões eletrônicas de outros componentes do neurônio, como o peixe-gato (à direita), podem ser feitas a partir de transistores padrão e outros componentes.

As sinapses são um pouco mais difíceis de imitar. Um dispositivo que se comporta como uma sinapse deve ser capaz de lembrar em que estado está, responder de certa maneira ao sinal recebido e adaptar suas respostas ao longo do tempo.

Existem várias abordagens em potencial para criar sinapses. O mais desenvolvido deles é uma

sinapse de aprendizado de transistor único (STLS), na qual meus colegas de Kaltech e eu trabalhamos nos anos 90, quando eu era estudante de pós-graduação em Mead.

Introduzimos o STLS pela primeira vez em 1994, e ele se tornou uma ferramenta importante para os engenheiros que criam circuitos analógicos modernos - por exemplo, redes neurais físicas. Nas redes neurais, cada nó da rede tem um peso associado a ele, e esses pesos determinam como os dados de diferentes nós são combinados. O STLS foi o primeiro dispositivo capaz de conter um conjunto de pesos diferentes e reprogramar em tempo real. Além disso, o dispositivo é não volátil, ou seja, lembra seu estado, mesmo quando não está em uso - essa circunstância reduz significativamente a necessidade de energia.

STLS é um tipo de transistor de porta flutuante, um dispositivo usado para criar células na memória flash. Em um MOSFET convencional, o portão controla a corrente que passa pelo canal. O transistor de portão flutuante possui um segundo portão, entre o portão elétrico e o canal. Este obturador não está diretamente conectado à terra ou a qualquer outro componente. Graças a esse isolamento elétrico, reforçado com isoladores de silicone de alta qualidade, a carga é armazenada em um portão flutuante por um longo tempo. Esse obturador é capaz de receber uma quantidade diferente de carga e, portanto, pode fornecer uma resposta elétrica em vários níveis - e isso é necessário para criar uma sinapse artificial que pode variar sua resposta ao estímulo.

Meus colegas e eu usamos o STLS para demonstrar a primeira rede de coordenadas, um modelo computacional popular entre os pesquisadores de nanodispositivos. Em uma matriz bidimensional, os dispositivos estão localizados na interseção das linhas de entrada que vão de cima para baixo e das linhas de saída que vão da esquerda para a direita. Essa configuração é útil, pois permite programar a força de conexão de cada "sinapse" separadamente, sem interferir com outros elementos da matriz.

Graças, em particular, ao recente programa DARPA chamado

SyNAPSE , a

neuromorfia da engenharia estimulou pesquisas sobre sinapses artificiais feitas a partir de nanodispositivos, como memristores, memória resistiva e memória de estado de fase, bem como dispositivos de porta flutuante. Mas será difícil melhorar essas novas sinapses artificiais com base em matrizes com uma persiana flutuante há vinte anos. Memristores e outros tipos de nova memória são difíceis de programar. A arquitetura de alguns deles é tal que é bastante difícil acessar um dispositivo específico em uma matriz de coordenadas. Outros requerem um transistor dedicado para programação, o que aumenta significativamente seu tamanho. Como a memória com um obturador flutuante pode ser programada para uma ampla faixa de valores, é mais fácil ajustar para compensar os desvios de produção de dispositivo para dispositivo em comparação com outros dispositivos nanodispositivos. Vários grupos de pesquisa que estudaram dispositivos neuromórficos tentaram incorporar nanodispositivos em seus projetos e, como resultado, começaram a usar dispositivos de obturador flutuante.

E como combinamos todos esses componentes semelhantes ao cérebro? No cérebro humano, neurônios e sinapses estão interligados. Os desenvolvedores de chips neuromórficos também devem escolher uma abordagem integrada com a colocação de todos os componentes em um chip. Mas em muitos laboratórios você não encontrará isso: para facilitar o trabalho com projetos de pesquisa, unidades de base individuais estão localizadas em locais diferentes. As sinapses podem ser colocadas em uma matriz fora do chip. As conexões podem passar por outro chip, um FPGA (User Programmable Gate Array).

Porém, ao escalar sistemas neuromórficos, é necessário garantir que não estamos copiando a estrutura dos computadores modernos que perdem uma quantidade significativa de energia transferindo bits de um lado para o outro entre lógica, memória e armazenamento. Hoje, um computador pode consumir 10 vezes mais energia para mover dados do que para a computação.

O cérebro, pelo contrário, minimiza o consumo de energia das comunicações devido à alta localização das operações. Elementos de memória cerebral, como o poder da sinapse, são misturados com componentes de transmissão de sinal. E os "fios" do cérebro - dendritos e axônios que transmitem sinais de entrada e impulsos de saída - são geralmente curtos em comparação com o tamanho do cérebro e não precisam de muita energia para manter o sinal. Pela anatomia, sabemos que mais de 90% dos neurônios se conectam a apenas 1.000 vizinhos.

Outra grande questão para os criadores de chips e computadores semelhantes ao cérebro são os algoritmos que terão que trabalhar neles. Mesmo um sistema ligeiramente semelhante ao cérebro pode dar uma grande vantagem sobre um sistema digital convencional. Por exemplo, em 2004, meu grupo usou dispositivos de porta flutuante para realizar a multiplicação no processamento de sinais, e isso levou 1.000 vezes menos energia e 100 vezes menos espaço que um sistema digital. Ao longo dos anos, os pesquisadores demonstraram com sucesso abordagens neuromórficas para outros tipos de computação para processamento de sinais.

Mas o cérebro ainda é 100.000 vezes mais eficiente que esses sistemas. Isso ocorre porque, embora nossas tecnologias neuromórficas atuais tirem vantagem da física dos transistores, eles não usam algoritmos como os que o cérebro usa para fazer seu trabalho.

Hoje estamos apenas começando a descobrir esses algoritmos físicos - processos que podem permitir que chips do tipo cérebro funcionem com eficiência próxima ao cérebro. Há quatro anos, meu grupo usou bagres, sinapses e dendritos de silício para executar um algoritmo de busca de palavras que reconhece palavras em gravações de áudio. Esse algoritmo mostrou uma melhoria de mil vezes na eficiência energética em comparação com o processamento de sinal analógico. Como resultado, reduzindo a voltagem aplicada aos chips e usando transistores menores, os pesquisadores devem criar chips comparáveis em desempenho ao cérebro em muitos tipos de computação.

Quando eu comecei a pesquisar sobre neuromorfismo 30 anos atrás, todos acreditavam que o desenvolvimento de sistemas semelhantes ao cérebro nos proporcionaria oportunidades surpreendentes. De fato, agora indústrias inteiras são construídas em torno da IA e do aprendizado aprofundado, e esses aplicativos prometem transformar completamente nossos dispositivos móveis, instituições financeiras e a interação de pessoas em locais públicos.

E, no entanto, esses aplicativos dependem muito pouco de nosso conhecimento da função cerebral. Nos próximos 30 anos, sem dúvida conseguiremos ver como esse conhecimento é cada vez mais usado. Já temos muitos blocos básicos de hardware necessários para converter a neurobiologia em um computador. Mas precisamos entender ainda melhor como esse equipamento deve funcionar - e quais esquemas computacionais fornecerão os melhores resultados.

Considere isso um plano de ação. Conseguimos muito usando um modelo muito aproximado do cérebro. Mas a neurociência pode nos levar a criar computadores parecidos com o cérebro mais complexos. E o que poderia ser melhor do que usar nosso cérebro para entender como criar esses novos computadores?