Um grupo de pesquisadores de Berkeley divulgou dois vídeos este ano. Em um deles, um cavalo corre atrás da cerca. No segundo, de repente, ela recebe um padrão de zebra em preto e branco. O resultado não é perfeito, mas as tiras se encaixam no cavalo com tanta clareza, como se a árvore genealógica desses animais estivesse mergulhada no caos. Um truque semelhante é um indicador da capacidade de evolução dos algoritmos de aprendizado de máquina para mudar a realidade.

Alguns outros pesquisadores usaram redes neurais para

transformar fotos de ursos negros em imagens críveis de pandas, maçãs em laranjas e gatos em cães. Um usuário do Reddit usou outro algoritmo de aprendizado de máquina para editar vídeos pornográficos e

inseriu rostos de celebridades lá . O Lyrebird de inicialização

sintetiza um discurso bastante convincente com base em uma gravação de um minuto da voz de uma pessoa. E os engenheiros da Adobe, desenvolvendo a plataforma de inteligência artificial Sensei, estão introduzindo o

aprendizado de máquina em ferramentas inovadoras para edição de vídeo, foto e áudio. Esses projetos são muito diferentes em sua origem e objetivos, mas eles têm uma coisa em comum: sintetizam imagens e sons que se revelam incrivelmente semelhantes aos reais. Ao contrário dos experimentos anteriores, essas criações de IA parecem e soam realistas.

As tecnologias subjacentes a essas mudanças em breve nos levarão a novas áreas criativas, aumentando as capacidades dos artistas contemporâneos e tornando os profissionais amadores comuns. Procuraremos novas definições do conceito de criatividade, que ampliarão seu horizonte e incluirão as criações de máquinas. Mas esse boom terá uma desvantagem. Parte do conteúdo criado pela inteligência artificial será usada para enganar, gerando medo de uma avalanche interminável de

notícias falsas . O antigo debate sobre se a imagem foi alterada dará lugar a uma nova - sobre a origem de todos os tipos de conteúdo, incluindo texto. Você começará a se perguntar: que papel as pessoas (se houver) tiveram na criação deste álbum / série / artigo?

Anteriormente, havia duas maneiras de criar áudio ou vídeo semelhantes aos reais. O primeiro é usar câmeras e microfones para gravar uma cena de produção. O segundo é maximizar o uso do talento humano, geralmente com muito dinheiro, para criar uma cópia exata. Agora, os algoritmos de aprendizado de máquina oferecem uma terceira opção, permitindo que qualquer pessoa com conhecimento técnico mínimo modifique o conteúdo existente para criar novo material.

O Nascimento de Vênus - versão de Deep Dreams

O Nascimento de Vênus - versão de Deep DreamsA princípio, o conteúdo gerado pelas redes neurais não estava orientado para o realismo. O Deep Dreams do Google, lançado em 2015, foi um dos primeiros exemplos de uso do aprendizado profundo para carimbar paisagens psicodélicas e obras de arte grotescas de vários olhos. O aplicativo de sucesso de 2016, Prisma, usou o aprendizado profundo para aprimorar os filtros de fotos, como estilizar fotos com pinturas de Mondrian ou Munch. Essa técnica é conhecida como transferência de estilo: pegue o estilo de uma imagem (por exemplo, “Gritar”) e aplique-o no segundo quadro.

Agora, os algoritmos de transferência de estilos estão sendo aprimorados constantemente. Tomemos, por exemplo, o

trabalho do laboratório

de Kavita Bala da Universidade de Cornell. Ele mostra como o aprendizado profundo pode transferir o estilo de uma fotografia (uma atmosfera noturna tremeluzente) para uma imagem de uma metrópole sombria - e enganar os revisores que acharão que esse lugar é real. Inspirado pelo potencial da inteligência artificial em reconhecer propriedades estéticas, o professor Bala co-fundou a

GrokStyle . Imagine que você gosta de almofadas decorativas no sofá de um amigo ou em um cobertor de uma revista. Mostre ao algoritmo GrokStyle esta imagem e ela encontrará imagens de coisas no mesmo estilo.

O professor Bala diz: “O que eu mais gosto nessas tecnologias é como elas democratizam o design e o estilo. Eu sou um tecnólogo: aprecio a beleza e o estilo, mas não consigo nem criá-los de perto. E este trabalho disponibiliza essas coisas para mim. Também muito satisfeito por poder disponibilizar isso para outras pessoas. O fato de não sermos talentosos nessa área não significa que devemos viver em um ambiente entediante. ”

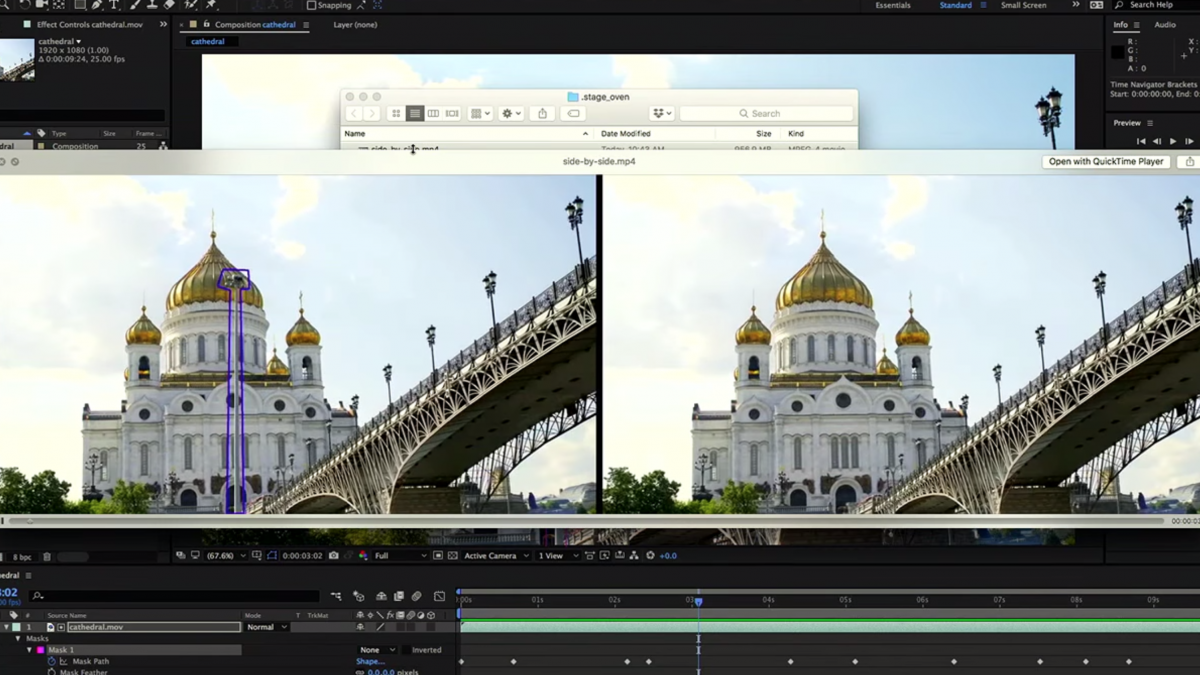

Na Adobe, o aprendizado de máquina faz parte da criação de produtos criativos há mais de uma década, mas a empresa deu um grande passo adiante. Em outubro, os engenheiros que trabalhavam no Sensei demonstraram uma promissora ferramenta de edição de vídeo chamada Adobe Cloak. Ele permite que o usuário remova facilmente, digamos, um poste de luz de um videoclipe - uma tarefa que seria terrivelmente dolorosa, mesmo para um editor experiente. Outro projeto, chamado Project Puppetron, aplica um estilo artístico específico ao vídeo em tempo real. Permite exibir uma pessoa na forma de uma estátua de bronze animada ou um personagem de desenho animado desenhado. "Você pode simplesmente fazer algo na frente da câmera e transformá-lo em animação em tempo real", diz John Brandt, cientista sênior e diretor da Adobe Research.

O aprendizado de máquina torna esses projetos possíveis porque pode distinguir partes do rosto e ver a diferença entre os fundos da frente e do fundo melhor do que as abordagens anteriores da visão por computador. As ferramentas do Sensei permitem que os artistas trabalhem não com materiais, mas com conceitos. “O Photoshop faz um ótimo trabalho no gerenciamento de pixels, mas as pessoas estão realmente tentando manipular o conteúdo exibido por esses pixels”, explica Brandt.

Esta é uma boa parte das notícias. Quando os artistas não precisam mais gastar tempo desenhando pontos individuais na tela, sua produtividade aumenta. Segundo Brandt, ele está muito feliz com a possibilidade do surgimento de novas formas de arte e aguarda a chegada delas.

Demonstração do Adobe Cloak

Demonstração do Adobe CloakMas não é difícil imaginar como essa explosão criativa leva a consequências muito ruins. Yanshun Yao, um graduado da Universidade de Chicago, viu um vídeo falso criado pela AI e decidiu iniciar um projeto explorando os perigos do aprendizado de máquina. No vídeo que ele viu, o gerado Barack Obama fez um discurso. Yao queria verificar se era possível pôr em marcha algo semelhante com o material de texto?

A estrutura do texto deve ser quase perfeita, para que a maioria dos leitores fique convencida de sua "origem humana". Yao começou com uma tarefa relativamente simples - gerar avaliações falsas para o Yelp e a Amazon. Esse texto pode consistir em apenas algumas frases e os leitores não esperam um alto nível de proficiência no idioma. Ele e seus colegas criaram uma

rede neural, criando textos sobre o assunto com 5 frases no Yelp. As críticas recebidas incluíam declarações como "Agora este é o nosso lugar favorito!" e "Fui lá com meu irmão, pedi uma massa vegetariana - muito saborosa". Além disso, Yao perguntou às pessoas se esses textos eram reais ou falsos - e, é claro, as pessoas frequentemente estavam enganadas.

O custo de escrever essas análises varia de US $ 10 a US $ 50, e Yao afirma que é apenas uma questão de tempo até que alguém tente automatizar o processo, reduzindo os preços e inundando o site com análises falsas. Ele também explorou os recursos das redes neurais para proteger o Yelp de conteúdo falso - e conseguiu algum sucesso. Seu próximo objetivo é gerar artigos de notícias confiáveis.

Quanto ao conteúdo de vídeo, o progresso pode se mover ainda mais rápido. Hani Farid, especialista em detecção de fotos e vídeos falsos e professora do Dartmouth College, está preocupada com a rapidez com que o conteúdo viral se espalha e com o atraso no processo de reconhecimento de sua autenticidade. Ele admite que em um futuro próximo haverá um vídeo crível em que Donald Trump dará a ordem para um ataque nuclear à Coréia do Norte. Vai se tornar viral e semear pânico - o mesmo que

causou um programa de rádio na "Guerra dos Mundos". "Não quero fazer suposições histéricas, mas não acho que os medos sejam infundados", diz ele.

No entanto, as aparências geradas por Trump já estão andando na Web. Eles são um produto do Lyrebird, uma inicialização de sintetizador de voz. Jose Sotelo, co-fundador e CEO da empresa, está convencido de que a existência dessa tecnologia é inevitável, para que ele e seus colegas continuem a desenvolvê-la - sem esquecer, é claro, a ética. Ele tem certeza de que a melhor defesa para hoje é conscientizar sobre as possibilidades de aprendizado de máquina. Sotelo observa: “Se você ver minhas fotos na lua, quase certamente decidirá que elas são feitas em um editor gráfico. Mas se você ouvir uma gravação de áudio em que o melhor amigo está falando coisas desagradáveis sobre você, provavelmente você ficará preocupado. Esta é verdadeiramente uma nova tecnologia e apresenta à humanidade novos desafios. ”

É improvável que algo seja capaz de parar a onda de conteúdo de IA gerado. É possível um cenário em que fraudadores e políticos desonestos usarão a tecnologia para criar informações enganosas.

O lado positivo é que o conteúdo de IA gerado também pode fornecer um enorme serviço à sociedade. Sotelo, da Lyrebird, sonha que sua tecnologia poderá recuperar a capacidade de falar com pessoas que perderam a voz devido à esclerose lateral amiotrófica ou câncer. E o vídeo com cavalos e zebras, mencionado no início, foi um subproduto do trabalho para melhorar a visão de veículos não tripulados. O software para essas máquinas é treinado primeiro em um ambiente virtual. Mas um mundo como Grand Theft Auto se assemelha à realidade muito remotamente. O algoritmo Zebrification foi criado para diminuir a distância entre o ambiente virtual e o mundo real e, finalmente, tornar os veículos não tripulados mais seguros.