Uma distopia na qual robôs assassinos destroem pessoas inocentes parece horrível, mas digamos sem rodeios: é tudo ficção científica

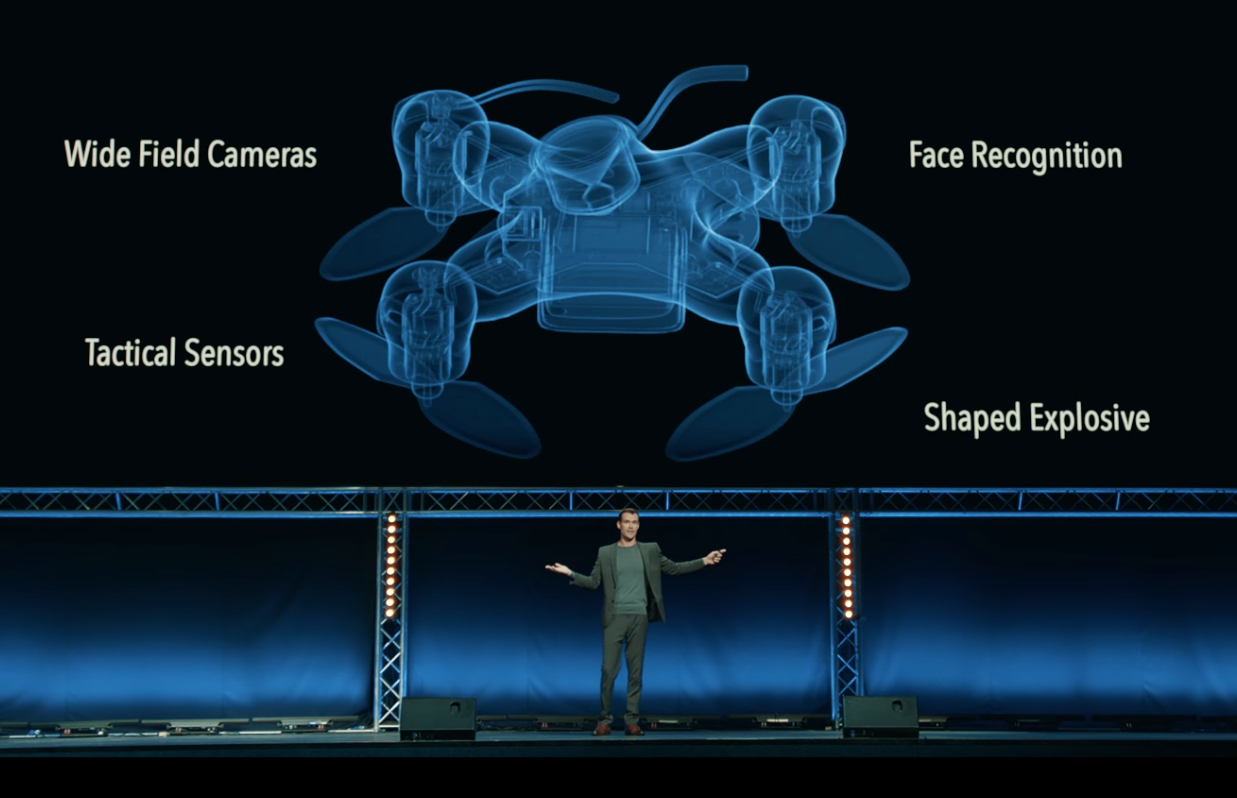

Uma cena do filme Slaughterbots, na qual drones assassinos autônomos caem nas mãos de terroristas em um futuro distópico

Uma cena do filme Slaughterbots, na qual drones assassinos autônomos caem nas mãos de terroristas em um futuro distópicoDrones assassinos que caíram nas mãos de terroristas estão organizando o massacre de pessoas inocentes. As armas robóticas de destruição em massa causam estragos e medo. O curta-metragem, criado pelos defensores da proibição autônoma de armas, foi criado para fazer você acreditar que essa anti-utopia

já está

muito próxima e que medidas devem ser tomadas hoje. O filme Slaughterbots foi lançado em novembro de 2017, simultaneamente à Conferência das Nações Unidas sobre Armas Autônomas. A reunião da ONU não terminou com nada concreto, mas o vídeo está ganhando popularidade. Já foi visto por mais de 2 milhões de pessoas e chegou a

dezenas de artigos . Funciona perfeitamente como propaganda. E com a convicção de aceitar a proibição de armas autônomas, isso não funciona.

É claro que um mundo em que os terroristas possam lançar um enxame de drones assassinos contra pessoas inocentes seria terrível, mas o futuro mostrado no filme é realista? Uma imagem bonita ajuda a esconder lacunas na lógica. O filme mergulha o espectador em um pesadelo distópico, mas digamos sem rodeios: é tudo ficção científica.

A principal suposição do filme é que, no futuro, os militares criarão microdrons autônomos com

cargas cumulativas que podem voar até a cabeça de uma pessoa e ativar explosivos, matando-a. No filme, esses bots assassinos rapidamente caem nas mãos de terroristas, o que leva a um grande número de mortes em todo o mundo.

O conceito principal tem uma base na realidade. Em nosso mundo, o estado islâmico [uma organização terrorista proibida na Federação Russa]

usou quadrocópteros comprados , equipados com uma pequena quantidade de explosivos, para atacar as tropas iraquianas, resultando na morte e ferimentos de várias dezenas de soldados. Os drones terroristas de hoje são controlados remotamente, mas os drones amadores estão se tornando mais independentes.

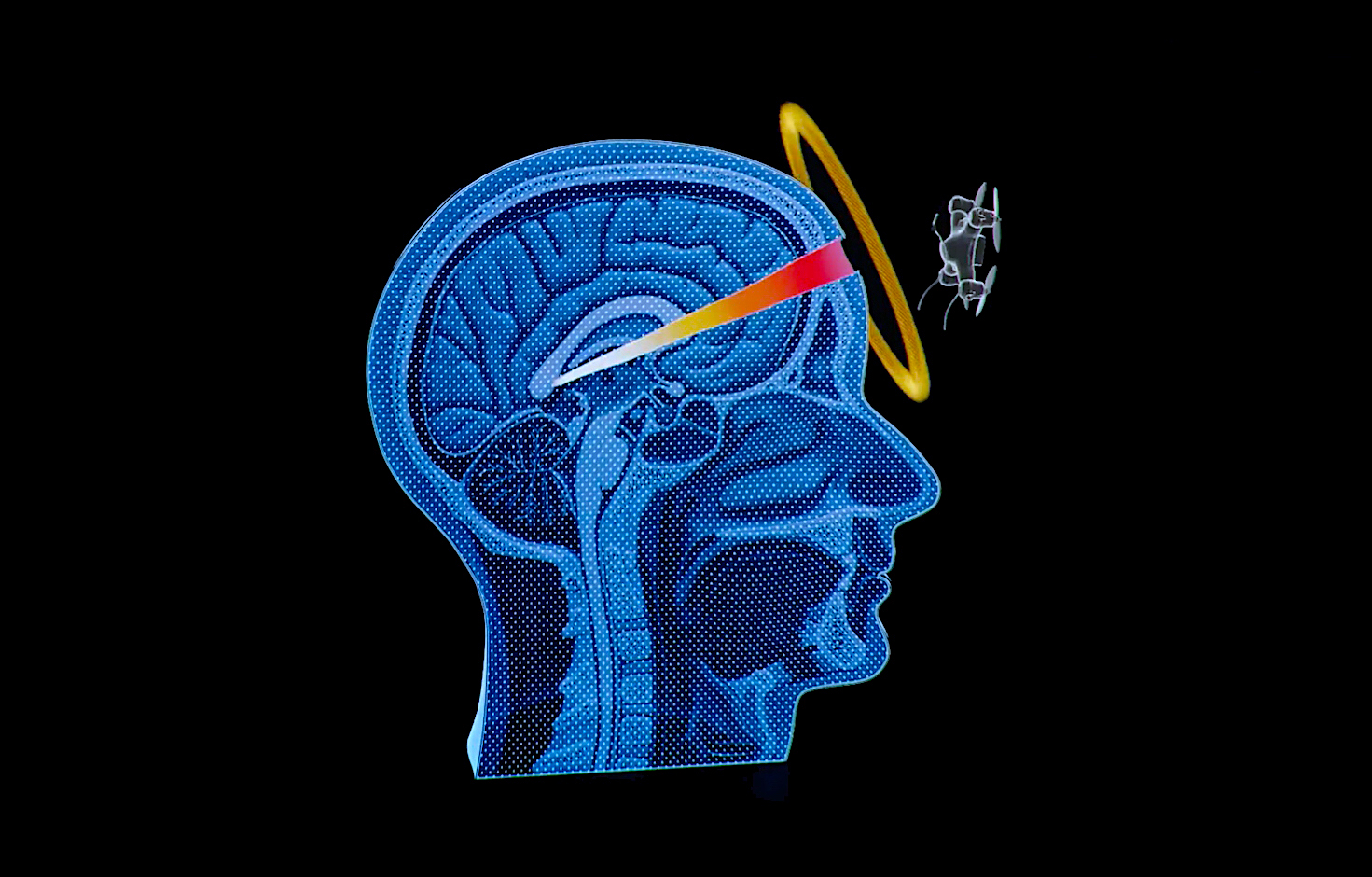

Os modelos mais recentes já sabem voar sozinhos para um alvo fixo, contornando obstáculos, além de rastrear e seguir objetos em movimento de forma independente. Um pequeno drone equipado com um sistema de reconhecimento de rosto pode, em princípio, ser usado para procurar e destruir autonomamente certas pessoas, como mostra o filme Slaughterbots. Em apenas alguns minutos pesquisando na Internet, encontrei recursos onde você pode baixar e treinar uma rede neural gratuita que reconhecerá rostos. E embora ninguém tenha combinado essas tecnologias, como mostrado no filme, todos os componentes já são reais.

Mas quero fazer uma declaração: não podemos impedir que essa tecnologia caia nas mãos de futuros terroristas. É triste, mas deve ser entendido. Assim como os terroristas podem e usam carros para atrair multidões de pessoas, a tecnologia necessária para transformar drones amadores em armas rudes e independentes já é muito difundida para ser detida. Esse é um problema, e a melhor resposta a ele será concentrar-se em medidas de proteção que nos permitam enfrentar drones e capturar terroristas usando sistemas de vigilância. "

O filme usa esse problema, mas o inflama além da medida, alegando que os drones podem ser usados por terroristas como armas de destruição em massa e matam milhares de pessoas. Felizmente, esse cenário de pesadelo é tão provável quanto o

HAL 9000 , que impede você de entrar no gateway. As tecnologias mostradas no vídeo são realistas, mas todo o resto é lixo completo. As seguintes suposições são feitas no vídeo:

- Os governos lançarão a produção em massa de microdrones para uso como armas de destruição em massa.

- Não há defesa eficaz contra microdrons mortais.

- Os governos são incapazes de defender armas de nível militar contra terroristas.

- Os terroristas são capazes de lançar ataques coordenados em larga escala.

Essas suposições variam de controversas a fantásticas.

Obviamente, o vídeo em si é ficção, e as pessoas responsáveis pelo desenvolvimento da defesa costumam usar

cenários fictícios para ajudar os políticos a pensar nas consequências de eventos prováveis. Sou analista de defesa trabalhando em um think tank e, no meu trabalho anterior no Pentágono, participei do planejamento estratégico. E usei cenários fictícios para ilustrar a escolha da tecnologia militar na qual os militares dos EUA deveriam investir. Mas, para que esses cenários sejam úteis, eles devem ser pelo menos prováveis. Deve ser algo que pode acontecer. O roteiro usado no filme Slaughterbots é incapaz de levar em conta a realidade política e estratégica do uso da tecnologia militar pelo governo.

Primeiro, não há evidências de que os governos planejem produzir em massa pequenos drones para matar um grande número de civis. No meu próximo livro

Exército de Nenhum: Armas Autônomas e o Futuro da Guerra [Exército de

Nenhum: Armas Autônomas e o Futuro das Guerras], examino as armas das gerações futuras sendo construídas em laboratórios de defesa em todo o mundo. Rússia, China e Estados Unidos competem em uma corrida por autonomia e inteligência artificial. Mas eles criam armas, na maioria das vezes destinadas a combater os militares. Essas são armas destinadas a atingir alvos militares [

contra-força ], e não a atingir outros ativos, que incluem civis [

contra-valor ]. As armas autônomas do primeiro tipo, é claro, têm seus próprios problemas, mas não são desenvolvidas com o objetivo de destruição em massa de civis e não podem ser reconfiguradas para esse uso.

Em segundo lugar, o vídeo fala sobre drones que podem superar quaisquer “contrações”. Especialistas em televisão gritam que "não podemos nos proteger". Isso nem é ficção, mas farsa. Para cada tecnologia militar, há oposição, e a oposição a pequenos drones nem sequer pode ser chamada de hipotética. O governo dos EUA está

desenvolvendo ativamente métodos de tiro, atolamento, fritura, quebra, armadilha e outros métodos para combater pequenos drones. Os microfones no vídeo podem ser combatidos com sucesso com algo tão simples quanto uma malha de arame. O vídeo mostra drones pesados perfurando buracos nas paredes pelas quais outros penetram - mas uma simples defesa de várias camadas pode ajudar contra isso. Analistas militares estão analisando o valor da defesa versus o ataque, caso em que a vantagem está claramente do lado da defesa estática.

Em um mundo em que os terroristas periodicamente realizam ataques com drones improvisados, é improvável que as pessoas suportem o inconveniente de criar estruturas defensivas confiáveis, assim como as pessoas não usam coletes à prova de balas para proteger contra os improváveis atingidos por um atirador. Mas se um país hostil construir centenas de milhares de drones que podem varrer uma cidade da face da terra, você pode ter certeza de que as coisas não podem funcionar sem redes. O vídeo pega o problema real: terroristas atacando com drones - e o escala sem levar em consideração a reação de outras partes. Se a produção de micródromos letais em escala industrial começasse, a proteção e as contramedidas contra eles se tornariam uma prioridade do estado; nesse caso, as contramedidas seriam simples. E qualquer arma que possa ser protegida com uma malha de arame não é considerada uma arma de destruição em massa.

Em terceiro lugar, o vídeo implica que os militares são incapazes de impedir que terroristas obtenham acesso a armas no nível do exército. Mas hoje não entregamos granadas de mão, rifles antitanque ou metralhadoras para terroristas [verdade, essa afirmação é refutada até pela última

cinebiografia com Tom Cruise no papel-título / aprox. transl.]. Terroristas que atacam com drones empolgam a todos porque usam explosivos caseiros, ligados à tecnologia final. Esse é um problema real, mas, novamente, o vídeo dimensiona essa ameaça para volumes irrealistas. Mesmo que os militares começassem a fabricar microdrones mortais, os terroristas seriam capazes de obter um grande número deles não mais fácil do que qualquer outra tecnologia militar. As armas realmente caem gradualmente nas mãos dos participantes das hostilidades que lutam do lado errado, mas o fato de a Síria estar cheia de mísseis anti-tanque não significa que eles são fáceis de encontrar em Nova York. Os terroristas usam aviões e caminhões precisamente porque não é tão fácil contrabandear armas do tipo exército para um país ocidental.

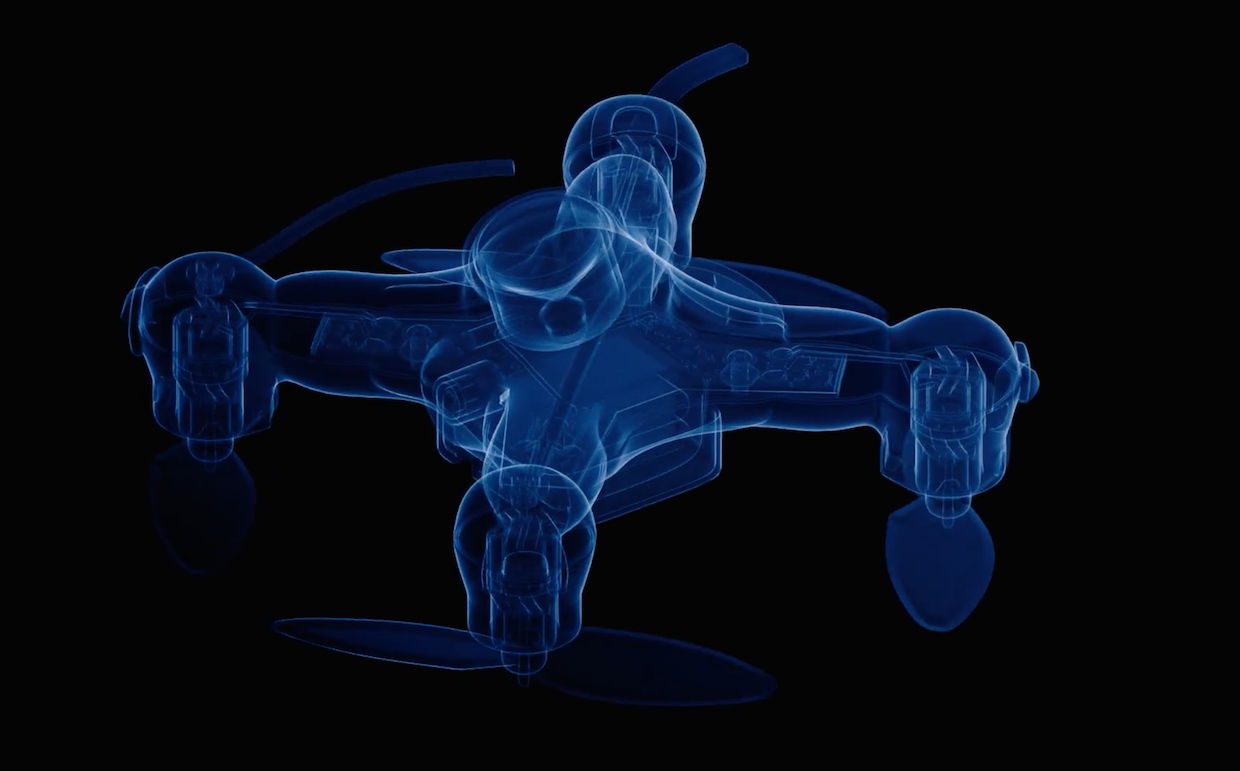

Microdrones assassinos do filme

Microdrones assassinos do filmeQuarto, o vídeo sugere que os terroristas são capazes de atacar com uma coordenação incrivelmente precisa. Em um episódio, duas pessoas lançam um enxame de 50 drones das portas de uma van. Este episódio em si é bastante realista; um dos problemas com armas autônomas é que um pequeno grupo de pessoas pode lançar um ataque em maior escala do que se tivesse armas convencionais. Um vagão com 50 drones é uma opção bastante razoável. Mas o filme leva a idéia a um absurdo. Alega-se que cerca de 8.300 pessoas foram mortas em ataques simultâneos. Então, se as pessoas com uma van retratarem um ataque típico, então, por esses danos, os terroristas teriam que realizar cerca de 160 ataques em todo o mundo. Os terroristas costumam realizar ataques coordenados, mas seu número geralmente

não excede dez . E o vídeo assume não apenas a presença de super-armas, mas também que ele caiu nas mãos dos super-vilões.

No filme, o hype e o medo são usados para superar as premissas críticas, o que interfere com uma discussão racional dos riscos associados ao acesso dos terroristas a

armas autônomas . A partir do vídeo, fica claro que devemos ter medo. Mas por que ter medo? Armas que escolhem seus objetivos por conta própria (sobre isso, a propósito, nem tudo está claro no vídeo)? Armas sem contramedidas? Que terroristas podem pôr as mãos em armas? Recursos de armas autônomas para aumentar os ataques? Se você quer causar medo de robôs assassinos, este vídeo é ideal para você. Mas quando você tenta analisar minuciosamente o problema, ele não fica nem um simples estudo. O vídeo não apresenta argumentos, mas está empenhado em criar sensações baratas e aumentar o medo.

Naturalmente, o objetivo do vídeo é incentivar os espectadores a agir com medo.

O vídeo termina com as palavras de um professor da Universidade da Califórnia em Berkeley,

Stuart Russell , alertando sobre os perigos das armas autônomas e instando o espectador a agir para que esse pesadelo não se torne realidade. Eu respeito muito Stuart Russell, um pesquisador de IA e uma pessoa que contribui para disputas autônomas de armas. Convidei Russell para

eventos no

Center for New American Security , onde estou envolvido em um programa de pesquisa relacionado à

IA e segurança global . Não tenho dúvidas de que as opiniões de Russell são sinceras. Mas o vídeo, na tentativa de convencer o espectador, cria um aplicativo não suportado.

Para piorar a situação, a

solução proposta - o

tratado que proíbe armas autônomas - não resolverá os problemas reais que a humanidade enfrenta com o desenvolvimento da autonomia de armas. A proibição não impedirá os terroristas de fabricar armas robóticas caseiras. Além disso, a proibição de tais armas, demonstrada no vídeo, não afetará os riscos associados ao surgimento de armas autônomas nas forças armadas. De fato, não está claro se a arma mostrada no filme cairá sob tal proibição, porque ali atua de maneira muito seletiva.

Focalizando cenários extremos e improváveis, o filme realmente impede o progresso na abordagem dos problemas reais em torno das armas autônomas. É provável que os estados entre os líderes no desenvolvimento de armas robóticas notem medos com base neste filme. O filme derrama água no moinho

daqueles que afirmam que o medo de armas autônomas é irracional e propenso a exageros excessivos.

Armas autônomas levantam questões importantes sobre a obediência às leis da guerra, sobre riscos e controle e sobre o papel moral das pessoas nas hostilidades. Essas são questões importantes que merecem uma discussão séria. Quando Russell e outros se

envolvem em um

debate animado sobre essas questões, saúdo essa discussão. Mas o filme especificado não se enquadra nessa categoria. O vídeo capturou com sucesso a atenção da mídia, mas sua propensão a sensações dificulta as sérias discussões intelectuais que precisam ser realizadas sobre o assunto de armas autônomas.

Paul Sharr é membro sênior, diretor de tecnologia e segurança pública do New American Security Center (CNAS). De 2009 a 2012, ele liderou o grupo de trabalho do Departamento de Defesa dos EUA, que desenvolveu diretrizes para o uso da autonomia em armamentos.