A histeria em torno do futuro da inteligência artificial (IA) dominou o mundo. Não faltam notícias sensacionais sobre como a IA pode

curar doenças ,

acelerar a inovação e

melhorar a

criatividade de uma pessoa. Se você ler as manchetes da mídia, poderá decidir que já está vivendo em um futuro em que a IA penetrou em todos os aspectos da sociedade.

Embora não se possa negar que a IA tenha aberto um

rico conjunto de oportunidades promissoras para nós , também levou ao surgimento do pensamento, que pode ser descrito como fé na onipotência da IA. De acordo com essa filosofia, se houver dados suficientes, os algoritmos de aprendizado de máquina

serão capazes de resolver todos os problemas da humanidade .

Mas essa ideia tem um grande problema. Ele não suporta o progresso da IA, mas coloca em risco o valor da inteligência da máquina, negligenciando importantes princípios de segurança e configurando as pessoas para expectativas irreais sobre os recursos da IA.

Crença na onipotência da IA

Em apenas alguns anos, a crença na onipotência da IA passou das conversas dos evangelistas de tecnologia do Vale do Silício para as mentes de representantes do governo e legisladores de todo o mundo. O pêndulo passou do conceito anti-utópico de

IA que destrói a humanidade para a fé utópica na

vinda de nosso salvador algorítmico .

Já vimos como os governos fornecem apoio aos programas nacionais de desenvolvimento de IA e competem na

corrida armamentista retórica e tecnológica para obter uma vantagem no setor de Machine Learning (MO) em expansão. Por exemplo, o governo britânico

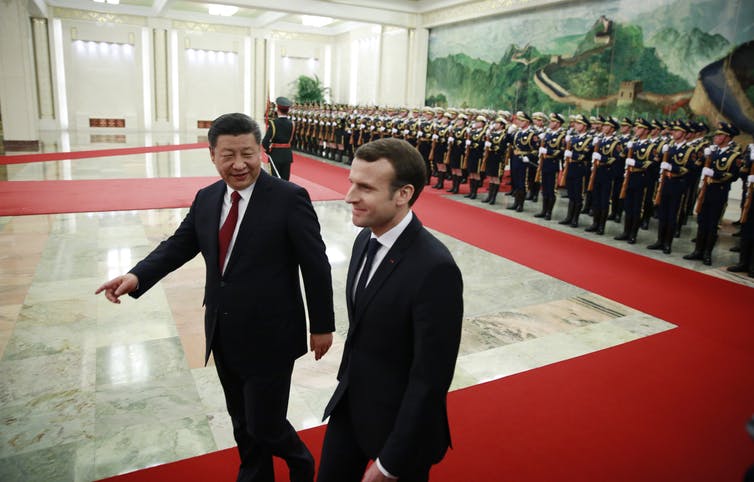

prometeu investir £ 300 milhões em pesquisa de IA para se tornar um líder nesse campo. Fascinado pelo potencial transformador da IA, o presidente francês

Emmanuel Macron decidiu

transformar a França em um centro internacional de IA . O governo chinês está aumentando suas capacidades de IA com um

plano do governo para criar uma indústria chinesa de IA de US $ 150 bilhões até 2030. A crença na onipotência da IA está ganhando força e não vai desistir.

Redes neurais - mais fácil falar do que fazer

Enquanto muitas declarações políticas divulgam os efeitos transformadores da iminente "

revolução da IA "

, elas geralmente subestimam a complexidade da introdução de sistemas avançados de MO no mundo real.

Uma das variedades mais promissoras da tecnologia de IA são

as redes neurais . Essa forma de aprendizado de máquina é baseada em uma imitação exemplar da estrutura neural do cérebro humano, mas em uma escala muito menor. Muitos produtos baseados em IA usam redes neurais para extrair padrões e regras de grandes quantidades de dados. Mas muitos políticos não entendem que, simplesmente adicionando uma rede neural ao problema, não temos necessariamente a solução imediatamente. Assim, adicionando uma rede neural à democracia, não a tornaremos instantaneamente menos discriminada, mais honesta ou personalizada.

Desafiando a burocracia de dados

Os sistemas de IA requerem uma enorme quantidade de dados para funcionar, mas no setor público geralmente não há

infraestrutura de dados adequada para suportar sistemas avançados de MO. A maioria dos dados é armazenada em arquivos offline. Um pequeno número de fontes de dados digitalizados existentes está se afogando na burocracia. Os dados costumam ser distribuídos por vários departamentos governamentais, cada um dos quais requer permissão especial para acesso. Entre outras coisas, o setor público geralmente não possui talentos suficientes equipados com as habilidades técnicas necessárias para colher plenamente os

benefícios da IA .

Por esses motivos, o

sensacionalismo relacionado à IA recebe muitas críticas. Stuart Russell, professor de ciência da computação em Berkeley, há muito tempo defende uma abordagem mais realista, concentrando-se nas

aplicações mais simples e cotidianas da IA, em vez da aquisição hipotética do mundo por robôs superinteligentes. Da mesma forma, o professor de robótica do MIT,

Rodney Brooks, escreve que "quase todas as inovações em robótica e IA exigem muito, muito mais tempo para uma implementação real do que é imaginado pelos especialistas neste campo e por todos os outros".

Um dos muitos desafios para implantar sistemas MO é que a IA é extremamente

vulnerável a ataques . Isso significa que uma IA mal-intencionada pode atacar outra AI para forçá-lo a emitir previsões incorretas ou agir de uma certa maneira. Muitos

pesquisadores alertaram que é impossível lançar imediatamente a IA sem preparar

padrões de segurança e mecanismos de proteção adequados. Mas até agora, o tópico de segurança da IA não recebeu a devida atenção.

O aprendizado de máquina não é mágico

Se queremos colher os benefícios da IA e minimizar os riscos em potencial, precisamos começar a refletir sobre como podemos aplicar IO de maneira significativa a determinadas áreas do governo, negócios e sociedade. E isso significa que precisamos começar a discutir a

ética da IA e a

desconfiança de muitas pessoas no MO.

Mais importante, precisamos entender as limitações da IA e os pontos em que as pessoas ainda precisam assumir o controle. Em vez de desenhar uma imagem irrealista dos recursos de IA, você precisa dar um passo atrás e

separar os recursos tecnológicos reais da IA da mágica.

Por um longo tempo, o

Facebook acreditou que problemas como a disseminação da desinformação e o incitamento ao ódio podiam ser reconhecidos e interrompidos por algoritmos. Mas, sob pressão dos legisladores, a empresa rapidamente prometeu substituir seus algoritmos por um

exército de 10.000 revisores humanos .

Na medicina, eles também reconhecem que a IA não pode ser considerada a solução para todos os problemas. O programa

IBM Watson para Oncologia era uma IA que deveria ajudar os médicos a combater o câncer. E, embora tenha sido projetado para oferecer as melhores recomendações, os especialistas acham

difícil confiar na máquina . Como resultado, o programa foi

fechado na maioria dos hospitais, onde foram realizados os ensaios.

Problemas semelhantes surgem no campo legislativo quando

algoritmos foram usados nos tribunais dos EUA para pronunciar sentenças. Os algoritmos calcularam valores de risco e deram

recomendações aos juízes sobre sentenças. Mas o sistema reforça a discriminação racial estrutural, após o que foi abandonado.

Esses exemplos mostram que não há soluções baseadas em IA para tudo. Usar a IA em benefício da própria AI nem sempre é produtivo ou útil. Nem todo problema é melhor resolvido usando a inteligência da máquina. Esta é a lição mais importante para todos que pretendem aumentar os investimentos em programas governamentais de desenvolvimento de IA: todas as decisões têm um preço e nem tudo o que pode ser automatizado precisa ser automatizado.