Olá Habr! Apresento a você a tradução do artigo "

Veja como um detector de mentiras de IA pode dizer quando você está mentindo ", de Rob Verger.

Hoje, a inteligência artificial está em toda parte - determina o que está nas fotos de alimentos (em sites como o Yelp), ajuda os pesquisadores a tentar acelerar o processo de ressonância magnética e pode até procurar sinais de depressão na voz de uma pessoa. Mas é improvável que muitos tenham pensado em usar a inteligência artificial como um detector de mentiras.

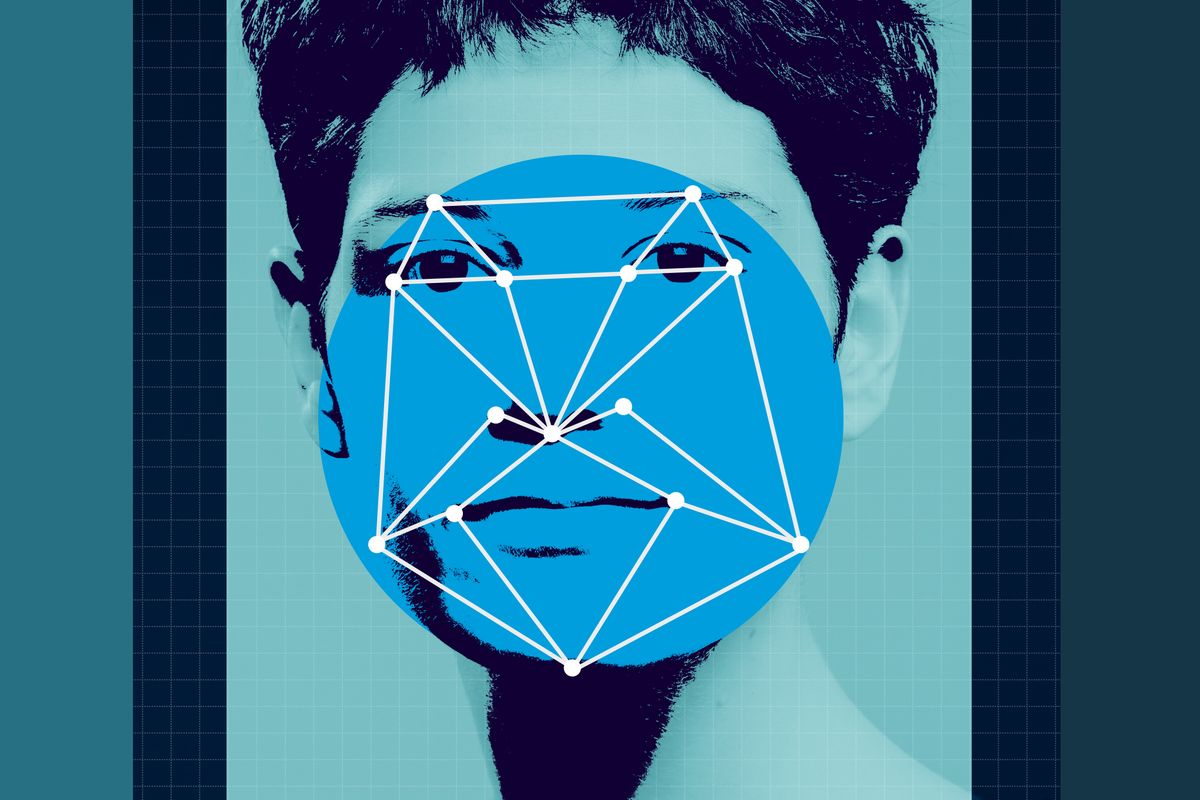

Essa idéia - um detector de mentiras de IA - está sendo notícia agora porque o novo projeto de segurança de fronteiras na Europa, “iBorderCtrl”, inclui tecnologia focada na “detecção de fraudes”. Essa iniciativa inclui um processo de duas etapas, e uma etapa incluindo a "detecção de fraude" funciona em casa. De acordo com a Comissão Europeia, o protocolo começa com uma pré-seleção, durante a qual os viajantes “usam uma webcam para responder a perguntas feitas por um guarda de fronteira animado que é selecionado de acordo com o sexo, etnia e idioma do viajante. Uma abordagem única para "detectar fraudes" analisa as menores alterações nas expressões faciais dos viajantes para determinar se o entrevistado está mentindo. "

Tudo isso soa como ficção científica e, é claro, lembra a história problemática de um polígrafo. Mas essa inteligência artificial é bastante real. A única questão é quão precisa pode ser.

Rada Michalcha, professora de ciência da computação e engenharia da Universidade de Michigan, trabalha na detecção de fraudes há cerca de dez anos. Assim, um detector de mentiras AI e seu princípio de operação foram construídos.

A primeira coisa que os pesquisadores que trabalham com inteligência artificial e aprendizado de máquina precisam é de dados. Nesse caso, a equipe da Rada Mikhalcha começou com um vídeo de casos reais. Por exemplo, um réu em um julgamento em que foi condenado pode fornecer um exemplo de fraude; declarações de testemunhas também foram usadas como exemplos de testemunhos verdadeiros ou falsos. (É claro que os algoritmos de aprendizado de máquina dependem diretamente dos dados que eles usam, por isso é importante lembrar que uma pessoa considerada culpada de um crime pode ser realmente inocente.)

Como resultado, foram utilizados 121 videoclipes e transcrições correspondentes do que foi dito (a proporção de declarações falsas e verdadeiras é de aproximadamente um para um). Esses dados permitiram à equipe criar classificadores para aprendizado de máquina, que tiveram uma precisão de 60 a 75%.

Que padrão o sistema notou? “Uso de pronomes. As pessoas que tentam mentir raramente usam os pronomes 'eu' ou 'nós' e geralmente mencionam coisas relacionadas a eles. Em vez disso, eles costumam usar os pronomes 'você', 'seu', 'ele (a)', 'eles' ”. - explica Rada Mikhalcha.

Este não é o único atributo linguístico. As pessoas que mentem tendem a usar "palavras mais fortes" que "expressam confiança", diz Rada Mihalcha. Exemplos de tais palavras são palavras como "absolutamente" e "muito", quando os que dizem a verdade, ao contrário, evitam respostas usando palavras como "talvez" ou "provavelmente".

"Acredito que as pessoas enganosas provavelmente compensarão suas mentiras tentando parecer mais autoconfiantes."

Quanto às expressões faciais, o Mikhalcha Rada enfatiza que as pessoas que mentem têm maior probabilidade de olhar diretamente nos olhos da pessoa que as entrevistou. Essas pessoas também costumam usar as duas mãos para gesticular, em vez de uma, porque, de acordo com a suposição de Rada Mikhalch, estão tentando parecer mais convincentes. (Obviamente, esses são apenas modelos: se alguém olha nos seus olhos e gesticula com as duas mãos enquanto fala, isso não significa que ela esteja mentindo.)

Esta é uma lista de dados notáveis que a IA é capaz de perceber assim que os pesquisadores lhe dão exemplos com os quais ele pode trabalhar e com o qual pode aprender. Mas até a própria Rada Mikhalcha admite que seu trabalho "não é perfeito". "Como pesquisadores, estávamos muito empolgados por termos conseguido uma precisão de 75%". Mas, por outro lado, isso significa que a probabilidade de erro é de uma em quatro. "Não acho que essa IA possa ser usada na prática, porque a probabilidade de erro é de até 25%."

Por fim, Rada Mihalcha vê essa tecnologia muito útil para as pessoas. Por exemplo, essa tecnologia pode mostrar que ela notou algo "incomum" na declaração de alguém e, posteriormente, essa pessoa pode ser novamente questionada. Esse uso da IA não é incomum: uma tecnologia que amplia o que as pessoas podem fazer.