Um dos pincéis remove / adiciona árvores, o outro - de pessoas, etc.As redes de contenção generativa (GANs) criam imagens incrivelmente realistas, geralmente indistinguíveis das reais. Desde a invenção de tais redes em 2014, muitas pesquisas foram feitas nessa área e várias aplicações foram criadas, inclusive para

manipulação de imagens e

previsão de vídeo . Várias variantes de GAN foram desenvolvidas e os experimentos estão em andamento.

Apesar desse tremendo sucesso, muitas questões permanecem. Não está claro quais são exatamente as razões para os artefatos terrivelmente irrealistas, que conhecimento mínimo é necessário para gerar objetos específicos, por que uma variante da GAN funciona melhor que a outra, que diferenças fundamentais são codificadas em suas escalas? Para entender melhor o funcionamento interno da GAN, pesquisadores do Instituto de Tecnologia de Massachusetts, MIT-IBM Watson AI e IBM Research desenvolveram a estrutura GANDissection e o programa

GANpaint , um editor gráfico em uma rede adversária generativa.

O trabalho é acompanhado por um

artigo científico que explica em detalhes a funcionalidade da estrutura e discute as perguntas para as quais os pesquisadores estão tentando encontrar respostas. Em particular, eles estão tentando estudar as

representações internas de redes competitivas

entre gerações. A “estrutura analítica para visualizar e entender o GAN no nível de unidades, objetos e cenas”, isto é, a estrutura de seleção GAND, deve ajudar.

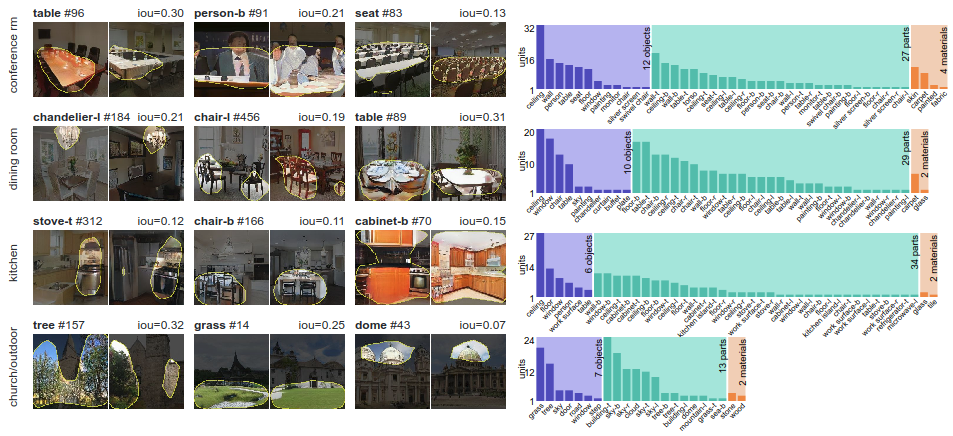

Pelo método de dividir uma imagem em partes (dissecação de rede baseada em segmentação), o sistema determina grupos de "unidades interpretadas" que estão intimamente relacionadas aos conceitos de objetos. Em seguida, é realizada uma avaliação quantitativa das causas que causam alterações nas unidades interpretadas. Isso é feito "medindo a capacidade das intervenções para controlar objetos na saída". Simplificando, os pesquisadores estudam a relação contextual entre objetos específicos e seu ambiente, introduzindo objetos detectados em novas imagens.

A estrutura de dissecção da GAN demonstra que os neurônios específicos da GAN são treinados, dependendo do tipo de cena que ele está aprendendo a desenhar: por exemplo, um neurônio de jaqueta aparece ao estudar salas de conferência e um neurônio de placa aparece ao desenhar cozinhas

A estrutura de dissecção da GAN demonstra que os neurônios específicos da GAN são treinados, dependendo do tipo de cena que ele está aprendendo a desenhar: por exemplo, um neurônio de jaqueta aparece ao estudar salas de conferência e um neurônio de placa aparece ao desenhar cozinhasPara garantir que conjuntos de neurônios controlem o desenho de objetos, e não apenas se correlacionem, a estrutura intervém na rede e ativa e desativa diretamente os neurônios. É assim que o editor gráfico GANpaint funciona - essa é uma demonstração visual da estrutura analítica.

O GANpaint ativa e desativa neurônios em uma rede treinada para criar imagens. Cada botão no painel esquerdo corresponde a um conjunto de 20 neurônios. Apenas sete botões:

- uma arvore;

- grama

- a porta;

- o céu;

- uma nuvem;

- tijolo;

- a cúpula.

O GANpaint pode adicionar ou remover esses objetos.

Ao trocar os neurônios diretamente, você pode observar a estrutura do mundo visual que a rede neural aprendeu a modelar.

Ao estudar os resultados do trabalho de outras redes competitivas entre gerações, um estranho pode fazer uma pergunta: a GAN realmente cria uma nova imagem ou apenas compõe uma cena a partir de objetos que encontrou durante o treinamento? Talvez a rede se lembre das imagens e depois as reproduza da mesma maneira? Este trabalho de pesquisa e o editor GANpaint mostram que as redes realmente aprenderam alguns aspectos da composição, dizem os autores.

Uma descoberta interessante é que os mesmos neurônios controlam uma certa classe de objetos em contextos diferentes, mesmo que a aparência final do objeto varie bastante. Os mesmos neurônios podem mudar para o conceito de “porta”, independentemente de você precisar adicionar uma porta pesada em uma parede de pedra grande ou uma porta pequena em uma cabana minúscula. O GAN também entende quando e quando os objetos não podem ser criados. Por exemplo, quando os neurônios da porta são ativados, a porta realmente aparece no lugar certo no edifício. Mas se você faz o mesmo no céu ou em uma árvore, geralmente essa tentativa não tem efeito.

O artigo científico

“Dissecção GAN: visualizando e compreendendo redes adversárias generativas” foi publicado em 26 de novembro de 2018 no site de pré-impressão arXiv.org (arXiv: 1811.10597v2).

Demonstrações interativas, vídeos, código e dados são publicados

no Github e no

site do MIT .