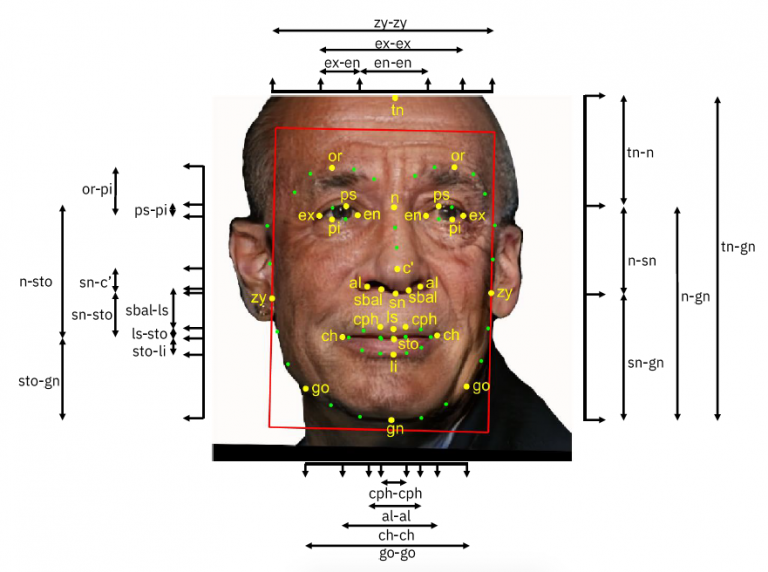

Conjunto de dados Diversity in Faces anotado pela IBM

Conjunto de dados Diversity in Faces anotado pela IBMRecentemente, a IBM

foi criticada por tirar fotos publicamente disponíveis de hospedagem de fotos do Flickr e outros sites onde os usuários postam suas fotos para treinar redes neurais sem permissão. Formalmente, tudo está de acordo com a lei - todas as fotos são publicadas sob uma licença Creative Commons - mas as pessoas se sentem desconfortáveis porque a IA aprende com seus rostos. Alguns nem sabiam que foram fotografados. Como você sabe, para fotografar uma pessoa em um local público, você não precisa pedir permissão.

Segundo relatos da mídia, a IBM usou aproximadamente 1 milhão de fotos privadas do Flickr para treinar seu sistema de reconhecimento facial. Porém, na verdade, a IBM não copiou fotos do Flickr, essas imagens fazem parte do

conjunto de dados

YFCC100M de 99,2 milhões de fotos disponíveis para o treinamento de redes neurais. Essa base também foi feita pelo Yahoo, ex-proprietário do Flickr.

Acontece que a história da IBM é apenas a ponta do iceberg. Aqui, a empresa caiu acidentalmente na distribuição e, de fato, as fotos dos usuários há muito tempo são usadas para treinar uma variedade de sistemas, isso já se tornou uma prática comum: “Nosso estudo mostrou que o governo, pesquisadores e empresas dos EUA usavam imagens de imigrantes, crianças vítimas de abuso e pessoas mortas para testar seus sistemas de reconhecimento facial ”,

escreve Slate . Enfatiza que mesmo agências governamentais como o Instituto Nacional de Padrões e Tecnologia (NIST) praticam essas atividades.

Em particular, o NIST opera o programa de Teste de Verificação de Reconhecimento Facial (FRVT) para testes padronizados de sistemas de reconhecimento de rosto desenvolvidos por empresas terceirizadas. Este programa permite avaliar todos os sistemas da mesma maneira, comparando-os objetivamente entre si. Em alguns casos,

prêmios em dinheiro de até US $ 25 mil são ganhos por vencer a competição, mas mesmo sem uma recompensa monetária, uma pontuação alta no teste NIST é um poderoso incentivo para o sucesso comercial da empresa de desenvolvimento, porque os clientes em potencial prestam atenção imediata a esse sistema e a classificação A + pode ser mencionada em comunicados de imprensa e materiais promocionais.

Para avaliar o NIST, grandes conjuntos de dados são usados com fotografias de rostos tirados em diferentes ângulos e em diferentes condições de iluminação.

Uma investigação do

Slate revelou que o conjunto de dados do NIST inclui as seguintes fotografias:

Muitas fotos foram tiradas por funcionários do Departamento de Segurança Interna (DHS) em locais públicos, enquanto no processo de fotografar os transeuntes, os funcionários do DHS posavam como turistas que fotografavam os arredores.

Os conjuntos de dados do NIST contêm milhões de imagens de pessoas. Como a coleta de dados ocorreu em locais públicos, literalmente qualquer pessoa pode estar nesse banco de dados. O NIST está distribuindo ativamente seus conjuntos de dados, permitindo que todos baixem, armazenem e usem essas fotos para desenvolver sistemas de reconhecimento de rosto (as imagens de exploração infantil não são publicadas). É impossível dizer quantos sistemas comerciais usam esses dados, mas

vários projetos científicos o fazem

com certeza, escreve

Slate .

Em um comentário à publicação, um porta-voz do NIST disse que a base FRVT está sendo coletada por outras organizações governamentais de acordo com suas tarefas, o que também se aplica à base com fotos de crianças. O NIST usa esses dados em estrita conformidade com a lei e os regulamentos existentes. Ele confirmou que o banco de dados com pornografia infantil é realmente usado para testar produtos comerciais, mas as crianças nesse banco de dados são anônimas, ou seja, seus nomes e local de residência não são indicados. Os funcionários do NIST não visualizam essas fotos, elas são armazenadas nos servidores DHS.

Um conjunto de dados com fotografias de crianças é utilizado desde pelo menos 2016. De acordo com a

documentação para desenvolvedores , inclui “fotografias de crianças desde a idade de uma criança até um adolescente”, onde a maioria das imagens mostra “coerção, violência e atividade sexual”. Essas imagens são consideradas particularmente difíceis de reconhecer devido à maior variabilidade de posição, contexto etc.

Esse conjunto de dados provavelmente é usado para sistemas de treinamento e teste para

filtragem automática de conteúdo obsceno .

Os jornalistas também destacam o “viés” do conjunto de dados do Multiple Encounter Dataset. Embora os negros representem apenas 12,6% da população dos EUA, 47,5% estão no banco de dados de fotografias de criminosos, e é por isso que a IA também pode aprender preconceitos e

se tornar racista .