Você ainda não entende por que ReLU é melhor que sigmóide, como o Rprop difere do RMSprop, por que normaliza sinais e o que é pular conexão? Por que uma rede neural precisa de um gráfico e que erro cometeu ao se propagar de volta? Você tem um projeto com visão computacional ou talvez esteja criando um robô intergaláctico para lidar com louça suja e deseja que ele possa decidir por si mesmo, se lavar ou o que fará?

Estamos lançando o

curso aberto

“Redes neurais e visão computacional” , dirigido àqueles que estão dando seus primeiros passos nessa área. O curso foi desenvolvido por especialistas da Samsung Research Russia: Samsung Research Center e Samsung Center for Artificial Intelligence em Moscou. Pontos fortes do curso:

- os autores do curso sabem do que estão falando: são engenheiros do Centro de Inteligência Artificial de Moscou Samsung, Mikhail Romanov e Igor Slinko;

- Existe uma teoria com problemas e prática no PyTorch

- comece a praticar imediatamente após dominar o conhecimento teórico mínimo.

- os melhores alunos serão convidados para uma entrevista na Samsung Research Russia!

Este curso foi aberto em 1º de junho, o primeiro de uma série de cursos on-line gratuitos da Samsung na plataforma Stepik. Foi dada preferência especificamente à plataforma russa - isso proporcionará mais oportunidades para o público que fala russo. Os cursos se concentrarão principalmente no aprendizado de máquina (ML). A escolha não é acidental: em maio de 2018, o Samsung Artificial Intelligence Center foi aberto em Moscou, onde estrelas científicas da ML, como Viktor Lempitsky (o cientista russo mais citado na categoria Ciência da Computação), Dmitry Vetrov, Anton Konushin, Sergey Nikolenko e muitos outros trabalham.

Assim, durante 6 semanas de vídeo-aulas e exercícios práticos, fazendo de 3 a 5 horas por semana, você será capaz de descobrir como resolver os problemas básicos da visão de máquina e também obter o treinamento teórico necessário para um estudo independente da área.

Supõe-se dois modos de curso: básico e avançado. No primeiro caso, basta assistir a palestras, responder perguntas sobre palestras e resolver seminários. No segundo caso, será necessário resolver problemas teóricos nos quais será necessário aplicar conhecimentos suficientemente amplos da matemática de 1 a 2 cursos de uma universidade técnica.

O curso define consistentemente a terminologia e os princípios da construção de redes neurais, fala sobre tarefas modernas, métodos de otimização, funções de perda e as arquiteturas básicas das redes neurais. E no final do treinamento - a solução de uma tarefa visual aplicada de visão computacional.

Professores do curso

Mikhail Romanov

Mikhail RomanovMIPT graduado. Ele se formou na Yandex Data Analysis School. Ele obteve seu PhD pela Universidade Técnica da Dinamarca.

Um funcionário do Moscow AI Center Samsung. Michael está envolvido em tarefas de visão de máquina para robôs e adora ensinar. Ele tem muitas idéias e tópicos para outros cursos. Um dos graduados do AI Bootcamp 2018, realizado no Samsung Center for Artificial Intelligence, escreveu no questionário de saída sobre a questão de avaliar Mikhail em uma escala de 5 pontos como professor, "é uma pena que não haja uma classificação de seis!"

Igor Slinko

Igor SlinkoMIPT graduado. Ele se formou na Yandex Data Analysis School. Um funcionário do Moscow AI Center Samsung. Igor também lida com tarefas de visão de máquina para robôs e ensina Machine Learning na Higher School of Economics. No ano passado e este ano, ele foi palestrante voluntário no workshop Deep Learning do projeto social e educacional da

Escola de Verão , organizado em parceria com a Samsung Research Russia.

Programa do curso

Rede neural:

- Modelo matemático de neurônio

- Operações booleanas na forma de neurônios

- Do neurônio à rede neural

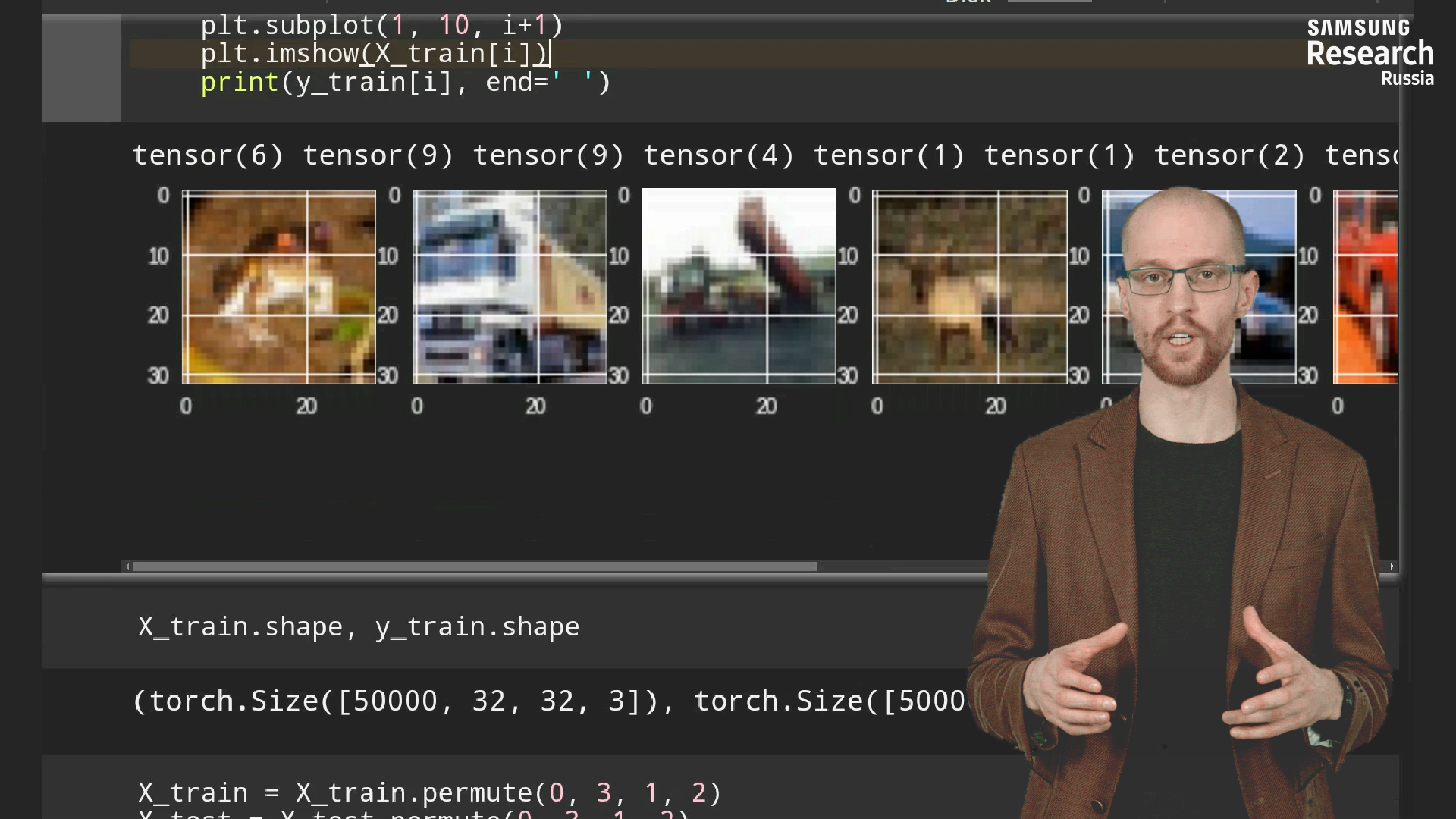

- Workshop: Trabalho Básico em PyTorch

Crie a primeira rede neural:

- Recuperação de dependência de rede neural

- Componentes de rede neural

- Objetivos Teóricos: Recuperação de Dependências

- Algoritmo de ajuste de rede neural

- Problemas Teóricos: Gráficos de Computação e BackProp

Tarefas resolvidas usando redes neurais:

- Classificação binária? Entropia cruzada binária!

- Classificação multiclasse? Softmax!

- Localização, detecção, super-resolução

- Problemas Teóricos: Funções de Perda

- Workshop: Construindo a Primeira Rede Neural

- Workshop: Classificação no PyTorch

Métodos de otimização:

- A descida de gradiente mais comum

- Modificações de descida de gradiente

- Objetivos teóricos: Compreendendo o SGD com impulso

- Workshop: Implementando descida de gradiente usando o PyTorch

- Workshop: Classificação de números manuscritos por uma rede totalmente conectada

Redes neurais convolucionais:

- Convolução, cascata de convoluções

- História das Arquiteturas: LeNet (1998)

- História da Arquitetura: AlexNet (2012) e VGG (2014)

- História das arquiteturas: GoogLeNet e ResNet (2015)

- Workshop: Reconhecimento de escrita por rede neural convolucional

Regularização, normalização, método da máxima verossimilhança:

- Regularização e redes neurais

- Normalização de dados

- Seminário: Resolvemos o problema de classificação no conjunto de dados CIFAR

- Método de máxima verossimilhança

- Seminário: Transfira o aprendizado sobre o exemplo da competição no Kaggle

Requisitos do aluno

O curso foi desenvolvido para estudantes que dão os primeiros passos no campo do aprendizado de máquina. O que é necessário de você?

- Possuir conhecimentos básicos no campo da estatística matemática.

- Esteja preparado para programar em Python.

- Se você deseja fazer um curso em um nível difícil, precisará de um bom conhecimento de análise matemática, álgebra linear, teoria das probabilidades e estatística.

A chamada é aceita? Então

prossiga para o curso !