O ecossistema em torno do Google Assistant está crescendo incrivelmente rápido. Em abril de 2017, apenas 165 ações estavam disponíveis para os usuários, e hoje apenas em inglês existem mais de 4.500. O quão diversificado e interessante o canto de língua russa do universo do Google Assistant se tornará depende dos desenvolvedores. Existe uma fórmula de ação ideal? Por que separar código e conteúdo do script? O que deve ser lembrado ao trabalhar em uma interface de conversação? Pedimos à equipe da Just AI, desenvolvedora de tecnologias de IA de conversação, que compartilhasse hacks para criar aplicativos para o Google Assistant. Na plataforma Aimylogic da Just AI, foram criadas várias centenas de jogos de ação, entre os quais existem muito populares - mais de 140 mil pessoas já jogaram o jogo

"Sim, meu senhor" . Como criar um trabalho adequado para a ação dos sonhos, diz Dmitry Chechetkin, chefe de projetos estratégicos da Just AI.

Agite, mas não misture: o papel do script, conteúdo e código

Qualquer aplicativo de voz consiste em três componentes - um script interativo, conteúdo com o qual a ação interage e lógica programável, ou seja, código.

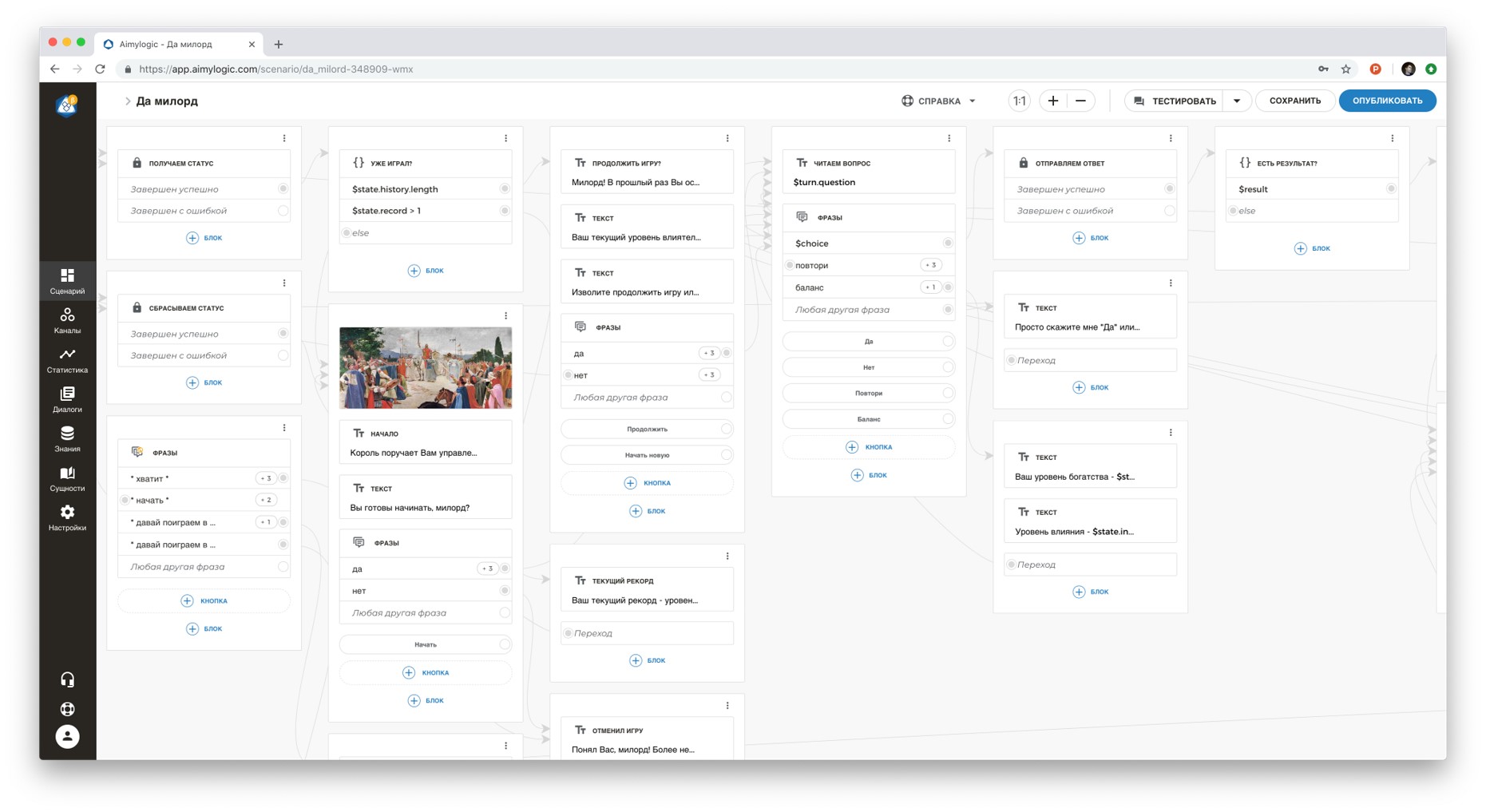

O cenário é talvez o principal. Ele descreve quais frases um usuário pode falar, como uma ação deve reagir a ele, em que estados ele entra e como exatamente ele responde. Faço programação há 12 anos, mas quando se trata de criar uma interface de conversação, recorro a várias ferramentas visuais.

Para iniciantes, não faz mal desenhar um esboço simples do script no papel. Então você decide o que e o que se segue no diálogo. Em seguida, você pode transferir o script para algum produto para visualizá-lo. O Google se oferece para criar uma caixa de diálogo

Dialogflow totalmente personalizada e para os cenários mais simples e curtos que não exigem um amplo entendimento do idioma,

Actions SDK . Outra opção é um designer visual com o Aimylogic

NLU (

como criar uma ação para o Google Assistant no Aimylogic ), no qual você pode criar um script sem nenhuma habilidade aprofundada de programação e também testar imediatamente a ação. Uso o Aimylogic para ver como todas as transições no meu diálogo funcionarão, para testar e validar a hipótese em si e a idéia do que eu quero implementar.

Lógica programável é frequentemente necessária. Por exemplo, seu site pode parecer legal, mas, para "saber como", ele deve se referir ao código no servidor - e o código poderá calcular algo, salvar e retornar o resultado. A mesma coisa com o script de ação. O código deve funcionar sem problemas e melhor se for totalmente gratuito. Hoje, não há necessidade de pagar milhares de dólares para que um código de 50, 100, 1000 linhas esteja disponível para sua ação 24/7. Eu uso vários serviços para isso de uma só vez:

Google Cloud Functions , Heroku, Webtask.io, Amazon Lambda. O Google Cloud Platform fornece uma gama bastante ampla de serviços

gratuitamente em seu

nível gratuito .

O script pode acessar o código usando as chamadas http mais simples às quais estamos acostumados. Mas, ao mesmo tempo, o código e o script não se misturam. E isso é bom, porque você pode manter esses dois componentes atualizados e expandi-los como quiser, sem complicar o trabalho da ação.

O terceiro componente é o conteúdo. São dados que podem mudar o tempo todo, sem afetar a estrutura do próprio script. Por exemplo, perguntas do teste ou episódios em nosso jogo

Sim Sim . Se o conteúdo vivesse com o script ou com o código, esse script se tornaria mais complicado. E, nesse caso, não importa qual ferramenta você use para criar uma ação, trabalhar com ela ainda será inconveniente para você. Portanto, recomendo armazenar o conteúdo separadamente: no banco de dados, em um arquivo no armazenamento em nuvem ou em uma tabela que o script também possa acessar por meio da API para receber dados em tempo real. Separando o conteúdo do script e do código, você pode atrair outras pessoas para trabalhar na ação - elas poderão reabastecer o conteúdo independentemente de você. E o desenvolvimento do conteúdo é muito importante, porque o usuário espera da ação, para a qual ele retorna, repetidas vezes, conteúdo novo e diversificado.

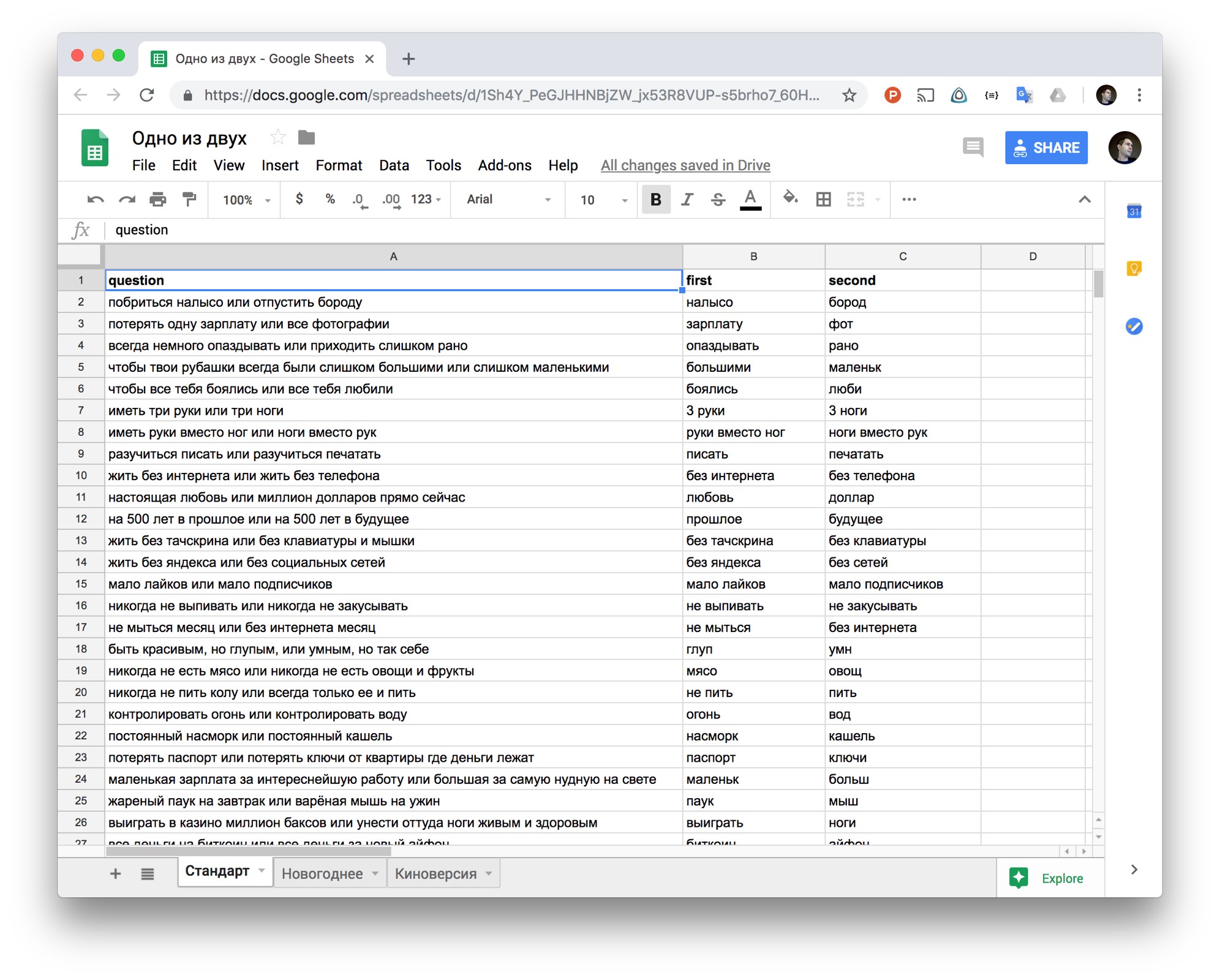

Como usar tabelas comuns na nuvem para não armazenar todo o conteúdo do próprio script? Por exemplo, no jogo

“Primeiro ou Segundo” , usamos uma planilha do Excel baseada em nuvem, na qual qualquer um dos participantes do projeto poderia adicionar novas perguntas e respostas para a ação. O script aimylogic acessa essa tabela usando uma única solicitação http por meio de uma API especial. Como você pode ver, o próprio script é pequeno - porque não armazena todos os dados da tabela, que é atualizada todos os dias. Assim, separamos o script interativo do conteúdo, o que nos permite trabalhar com o conteúdo de forma independente e coletivamente reabastecer o script com dados atualizados. A propósito, 50 mil pessoas já jogaram este jogo.

Lista de verificação: coisas a serem lembradas ao criar uma interface de conversação

Qualquer interface possui componentes com os quais o usuário interage: listas, botões, imagens e muito mais. A interface de conversação existe de acordo com as mesmas leis, mas a diferença fundamental é que uma pessoa se comunica com o programa por voz. A partir disso, devemos construir, criando nossa própria ação.

A ação correta não deve ser capaz de fazer tudo no mundo. Quando uma pessoa fala com um programa, ela não consegue manter muitas informações em mente (lembre-se de como você escuta ofertas pessoais de vários andares de um banco ou operadora de telefonia móvel por telefone). Desista do supérfluo e concentre-se em uma única função, mas a mais importante do seu serviço, que será executada de maneira mais conveniente usando sua voz, sem tocar na tela.

Por exemplo, você tem um serviço de ticket. Você não deve esperar que o cliente comece o cenário habitual com uma voz - procure uma passagem de acordo com cinco ou seis critérios, escolha entre transportadoras, compare e pague. Mas um aplicativo que informa o preço mínimo na direção escolhida pode ser útil: esta é uma operação muito rápida, e é conveniente executá-lo por voz sem abrir o site, sem ter que passar pelo script de "preenchimento de formulário" a cada vez (quando você preenche os campos e seleciona filtros )

A ação é sobre a voz, não sobre o serviço como um todo. O usuário não deve se arrepender de ter iniciado a ação no Assistente e não ter entrado, por exemplo, no aplicativo ou no site. Mas como entender que não se pode prescindir de uma voz? Para começar, tente a ideia de ação em si mesmo. Se você puder executar facilmente a mesma ação sem voz, não fará sentido. Um dos meus primeiros aplicativos de assistente foi o

Yoga for the Eyes . Esse é um personal trainer virtual que ajuda a fazer exercícios de visão. Não há dúvida de que uma voz é necessária aqui: seus olhos estão ocupados com exercícios, você está relaxado e focado nas recomendações orais. Espiar o memorando, distrair o treinamento, seria inconveniente e ineficaz.

Ou aqui está um exemplo de um script com falha para um aplicativo de voz. Frequentemente, ouço como outra loja online deseja vender algo através de um assistente virtual. Mas encher a cesta com voz é inconveniente e impraticável. E é improvável que o cliente entenda por que ele precisa. Mas a capacidade de repetir a última ordem por voz ou jogar algo em movimento na lista de compras é outra questão.

Lembre-se do UX. A ação deve ser acompanhada pelo usuário: acompanhá-lo e orientá-lo no decorrer do diálogo, para que ele entenda facilmente o que é necessário dizer. Se uma pessoa pára, ela começa a pensar: "E o que vem a seguir?" É um fracasso. Não há necessidade de esperar que seu usuário sempre consulte a ajuda. Os "becos sem saída" precisam ser monitorados (por exemplo, nas análises no

console de ações ) e o usuário deve receber ajuda com perguntas ou dicas sugestivas. No caso da ação por voz, a previsibilidade não é um vício. Por exemplo, em nosso jogo "Sim, meu senhor", cada frase termina para que o participante possa responder "sim" ou "não". Ele não é obrigado a inventar algo sozinho. E não é que este seja um jogo tão elementar. As regras são organizadas de forma que tudo fique extremamente claro para o usuário.

"Ele fala bem!" A ação "ouve" muito bem graças ao Assistente e bem "fala" - graças ao desenvolvedor do script. Uma atualização recente deu ao Google Assistant novas opções de voz e uma pronúncia mais realista. Tudo é legal, mas o desenvolvedor deve refletir sobre a frase, sua estrutura, som, para que o usuário possa entender tudo da primeira vez. Organize tensões, use pausas para fazer com que as frases de ação soem humanas.

Nunca carregue o usuário. Para jogos de ação que expressam notícias ou leem contos de fadas para crianças, isso não é um problema. Mas ouvir o discurso de um assistente de voz sem parar quando você deseja pedir pizza é difícil. Tente tornar as réplicas concisas, mas não monossilábicas e variadas (por exemplo, para pensar em várias opções de saudações, despedidas e até frases, caso o assistente entenda algo errado). O diálogo deve soar natural e amigável, para isso você pode adicionar elementos de fala coloquial, emoções, interjeição a frases.

O usuário não perdoa a estupidez. As pessoas frequentemente culpam os assistentes de voz pela estupidez. E, basicamente, isso acontece quando um assistente ou um aplicativo para ele não consegue reconhecer diferentes variações da mesma frase. Para que sua ação seja tão simples quanto acionar um alarme, é importante que ele ainda entenda sinônimos, formas diferentes de palavras com significado idêntico e que não falhem se o usuário responder imprevisivelmente.

Como sair de situações em que uma ação se recusa a entender? Em primeiro lugar, você pode diversificar as respostas na intenção de fallback padrão - use não apenas o padrão fornecido, mas também os personalizados. Em segundo lugar, você pode treinar o Fallback Intent com todos os tipos de frases de spam que não estão relacionadas ao jogo. Isso ensinará o aplicativo não apenas a responder adequadamente a solicitações irrelevantes, mas também aumentará a precisão da classificação de outros tipos de solicitações.

E mais uma dica. Nunca, nunca faça da sua ação um menu de botões para facilitar a vida do usuário - isso irrita, distrai o diálogo e faz você duvidar da necessidade de usar a voz.

Ensine a ação educada. Mesmo a ação mais legal deve terminar. Idealmente, adeus, após o qual você deseja retornar a ele novamente. A propósito, lembre-se de que, se a ação não fizer uma pergunta, mas simplesmente responder à pergunta do usuário, ele deverá "fechar o microfone" (caso contrário, o aplicativo não será moderado e não será publicado). No caso do Aimylogic, você só precisa adicionar o bloco "Script Completion" ao script.

E se você está contando com a retenção, é importante fornecer outras regras de bom tom no script: a ação deve funcionar em um contexto - lembre-se do nome e do sexo do usuário e não pergunte novamente o que já foi especificado.

Como trabalhar com classificações e críticas

Os usuários do Google Assistant podem avaliar jogos de ação e, assim, influenciar sua classificação. Portanto, é importante aprender a usar o sistema de classificação para sua vantagem. Parece que você só precisa fornecer ao usuário um link para uma página com sua ação e pedir a ele para deixar um comentário. Mas existem regras. Por exemplo, não se ofereça para avaliar a ação na primeira mensagem: o usuário deve entender o que está classificando. Aguarde até que o aplicativo realmente cumpra alguma missão útil ou interessante do usuário e só então se ofereça para deixar uma revisão.

E é melhor não tentar fazer essa solicitação com sua voz, com a ajuda da síntese de fala - você passa o tempo do usuário. Além disso, ele pode não seguir o link, mas dizer "eu aposto cinco", e isso não é o que você precisa neste caso.

No jogo "Sim, meu senhor", exibimos o link para feedback somente após o usuário jogar a próxima rodada. E, ao mesmo tempo, não expressamos a solicitação, apenas exibimos um link para a tela e nos oferecemos para jogar novamente. Prestarei atenção novamente: ofereça este link quando o usuário receber algum benefício ou prazer. Se você fizer isso no momento errado, quando a ação não entender algo ou diminuir a velocidade, você poderá obter um feedback negativo.

Em geral, tente nossas ações alimílógicas

“Yoga para os olhos” , os jogos

“Primeiro ou Segundo” e

“Sim, meu senhor” (e logo as transações aparecerão nele, e será mais fácil para

meu senhor manter seu poder e riqueza!). Recentemente, lançamos a primeira busca por voz do Google Assistant

"Lovecraft World" - um drama interativo no estilo místico "Call of Cthulhu", onde as cenas são dubladas por atores profissionais, o enredo pode ser controlado por voz e fazer pagamentos no jogo. Essa ação já foi desenvolvida na Just AI Conversational Platform, uma solução corporativa profissional.

Três segredos do Google Assistant

- O uso da música. Dos assistentes de voz em russo, apenas o Google Assistant permite que você use músicas diretamente no script de ação. O arranjo musical soa muito bem nos jogos de ação, e do yoga à música há sensações completamente diferentes.

- Opções de pagamento dentro da ação. Para compras no aplicativo, o Assistente do Google usa a plataforma Google Play. As condições para trabalhar com a plataforma para criadores de ação de jogo são as mesmas dos desenvolvedores de aplicativos para dispositivos móveis - 70% da transação é deduzida ao desenvolvedor.

- Moderação . Para moderação bem-sucedida, a ação deve ter uma Política de Processamento de Dados Pessoais. Você precisa colocá-lo em sites.google.com , indicar o nome de sua ação e email - o mesmo que o do desenvolvedor no console do desenvolvedor e escrever que o aplicativo não usa dados do usuário. A moderação de uma ação sem transações dura de 2 a 3 dias, mas a moderação de um aplicativo com pagamentos internos pode levar de 4 a 6 semanas. Mais sobre o procedimento de revisão

Mais hackers, mais casos e épicos instrutivos aguardam os desenvolvedores na conferência sobre conversações de IA, que será realizada de 27 a 28 de junho em São Petersburgo. Andrey Lipatsev, gerente de desenvolvimento de parceiros estratégicos do Google, falará sobre a experiência internacional e os detalhes em russo do Google Assistant. E no Dia do desenvolvedor, Tanya Lando, uma das principais linguistas do Google, conversará com os participantes sobre caixas de diálogo, sinais e metodologias e como escolhê-los para suas tarefas; e os próprios desenvolvedores compartilharão sua experiência pessoal na criação de aplicativos de voz para assistentes - de uma secretária virtual do Google Home a jogos de voz e ações B2B que podem funcionar com a infraestrutura fechada da empresa.

A propósito, em 28 de junho, como parte da conferência, o Google e a Just AI realizarão

um hackathon aberto para desenvolvedores profissionais e iniciantes - você pode trabalhar em ações para o Assistente, experimentar ferramentas UX conversacionais, síntese de fala e NLU e concorrer a prêmios em dinheiro!

Registo - o número de lugares é limitado!