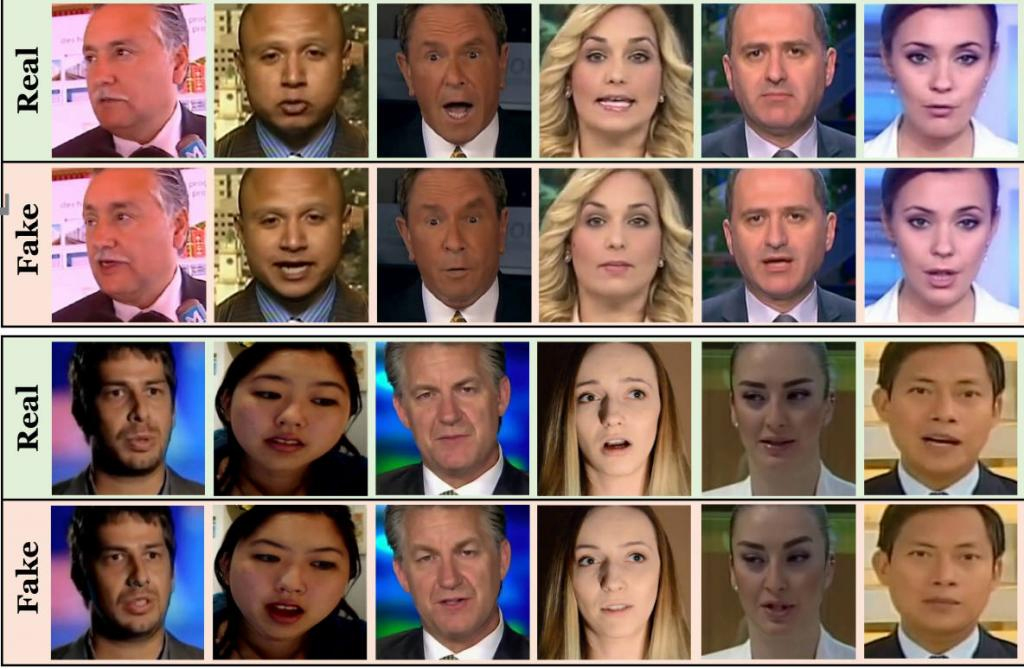

Desde o momento em que apareceram em dezembro de 2017, o dipfeyki, vídeos com uma substituição quase perfeita da face criada por uma rede neural, causaram pânico entre os especialistas. Muitos, por exemplo, tinham medo de que a "vingança pornô" se tornasse ainda mais fácil quando um ex-namorado com um PC suficientemente poderoso poderia fazer pornô sujo com uma namorada. Mas Natalie Portman e Scarlett Johansson, que filmaram especialmente pornografia profunda, amaldiçoaram publicamente a Internet.

Para combater a ameaça iminente, o Facebook e a Microsoft recentemente formaram uma coalizão para lidar com ataques diplomáticos, anunciando um prêmio de US $ 10 milhões para os desenvolvedores que apresentam os melhores algoritmos para detectá-los. Além disso, a DARPA, a gerência de pesquisa do Departamento de Defesa dos EUA, que alocou US $ 68 milhões nos últimos dois anos para esse fim.

Bem, é tarde demais. O primeiro crime de deepfake já ocorreu.

De acordo com o Wall Street Journal, em março deste ano, o diretor-gerente de uma empresa britânica de energia foi roubado em € 220.000 (cerca de US $ 240.000). Ele enviou o dinheiro para uma empresa fornecedora da Hungria porque seu chefe, chefe da empresa-mãe na Alemanha, confirmou essa instrução várias vezes. Mas, de fato, algum invasor astuto simplesmente usou software com tecnologias de IA para substituir o rosto e a voz do líder em tempo real e exige que ele o pague dentro de uma hora.

O programa que o ladrão usou foi capaz de imitar completamente a voz de uma pessoa: tom, pontuação e até um sotaque alemão. A mensagem veio do endereço do chefe na Alemanha, um e-mail com contatos foi enviado ao diretor britânico em confirmação. Assumindo que algo estava dando errado, só poderia ser que, a pedido do chefe, conduzisse o negócio o mais rápido possível, mas esse não é o primeiro problema que ocorreu nos negócios deles.

Como resultado, todo o dinheiro se foi. Da conta húngara, eles foram transferidos para o México e depois espalhados pelo mundo. Mas os ladrões não pararam por aí. Eles pediram uma segunda tradução urgente para que “os suprimentos da Hungria” “fossem ainda mais rápidos”. Então o diretor britânico sentiu que algo estava errado e chamou seu verdadeiro chefe. Aconteceu algum tipo de sur: ele se revezou ao receber ligações de um líder falso ou agora de um verdadeiro líder, falando nas mesmas vozes. O nome da empresa e de seus funcionários não foi divulgado, uma vez que uma investigação está em andamento no caso e ladrões ainda não foram encontrados.

Talvez este não seja o primeiro roubo usando o Deepfake AI (ou seus seguidores avançados). A Symantec relata que detectou pelo menos três casos em que uma substituição de voz ajudou os ladrões a enganar as empresas e forçou-as a enviar dinheiro. Em um desses casos, o dano foi de milhões de dólares. Além disso, a julgar por evidências indiretas, esse truque foi feito por outros atacantes - e não por quem roubou o CEO britânico. Ou seja, os crimes de deepfake estão gradualmente se tornando propriedade comum, essa não é a idéia de nenhum hacker engenhoso.

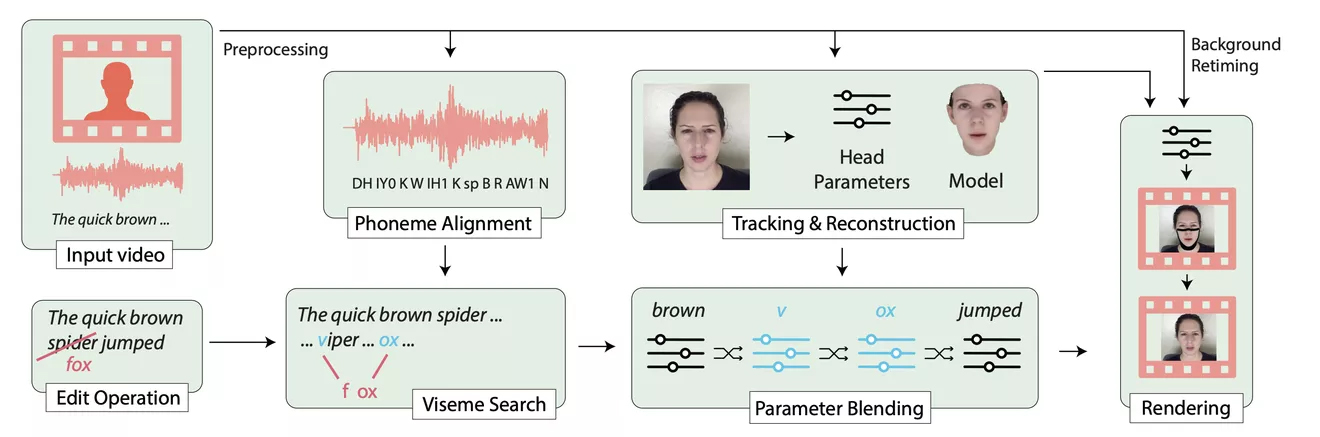

De fato, em breve qualquer aluno poderá executar esse procedimento. O principal é encontrar uma vítima confiante o suficiente e coletar a quantidade certa de amostras de vídeo / áudio para representar quem você precisa. O Google Duplex já está imitando com sucesso a voz de uma pessoa real para fazer chamadas em seu nome. Muitas pequenas empresas iniciantes, principalmente da China, estão trabalhando para oferecer serviços do tipo deepfake gratuitamente. Diferentes programas diphey até competem entre si, o que pode gerar um vídeo bastante convincente com uma pessoa usando a quantidade mínima de dados. Alguns afirmam que em breve uma de suas fotos será suficiente para elas.

Em julho, a Agência Nacional de Proteção Contra Ameaças Cibernéticas de Israel emitiu um alerta sobre um tipo de ataque cibernético fundamentalmente novo, que poderia ser direcionado à liderança de empresas, altos funcionários e até altos funcionários. Essa é a primeira e, no momento, a ameaça mais real da IA. Eles dizem que agora existem programas que podem transmitir perfeitamente sua voz e sotaque depois de ouvi-lo por 20 minutos. Se em algum lugar da rede houver uma gravação com seu discurso por meia hora, ou se alguém estiver sentado um pouco ao seu lado em um café com um gravador de voz, sua voz poderá ser usada para dizer qualquer coisa a alguém.

Até o momento, não existem ferramentas para combater isso. Apenas uma opção para defender. Se alguém ligar para você e pedir para transferir uma quantia substancial de dinheiro, não será supérfluo confirmar que ele é a mesma pessoa por outro canal. Via mensageiros, Skype, email, canais corporativos ou redes sociais. E, idealmente, é claro, cara a cara.

Bem, se você tem profundo conhecimento em aprendizado de máquina e não é avesso a ganhar uma fatia de US $ 10 milhões - você pode tentar o concurso da Microsoft e do Facebook. Ou comece sua própria startup, oferecendo às empresas estatais e respeitáveis uma solução de negócios para determinar difamações por imagem ou voz. Não seremos capazes de ficar sem isso em breve.

PS Pochtoy.com pode entregar qualquer mercadoria dos EUA. Agora - não apenas para a Rússia, mas também para a Ucrânia , graças à cooperação com o New Mail. O custo do envio de 0,5 kg a partir de US $ 11,99 (para a Ucrânia - de US $ 8,00). Para novos registros com código promocional HABR - desconto de 7% na primeira entrega, além de resgate gratuito nas lojas americanas por nossas operadoras.