A missão da Microsoft é dar a todas as pessoas e organizações do planeta a oportunidade de alcançar mais. A indústria da mídia é um ótimo exemplo de traduzir essa missão em realidade. Vivemos uma época em que mais e mais conteúdo está sendo criado e consumido, tudo de uma maneira excelente e em mais dispositivos. No IBC 2019, compartilhamos as mais recentes inovações em que estamos trabalhando e falamos sobre como elas podem ajudar a transformar seu processo de mídia.

Detalhes sob o corte!

Esta página está em

nosso site.Video Indexer introduz suporte para animações e conteúdo multilíngue

No ano passado, na IBC, disponibilizamos nosso premiado

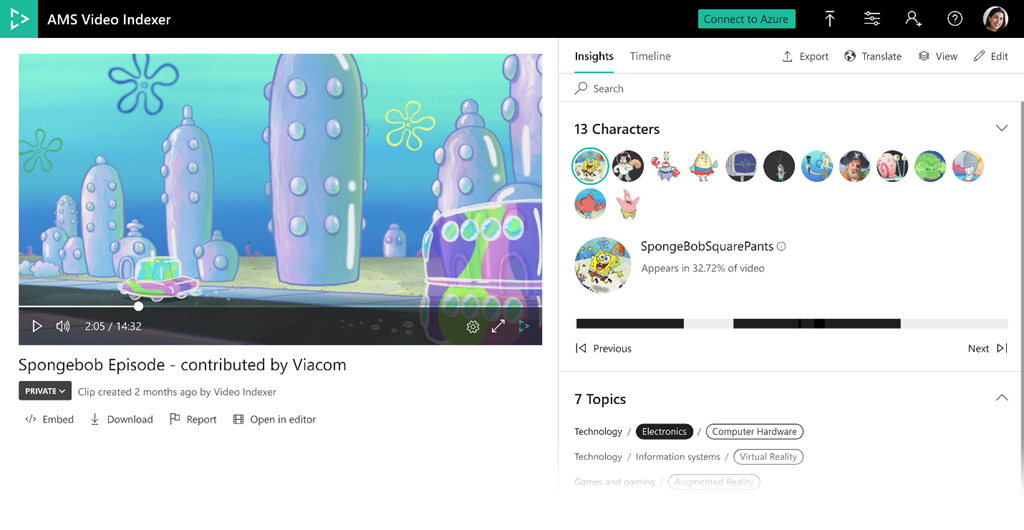

Indexador de Vídeo dos Serviços de Mídia do Azure ao público, e este ano ficou ainda melhor. O Video Indexer extrai automaticamente informações e metadados de arquivos de mídia, como palavras faladas, rostos, emoções, temas e marcas, e você não precisa ser um especialista em aprendizado de máquina para usá-lo.

Nossas ofertas mais recentes incluem versões preliminares de duas funções muito populares e diferenciadas - reconhecimento de personagens animados e transcrição de fala multilíngue, além de várias adições aos modelos existentes atualmente disponíveis no Video Indexer.

Reconhecimento de personagens animados

Conteúdo animado, desenhos animados são um dos tipos mais populares de conteúdo, mas os modelos padrão de visão de máquina criados para reconhecer rostos humanos não funcionam muito bem com ele, especialmente se houver personagens no conteúdo sem recursos humanos. Na nova versão de visualização, o Video Indexer é integrado ao serviço Azure Custom Vision da Microsoft, criando um novo conjunto de modelos que detectam e agrupam automaticamente caracteres animados e facilitam a identificação e o reconhecimento deles usando modelos de visão de máquina personalizados integrados.

Os modelos são integrados em um único transportador, o que permite a qualquer pessoa usar esse serviço sem nenhum conhecimento no campo de aprendizado de máquina. Os resultados estão disponíveis no portal do Video Indexer, que não requer código, ou na API REST para integração rápida em seus próprios aplicativos.

Criamos esses modelos para trabalhar com personagens animados junto com alguns consumidores que forneciam conteúdo animado real para treinamento e teste. O valor da nova funcionalidade foi bem descrito por Andy Gutteridge, diretor sênior de tecnologia de estúdio e pós-produção da Viacom International Media Networks, que era um dos provedores de dados: “A adição de um robusto recurso de detecção de conteúdo animado baseado em AI nos permitirá encontrar de forma rápida e eficiente e catalogar metadados de caracteres de nossa biblioteca. conteúdo.

Mais importante, ele dará às nossas equipes criativas a oportunidade de encontrar instantaneamente o conteúdo certo, minimizar o tempo gasto no gerenciamento da mídia e nos permitir focar na criatividade. ”

Você pode começar a explorar o reconhecimento de caracteres animados na

página de documentação .

Identificação e transcrição de conteúdo em várias línguas

Alguns recursos de mídia, como notícias, crônicas de eventos e entrevistas, contêm gravações de pessoas que falam idiomas diferentes. A maioria das opções existentes para traduzir a fala em texto exige uma indicação preliminar do idioma de reconhecimento de som, o que dificulta a transcrição de vídeos multilíngues.

Nosso novo recurso para identificar automaticamente um idioma falado para vários tipos de conteúdo usa a tecnologia de aprendizado de máquina para identificar idiomas encontrados nos recursos de mídia. Após a detecção, cada segmento de idioma passa automaticamente pelo processo de transcrição no idioma correspondente e, em seguida, todos os segmentos são combinados em um único arquivo de transcrição que consiste em vários idiomas.

A descriptografia resultante está disponível como parte da saída do JSON Video Indexer e na forma de arquivos com legendas. A descriptografia de saída também é integrada à Pesquisa do Azure, que permite pesquisar imediatamente segmentos de idiomas diferentes nos vídeos. Além disso, a transcrição multilíngue está disponível ao trabalhar com o portal do Video Indexer, para que você possa visualizar a transcrição e o idioma identificado por tempo ou ir a lugares específicos do vídeo para cada idioma e ver a transcrição multilíngue na forma de assinaturas durante a reprodução do vídeo. Você também pode traduzir o texto resultante em qualquer um dos 54 idiomas disponíveis por meio do portal e da API.

Leia mais sobre o novo recurso de reconhecimento de conteúdo em vários idiomas e seu uso no Video Indexer

na documentação .

Modelos adicionais atualizados e aprimorados

Também estamos adicionando novos modelos ao Video Indexer e aprimorando os existentes, incluindo os descritos abaixo.

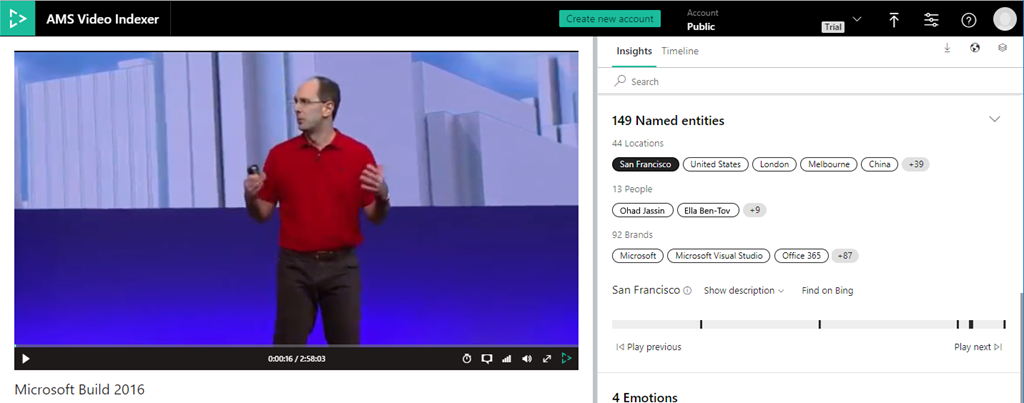

Recuperando entidades associadas a pessoas e lugares

Expandimos nossos recursos de descoberta de marca existentes para incluir nomes e locais conhecidos, como a Torre Eiffel em Paris e o Big Ben em Londres. Quando eles aparecem na descriptografia gerada ou na tela usando o reconhecimento óptico de caracteres (OCR), as informações correspondentes são adicionadas. Com esse novo recurso, você pode pesquisar todas as pessoas, lugares e marcas que aparecem no vídeo e visualizar informações sobre eles, incluindo intervalos de tempo, descrições e links para o mecanismo de pesquisa do Bing para obter mais informações.

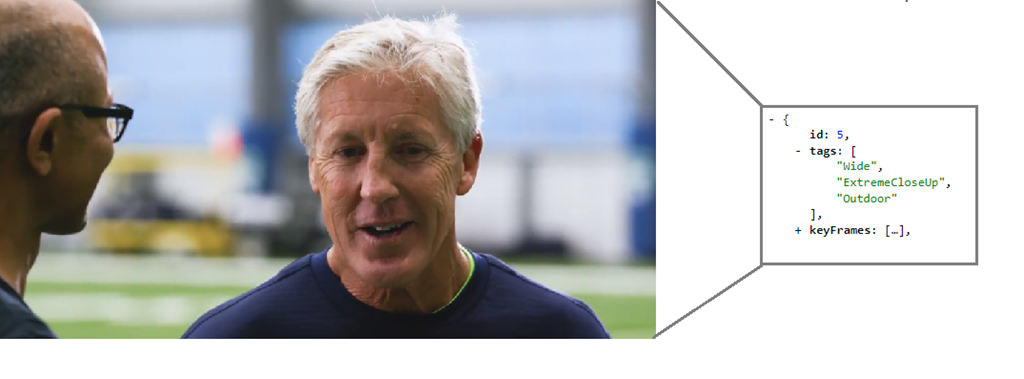

Modelo de Detecção de Editor

Esse novo recurso adiciona um conjunto de "tags" aos metadados anexados aos quadros individuais nos detalhes do JSON para representar seu tipo editorial (por exemplo, quadro amplo, quadro médio, close-up, muito close-up, duas fotos, várias pessoas ao ar livre, dentro de casa etc.). Essas características do tipo de quadro são úteis na edição de vídeo para clipes e trailers, bem como na pesquisa de um estilo de quadro específico para fins artísticos.

Saiba mais sobre a

Saiba mais sobre a detecção de tipo de quadro no Video Indexer.

Detalhamento Avançado de Mapeamento IPTC

Nosso modelo de detecção de tema identifica um assunto de vídeo com base na transcrição, reconhecimento óptico de caracteres (OCR) e celebridades descobertas, mesmo que o tema não seja explicitamente declarado. Combinamos esses tópicos descobertos com quatro áreas de classificação: Wikipedia, Bing, IPTC e IAB. Esse aprimoramento nos permite incluir uma classificação IPTC de segundo nível.

Tirar proveito desses aprimoramentos é tão fácil quanto reindexar sua biblioteca atual do Video Indexer.

Nova funcionalidade de transmissão ao vivo

Na versão de visualização dos Serviços de Mídia do Azure, também oferecemos dois novos recursos para transmissão ao vivo.

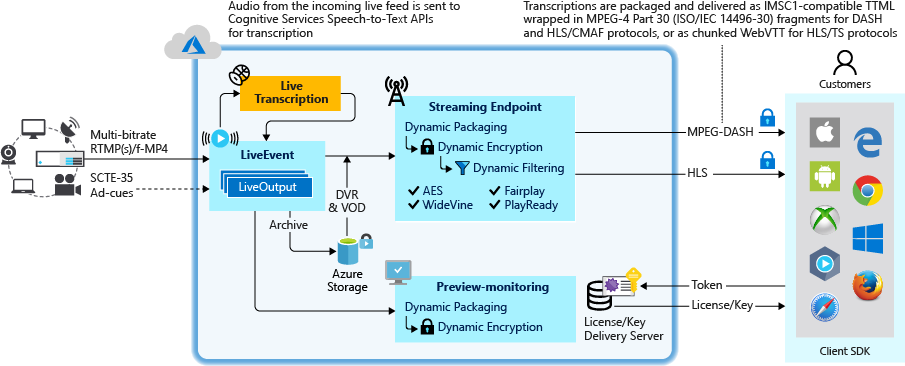

A transcrição em tempo real da IA leva as transmissões ao vivo para o próximo nível

Usando os Serviços de Mídia do Azure para transmissão ao vivo, agora você pode obter um fluxo de saída que inclui uma faixa de texto gerada automaticamente, além do conteúdo de áudio e vídeo. O texto é criado transcrevendo áudio em tempo real com base em inteligência artificial. Métodos personalizados são aplicados antes e depois da conversão de fala em texto para melhorar os resultados. A faixa de texto é empacotada em IMSC1, TTML ou WebVTT, dependendo de ser fornecida em DASH, HLS CMAF ou HLS TS.

Codificação linear em tempo real para canais OTT 24/7

Usando nossa API v3, você pode criar canais usando a tecnologia OTT (over-the-top), gerenciar e realizar transmissões ao vivo com eles e usar todos os outros recursos dos Serviços de Mídia do Azure, como vídeo ao vivo sob demanda (VOD, vídeo sob demanda), gerenciamento de embalagens e direitos digitais (DRM).

Para uma visualização desses recursos, visite

a página da

comunidade dos Serviços de Mídia do Azure .

Novos recursos de geração de pacotes

Suporte à descrição da trilha sonora

O conteúdo transmitido nos canais de transmissão geralmente possui uma faixa de áudio com explicações verbais do que está acontecendo na tela, além do sinal de áudio normal. Isso torna os programas mais acessíveis aos espectadores com deficiência visual, especialmente se o conteúdo é principalmente visual. A nova

função de descrição de áudio permite que você anote uma das faixas de áudio como uma faixa de descrição de áudio (AD, descrição de áudio), para que os jogadores possam tornar a faixa do AD acessível aos espectadores.

Inserir metadados ID3

As empresas de transmissão geralmente usam metadados com base no tempo incorporados no vídeo para transmitir um sinal sobre a inserção de anúncios ou eventos de metadados personalizados no player do player. Além dos modos de sinalização SCTE-35, agora também suportamos

ID3v2 e outros esquemas de usuário definidos pelo desenvolvedor do aplicativo para uso pelo aplicativo cliente.

Parceiros do Microsoft Azure apresentam soluções completas

Bitmovin Introduz a Codificação de Vídeo Bitmovin e o Bitmovin Video Player para Microsoft Azure. Agora, os clientes podem usar essas soluções de codificação e reprodução no Azure e aproveitar os recursos avançados, como codificação em três estágios, suporte para codecs AV1 / VC, legendas multilíngues e análise de vídeo pré-integrada para QoS, publicidade e rastreamento de vídeo.

O Evergent apresenta sua Plataforma de Gerenciamento do Ciclo de Vida do Usuário no Azure. Como fornecedora líder de soluções de gerenciamento de receita e ciclo de vida do cliente, a Evergent utiliza o Azure AI para ajudar provedores de entretenimento premium a melhorar o envolvimento e a retenção de clientes, criando pacotes e ofertas de serviços direcionados em momentos críticos do seu ciclo de vida.

A Haivision apresentará seu serviço inteligente de roteamento multimídia baseado em nuvem, o SRT Hub, que ajuda os clientes a transformar fluxos de trabalho do início ao fim usando o

Azure Data Box Edge e transformar fluxos de trabalho usando Hublets da Avid, Telestream, Wowza, Cinegy e Make.tv.

A SES desenvolveu o Broadcast Class Services Suite do Azure para seus clientes de serviços de mídia gerenciados e baseados em satélite. O SES apresentará soluções para serviços de reprodução totalmente gerenciados, incluindo reprodução principal, reprodução localizada, detecção e substituição de anúncios e codificação multicanal 24 × 7 de alta qualidade em tempo real no Azure.

O SyncWords disponibiliza nas convenientes ferramentas e tecnologia em nuvem do Azure para criar assinaturas. Essas ofertas tornarão mais fácil para as organizações de mídia adicionar legendas automaticamente, inclusive em um idioma estrangeiro, aos fluxos de trabalho do processamento de vídeo em tempo real e offline no Azure.

A Tata Elxsi , uma empresa internacional de serviços de tecnologia, integrou sua plataforma OTT SaaS TEPlay aos Serviços de Mídia do Azure para fornecer conteúdo OTT a partir da nuvem. A Tata Elxsi também migrou a solução de QoE do Falcon Eye, fornecendo métricas de análise e decisão, para o Microsoft Azure.

A Verizon Media disponibiliza sua plataforma de streaming no Azure como beta. A Verizon Media Platform é uma solução OTT de nível empresarial que inclui DRM, inserção de anúncios, sessões personalizadas personalizadas, substituição dinâmica de conteúdo e entrega de vídeo. A integração simplifica os fluxos de trabalho, o suporte global e a escalabilidade e fornece acesso a vários recursos exclusivos no Azure.