O mundo ao nosso redor está mudando constante e continuamente, quer queiramos ou não. E um grande papel nisso é desempenhado pelas tecnologias, cujo desenvolvimento e disseminação está se tornando cada vez mais ativo a cada ano. Já não consideramos o carro uma raridade, mas as comunicações móveis como mágicas. A tecnologia se tornou parte de nossas vidas diárias, trabalho e nós mesmos. Um dos tópicos mais populares entre futurólogos e escritores de ficção científica sempre foram os robôs - máquinas autônomas que podem facilitar a vida de uma pessoa ou organizar o genocídio total de toda a vida no planeta, de acordo com filmes sobre o Exterminador do Futuro. De qualquer forma, permanecem várias perguntas muito engraçadas - como uma pessoa se comportará com uma máquina, ela confiará nela e qual será a eficácia da cooperação? Cientistas do laboratório de pesquisa do Exército dos EUA decidiram realizar uma série de experimentos para estabelecer quais aspectos do comportamento e da "aparência" de uma máquina autônoma melhoram a colaboração com seres humanos. O que exatamente descobrimos aprendemos com o relatório deles. Vamos lá

Base de estudo

Para entender melhor o relacionamento entre homem e máquina, você deve primeiro olhar para o relacionamento entre homem e homem. Dado que a população do planeta é dividida em muitos grupos (religião, nacionalidade, etnia etc.), uma pessoa sempre dividirá as pessoas em "nós" e "eles". Esse processo de separação, segundo os pesquisadores, prossegue no nível subconsciente e leva a um aumento na probabilidade de escolher uma pessoa pertencente ao mesmo grupo para cooperação. Os cientistas também observam que essas preferências não têm nada a ver com manifestações de discriminação contra pessoas de outras nacionalidades, religiões e outras coisas.

No caso de máquinas autônomas, ainda não está claro se essa categorização social ocorre no momento da cooperação entre homem e máquina. Se é, como se manifesta, como é regulado e como pode ser mudado?

Para testar isso, os cientistas realizaram uma série de experimentos, cujos participantes eram pessoas de duas culturas distantes (EUA e Japão) e carros com rostos virtuais correspondentes às mesmas culturas e expressando certas emoções.

Havia 468 participantes dos EUA e 477 do Japão.

As características demográficas de um grupo dos EUA foram as seguintes:

- sexo: 63,2% - homens e 36,8% - mulheres;

- idade: 0,9% - 18-21; 58,5% - 22-34; 21,6% - 35-44; 10,7% - 45-54; 6,2% - 55-64; 2,1% - acima de 64 anos;

- etnia: 77,3% - indo-europeu; 10,3% - afro-americanos; 1,3% - Índico Oriental; 9,2% - hispânicos; 6,0% - asiático (sudeste).

As características demográficas para o grupo do Japão foram as seguintes:

- sexo: 67,4 - homens e 32,6% - mulheres;

- idade: 0,6% - 18-21; 15,7% - 22-34; 36,4% - 35-44; 34,7% - 45-54; 10,4% - 55-64; 2,1% - acima de 64 anos;

- etnia: 0,6% - índio oriental; 99,4% - asiático (sudeste).

As pessoas podem se relacionar de maneiras diferentes, dependendo da categorização pessoal, mas vale lembrar que uma máquina autônoma não é uma pessoa. Portanto, esse dispositivo já pertence a outro grupo social, por assim dizer, por padrão. Obviamente, uma pessoa pode perceber uma máquina como ator social (participante de algum tipo de interação), mas a perceberá de maneira diferente do que perceberia outra pessoa viva de carne e osso.

Um exemplo impressionante disso é o estudo anterior do cérebro humano durante um jogo de "pedra-papel-tesoura". Quando uma pessoa brincava com outra pessoa, o córtex pré-frontal medial era ativado, o que desempenha um papel importante na

mentalização * .

Mentalização * - a capacidade de representar o estado mental de si mesmo e de outras pessoas.

Mas ao brincar com a máquina, essa parte do cérebro não foi ativada.

Resultados semelhantes foram mostrados por experimentos com o jogo do ultimato.

O jogo do ultimato * é um jogo econômico no qual o jogador número 1 recebe uma certa quantia de dinheiro e deve compartilhá-lo com o jogador número 2, a quem ele vê pela primeira vez. A oferta pode ser qualquer, mas se o jogador número 2 recusar, os dois jogadores não receberão dinheiro.

Quando o jogador nº 2 recebeu uma oferta injusta do jogador nº 1 (humano), ele ativou seções do lobo central do cérebro responsáveis pela formação de emoções negativas. Se o jogador 1 era um carro, nenhuma reação foi observada.

Tais experimentos mais uma vez confirmam o fato de que uma pessoa percebe uma máquina de maneira diferente da outra. Alguns pesquisadores acreditam que a máquina não representa competição para nós do ponto de vista de nossos instintos e, portanto, há uma atividade reduzida (ou mesmo nenhuma) similar de determinadas regiões do cérebro.

Tudo é bastante lógico: o homem é um lobo para o homem, mas mesmo entre os lobos há um certo grau de confiança e desejo de cooperar em determinadas condições. Mas o carro age como uma raposa, com a qual os lobos não querem cooperar com a palavra. No entanto, essas preferências não anulam o fato de que há cada vez mais robôs em nosso mundo e, portanto, precisamos encontrar métodos para melhorar o relacionamento entre nós e eles.

Por que os pesquisadores decidiram usar esse tipo de categorização social como identidade cultural? Em primeiro lugar, já foi estabelecido anteriormente que uma pessoa reage positivamente a máquinas que possuem certas características de fala (ênfase, por exemplo), normas sociais e raça.

Em segundo lugar, nos casos em que representantes de diferentes grupos sociais participam dos experimentos, um entrelaçamento distinto de cooperação e competição é traçado nos primeiros estágios. Nas etapas subseqüentes, quando os participantes se conhecem melhor, é traçada uma linha clara de comportamento correspondente à tarefa da experiência. Simplificando, os participantes de diferentes grupos sociais não confiavam um no outro, mesmo quando a tarefa da experiência estava relacionada à cooperação. Mas depois de algum tempo, a confiança e o desejo de concluir a tarefa superaram a desconfiança subconsciente.

Em terceiro lugar, experimentos anteriores mostraram que as expectativas iniciais de cooperação baseadas na categorização social podem ser rejeitadas se recorrermos a sinais (emoções) mais significativos da situação.

Ou seja, os pesquisadores dotaram a máquina com características visuais dos grupos sociais aos quais os participantes do experimento (pessoas) pertenciam, e várias expressões emocionais, e depois conferiram diferentes combinações para identificar a conexão.

De tudo isso, duas hipóteses principais foram identificadas. A primeira é que a associação de sinais positivos de identidade cultural pode atenuar os preconceitos desfavoráveis que as pessoas têm por padrão sobre as máquinas. Segundo, a expressão de emoções pode exceder as expectativas de cooperação / competição com base na identidade cultural. Em outras palavras, se você der características visuais ao carro de um determinado grupo cultural, as pessoas do mesmo grupo poderão inconscientemente confiar mais nele. No entanto, no caso da manifestação de certas emoções, indicando a falta de vontade da máquina em entrar em cooperação, todos os preconceitos culturais deixam de ser instantaneamente importantes.

Curiosamente, o experimento foi baseado no dilema do prisioneiro - um jogo em que a cooperação não é uma tática vencedora. Seguindo a teoria dos jogos, o prisioneiro (jogador) sempre maximizará seu próprio benefício, sem pensar nos benefícios de outros jogadores. Assim, a racionalidade deve levar os jogadores à traição e falta de vontade de cooperar, mas, na realidade, os resultados de tais experimentos costumam estar longe de serem racionais, o que explica a presença da palavra "dilema" no nome desse jogo matemático. Há um pequeno problema: se um jogador acredita que o segundo não cooperará, ele também não deve cooperar; no entanto, se os dois jogadores seguirem essas táticas, ambos perderão.

Resultados da Experiência

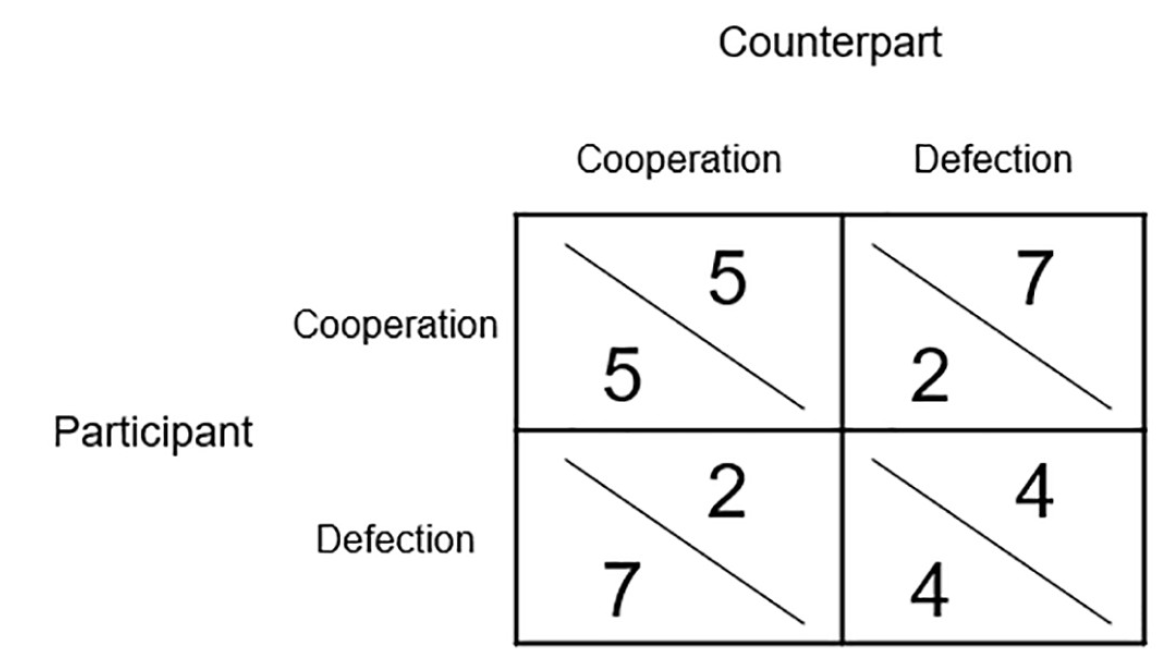

Imagem Nº 1

Imagem Nº 1No total, cada um dos participantes do experimento passou 20 rodadas brincando com a máquina. A imagem acima é uma matriz de ganho. Os pontos obtidos durante o jogo tiveram benefícios financeiros reais, pois foram posteriormente convertidos em bilhetes de loteria com uma quantia vencedora de $ 30.

O principal objetivo do experimento foi identificar como os participantes colaborarão / competirão com pessoas ou máquinas, bem como como a identidade e as emoções culturais influenciarão esses processos.

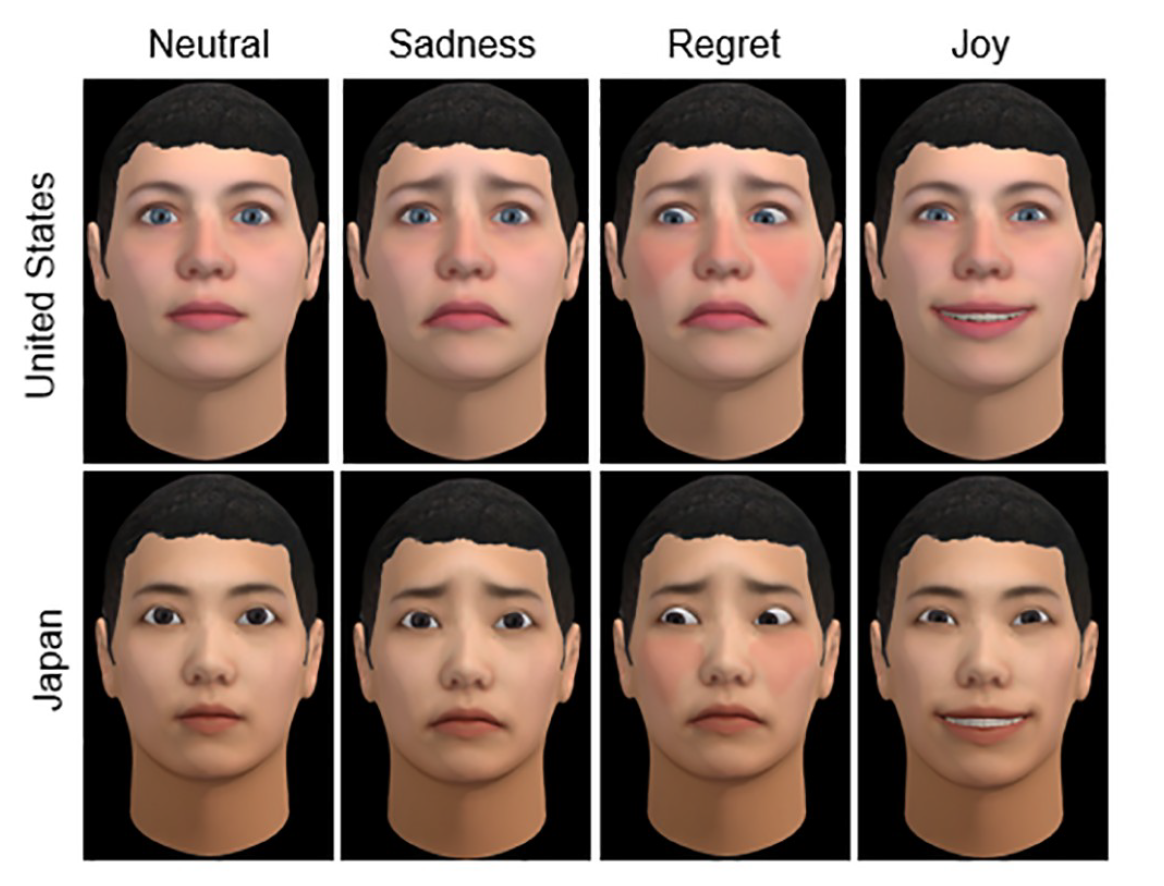

Imagem No. 2

Imagem No. 2Acima, duas identidades culturais (EUA e Japão) de rostos virtuais para máquinas que expressam emoções diferentes (neutro, tristeza, arrependimento e alegria). Vale ressaltar que as faces virtuais foram usadas por todos os participantes das experiências, ou seja, pessoas e carros.

A série emocional não foi escolhida por acaso. Experiências anteriores com o dilema do prisioneiro mostraram que algumas emoções podem incentivar a cooperação, enquanto outras podem competir, dependendo do tempo em que são expressas.

Nesse modelo, as emoções da máquina e as ações que as causam foram divididas em duas categorias principais.

Empurrando uma pessoa para a competição:

- arrependimento após cooperação mútua (a máquina perdeu a oportunidade de operar um membro humano para seu próprio benefício);

- alegria após a operação (o participante coopera, mas não recebe nada em troca do carro);

- tristeza após competição mútua / emoção neutra após cooperação mútua.

Incentivar as pessoas a cooperar:

- a alegria da cooperação mútua;

- arrependimento da exploração;

- tristeza após competição mútua.

Assim, no experimento, havia várias variáveis ao mesmo tempo: identidade cultural (EUA ou Japão), o tipo declarado de parceiro (pessoa ou máquina) e emoções expressas (competitivas ou colaborativas).

Os resultados dos experimentos foram divididos em duas categorias, de acordo com o tipo de pares de participantes: participantes de um grupo cultural e participantes de diferentes grupos culturais.

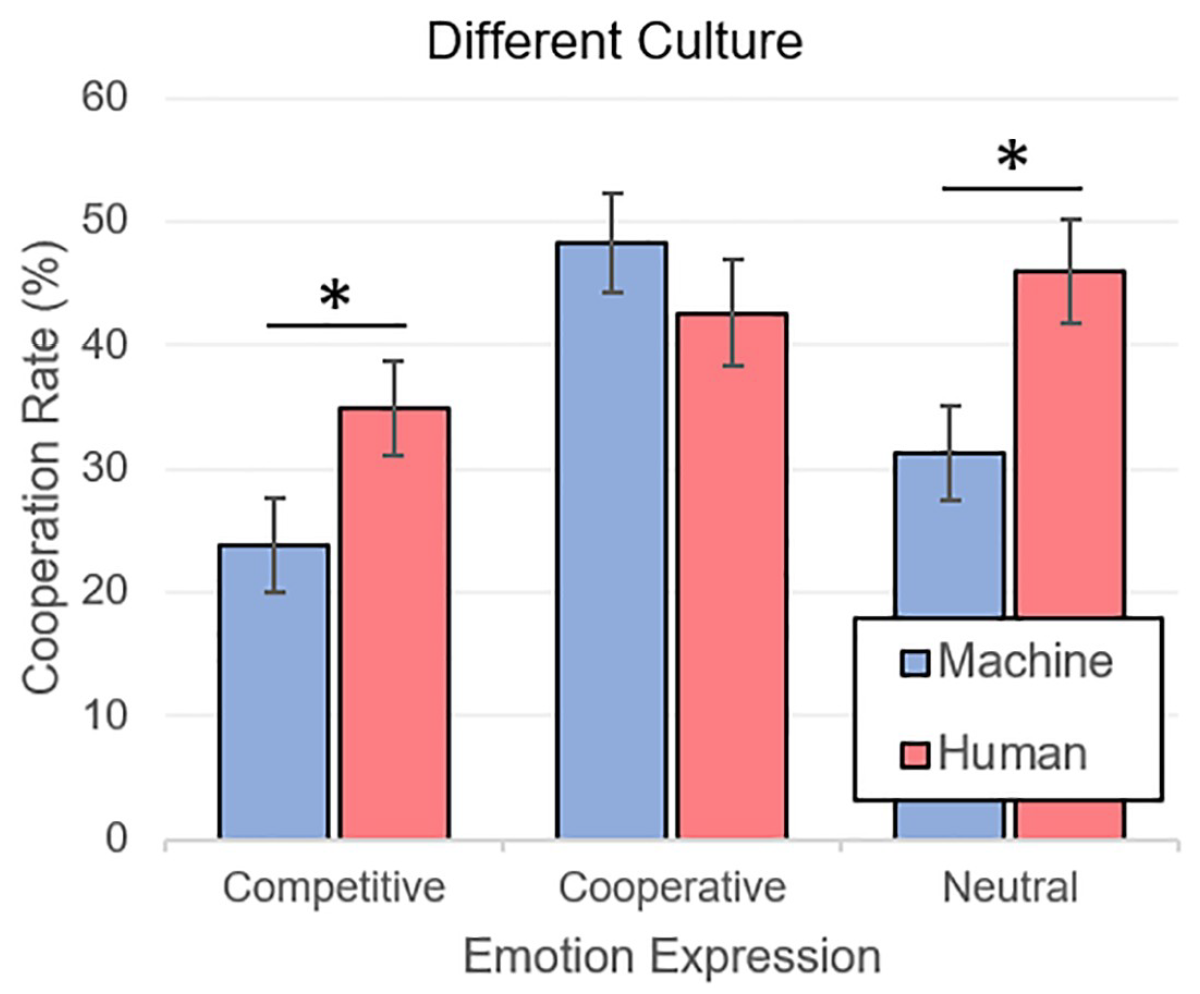

Imagem No. 3

Imagem No. 3Acima está um gráfico dos resultados (análise de variância, ou seja, ANOVA) de experimentos em que diferentes grupos culturais se reuniram no jogo. Como esperado, a cooperação com pessoas (M = 41.15, SE = 2,39) foi expressa mais do que a cooperação com máquinas (M = 34,45, SE = 2,25). Em relação às emoções, tudo não era menos previsível - os jogadores colaboraram mais com aqueles que expressaram emoções de cooperação (M = 45,42, SE = 2,97) do que as emoções da competição (M = 29,34, SE = 2,70). As emoções neutras (M = 38,63, SE = 2,85) também superaram as competitivas.

É curioso que as emoções que inspiram confiança nos jogadores humanos neutralizem completamente o fato de brincarem com a máquina, reduzindo assim o grau de desconfiança.

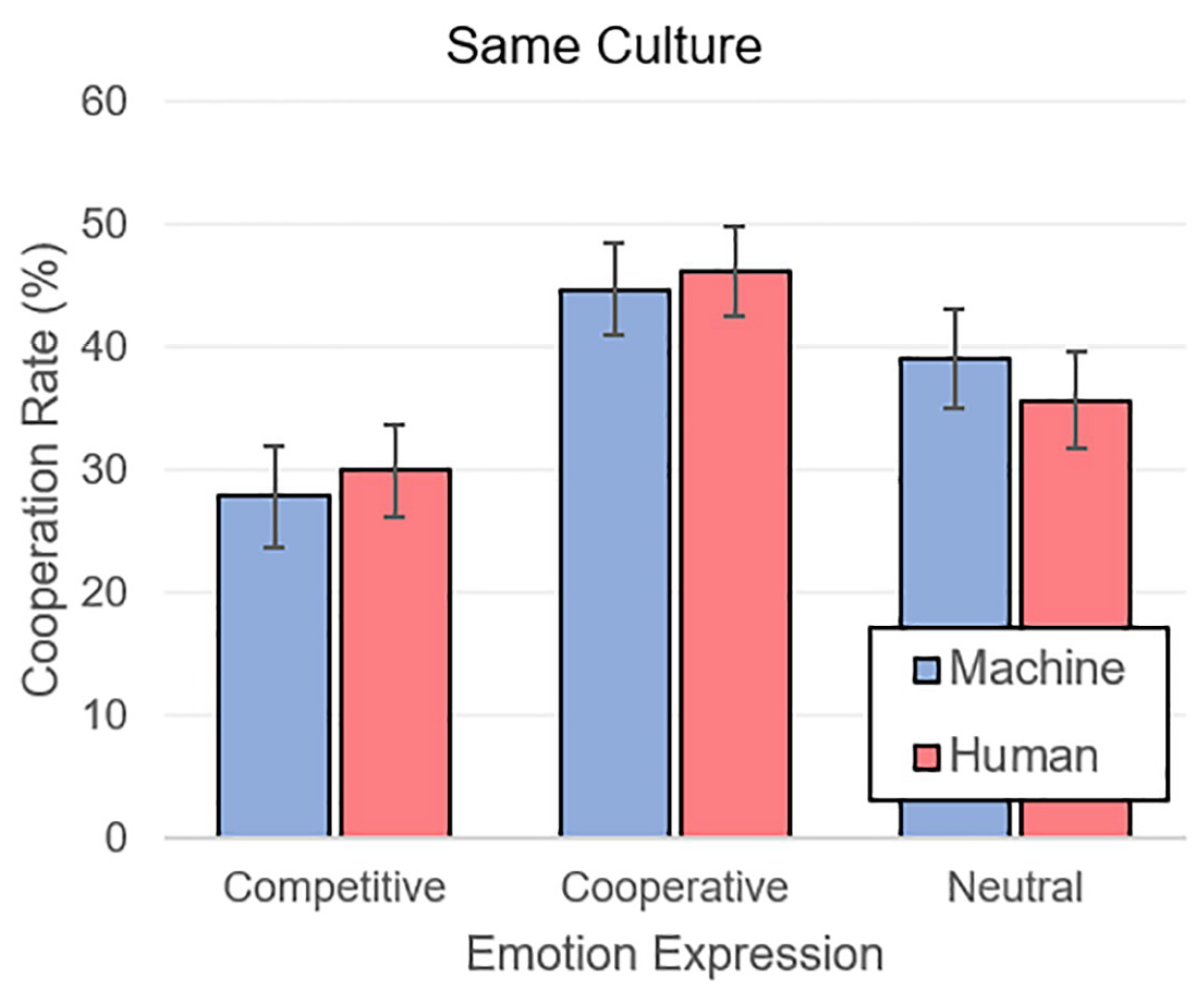

Imagem No. 4

Imagem No. 4Quando os participantes se depararam com parceiros do mesmo grupo cultural, a situação foi semelhante. As emoções cooperativas (M = 45,55, SE = 2,61) superaram as neutras (M = 37,42, SE = 2,81) e competitivas (M = 28,99, SE = 2,78).

A totalidade dos resultados deixa claro que uma pessoa usa os mesmos parâmetros psicológicos de confiança e desconfiança na comunicação com uma máquina que outra pessoa. Os carros autônomos são inicialmente percebidos como membros de um grupo social alheio à pessoa. No entanto, o uso de uma face visual com traços de uma certa identidade cultural apropriada ao parceiro humano pode atenuar a desconfiança da máquina.

A observação mais importante é que a identidade cultural e o pertencimento às máquinas são completamente nivelados pelas emoções corretas, por assim dizer.

Para um conhecimento mais detalhado das nuances do estudo, recomendo que você analise o

relatório dos cientistas .

Epílogo

Este estudo é muito ambíguo, mas mostra uma característica importante da psicologia humana. Inconscientemente, categorizamos as pessoas ao nosso redor em certos grupos sociais, experimentando uma maior confiança naqueles que pertencem ao nosso grupo. Esta é a nossa reação primária. Mas não é o único, pois ao nos comunicarmos com uma pessoa, começamos a receber uma série de sinais (visuais e sonoros) expressos por emoções, maneira de falar, voz, etc. Esses sinais complementam a imagem da representação de uma pessoa para nós, da qual somos repelidos no momento de tomar uma decisão - confiar ou não. Em outras palavras, a categorização social que ocorre em nossas cabeças não importa quando se trata de comunicação animada. É o que dizem os velhos ditados: “são recebidos por roupas, mas escoltados pela mente” e “não julgam um livro pela capa”.

Em relação aos carros, uma pessoa estava sempre sintonizada com apreensão e desconfiança, que muitas vezes não eram sustentadas por razões significativas. Essa é a natureza do homem - inicialmente rejeitar aquilo que é estranho. No entanto, assim como o conhecimento conquista a ignorância, a interação real com máquinas autônomas capazes de expressar emoções conquista os preconceitos humanos.

Isso significa que todos os robôs no futuro devem ter emoções? Sim e não Pesquisadores, cujo trabalho examinamos hoje, acreditam que, nas primeiras emoções dos robôs, será uma excelente função que poderá acelerar o processo de adoção de máquinas autônomas por uma sociedade de pessoas. O que posso dizer, viver com lobos - uivar como um lobo, não importa o quão rude isso pareça.

Além disso, já damos aos robôs características próprias: fazemos olhos como os nossos, rostos como os nossos, damos vozes e emoções. Uma pessoa sempre tentará humanizar o carro e, como mostra este estudo, não é em vão.

Sexta-feira off-top:O documentário "Hiper Evolução: A Ascensão das Máquinas" (Parte I, Parte II , Parte III ). Obrigado pela atenção, fique curioso e tenha um ótimo final de semana a todos, pessoal! :)

Obrigado por ficar conosco. Você gosta dos nossos artigos? Deseja ver materiais mais interessantes? Ajude-nos fazendo um pedido ou recomendando a seus amigos o

VPS na nuvem para desenvolvedores a partir de US $ 4,99 , um

desconto de 30% para os usuários da Habr em um analógico exclusivo de servidores de nível básico que inventamos para você: Toda a verdade sobre o VPS (KVM) E5-2650 v4 (6) Núcleos) 10GB DDR4 240GB SSD 1Gbps de US $ 20 ou como compartilhar um servidor? (as opções estão disponíveis com RAID1 e RAID10, até 24 núcleos e até 40GB DDR4).

Dell R730xd 2 vezes mais barato? Somente temos

2 TVs Intel TetraDeca-Core Xeon 2x E5-2697v3 2.6GHz 14C 64GB DDR4 4x960GB SSD 1Gbps 100 TV a partir de US $ 199 na Holanda! Dell R420 - 2x E5-2430 2.2Ghz 6C 128GB DDR3 2x960GB SSD 1Gbps 100TB - a partir de US $ 99! Leia sobre

Como criar um prédio de infraestrutura. classe usando servidores Dell R730xd E5-2650 v4 custando 9.000 euros por um centavo?