Determinar o nível de IA é uma das questões mais difíceis, mas também uma das mais importantes no campo da ciência da computação. Se você não tem certeza se a máquina criada hoje é mais inteligente que a máquina criada ontem, como pode determinar que está progredindo?

À primeira vista, pode parecer que isso não é um problema. "É claro que a IA está ficando mais inteligente", é uma das visões do problema. “Basta olhar para todo esse dinheiro e pessoas talentosas que entraram no setor. Veja as realizações, como derrotar pessoas no GO, e todos os tipos de tarefas que não puderam ser resolvidas há 10 anos, mas hoje elas se tornaram comuns, como o reconhecimento de imagens. Isso realmente não é progresso?

Outra visão é que essas conquistas não são um bom indicador de inteligência. Sim, a derrota das pessoas no xadrez e no Go é impressionante, mas o que importa, mesmo que o computador mais inteligente perca ao resolver problemas gerais de uma criança ou um rato?

Essa crítica vem do pesquisador de inteligência artificial François Cholet, engenheiro de software do Google e uma figura bem conhecida na comunidade de aprendizado de máquina. Cholet é o criador do Keras, uma biblioteca muito popular para criar redes neurais. Ele também escreveu vários tutoriais de aprendizado de máquina e mantém uma

conta popular no

Twitter comentando sobre vários eventos do setor.

Em um artigo recente, “

Sobre a medição da inteligência ”

, Cholet também argumenta que o mundo da IA deve decidir o que é inteligência e o que não é. De acordo com Cholet, se os pesquisadores querem progredir na criação de inteligência artificial universal, devem parar de olhar para benchmarks populares, como videogames ou jogos de tabuleiro, e você deve começar a pensar em habilidades que realmente tornam as pessoas mais inteligentes, como nossa capacidade de generalizar e adaptar.

Em uma entrevista sobre o quase falecido The Verge, Cholet explicou seus pensamentos sobre esse assunto, explicando por que ele acredita que as realizações atuais no campo da IA foram "distorcidas", como podemos medir a inteligência no futuro e por que histórias assustadoras sobre a IA superinteligente ( Elon Musk e outros) ocupam uma quantidade excessivamente grande de atenção na imaginação do público.

A entrevista foi ligeiramente editada para maior clareza.

Em seu artigo, você descreve dois conceitos diferentes de inteligência que influenciaram o campo da IA. O primeiro descreve a inteligência como a capacidade de ter sucesso em uma ampla gama de tarefas, enquanto o segundo prioriza a adaptabilidade e a generalização, ou seja, a capacidade da IA de responder a novos desafios. Qual conceito é mais influente agora e quais são as consequências disso?Nos primeiros 30 anos da história do setor, o primeiro conceito foi o mais popular: a inteligência como um conjunto de programas estáticos e bases de conhecimento explícitas. No momento, o pêndulo oscilou muito fortemente na direção oposta: o intelecto é representado como uma “lousa limpa” ou, se uma metáfora mais apropriada for usada, uma “rede neural profunda recém-inicializada”. Infelizmente, esse conceito quase não é questionado e não foi amplamente investigado. Essas questões são discutidas há muito tempo na comunidade científica - literalmente há décadas -, mas agora não vejo consciência entre as pessoas envolvidas no aprendizado profundo, talvez porque a maioria delas tenha entrado nesse campo depois de 2016.

Monopólios intelectuais de apenas um ponto de vista nunca são bons, especialmente como resposta a perguntas científicas pouco compreendidas. Isso limita o conjunto de perguntas feitas. Limita o número de idéias que as pessoas podem perguntar. Eu acho que os pesquisadores agora estão se conscientizando desse fato.

Em seu artigo, você também argumenta que melhorar a IA requer uma definição mais precisa de inteligência. Você afirma que os pesquisadores agora estão focados em benchmarks e testes estatísticos, como ganhar videogames e jogos de tabuleiro. Por que você está perdendo esse QI?O fato é que, ao escolher essa medida, você usará todas as brechas disponíveis (atalhos, caminhos abreviados) para alcançá-la. Por exemplo, se você escolher um jogo de xadrez como uma medida de inteligência (isso foi da década de 1970 a 1990), você acaba com um sistema que joga xadrez e nada mais. Não há razão para acreditar que esse sistema seja bom para qualquer outra coisa. Como resultado, você obtém uma árvore de pesquisa e o minimax, que não diz nada sobre a inteligência humana. Hoje, a busca pelo domínio em videogames como Dota ou StarCraft cai na mesma armadilha intelectual.

Talvez isso não seja óbvio, porque em humanos as habilidades e a inteligência estão intimamente relacionadas. A mente humana pode usar sua inteligência universal para dominar habilidades especiais para a tarefa. As pessoas que são realmente boas no xadrez podem ser consideradas muito inteligentes, porque, indiretamente, sabemos que elas começaram do zero e tiveram que usar sua inteligência universal para aprender a jogar xadrez. Eles não foram feitos para jogar xadrez. Portanto, sabemos que eles poderiam direcionar sua inteligência universal para outras tarefas e aprender como executar essas tarefas de maneira semelhante. Isso é o que é versatilidade.

Mas com carros um pouco diferente. Uma máquina pode ser projetada para jogar xadrez. Assim, a conclusão que fazemos sobre as pessoas - “pode jogar xadrez, portanto, deve ser inteligente” - entra em colapso. E nossas suposições antropomórficas não podem mais ser aplicadas. A inteligência universal pode dominar habilidades específicas da tarefa, mas não há como voltar da habilidade específica da tarefa para a inteligência universal. Absolutamente. Assim, nos carros, habilidades e inteligência são duas coisas completamente diferentes. Você pode obter habilidades arbitrárias em tarefas arbitrárias se conseguir coletar uma quantidade infinita de dados sobre uma tarefa (ou gastar uma quantidade infinita de recursos de engenharia). E ainda não o aproxima nem um centímetro da inteligência universal.

O ponto chave aqui é que não há problema em que, alcançar uma habilidade alta seria um sinal de inteligência. Somente se a tarefa não for realmente uma meta-tarefa, e para resolvê-la seria necessário adquirir novas habilidades em uma ampla gama de problemas anteriormente desconhecidos. É assim que proponho medir a inteligência.

Se os testes atuais não nos ajudam a desenvolver a IA com uma inteligência mais universal e flexível, por que eles são tão populares?

Se os testes atuais não nos ajudam a desenvolver a IA com uma inteligência mais universal e flexível, por que eles são tão populares?Não há dúvida de que os esforços para derrotar o campeão em videogames famosos devem-se principalmente ao fato de que esses projetos podem atrair muita atenção da mídia. Se o público não estivesse interessado nessas impressionantes "realizações", que podem ser facilmente imaginadas como supostamente um progresso na obtenção de IA sobre-humana, os pesquisadores fariam outra coisa.

Isso me deixa um pouco triste, porque a pesquisa deve responder a questões científicas abertas e não se envolver em relações públicas. Se eu pretendo "resolver" o Warcraft 3 em um nível sobre-humano, usando treinamento profundo, você pode estar absolutamente certo de que tudo vai dar certo, desde que tenhamos talento para o desenvolvimento e poder de computação suficiente (que custará dezenas de milhões de dólares para resolver esse problema). Mas, tendo feito isso, o que aprendo sobre inteligência ou versatilidade? Nada. Na melhor das hipóteses, eu obteria o conhecimento de engenharia para dimensionar o aprendizado profundo. Portanto, não considero isso um estudo científico, porque não ensina o que ainda não sabíamos. Não respondemos a uma única pergunta em aberto. Se a pergunta era: "Podemos jogar X em um nível sobre-humano?", A resposta é inequívoca: "Sim, se você pode gerar muitas situações de treinamento e apresentá-las em um modelo bastante expressivo de aprendizado profundo". Já sabemos disso há algum tempo (na

verdade, eu disse isso antes da IA atingir o nível de campeão no Dota 2 e Starcraft )

.Na sua opinião, quais são as realizações reais desses projetos? Até que ponto seus resultados são mal interpretados ou distorcidos?Uma distorção séria que vejo é que esses sistemas de jogos de alto nível representam um progresso real em direção a "sistemas de IA e sua capacidade de lidar com a complexidade e a incerteza do mundo real" [isso é da declaração da OpenAI em um

comunicado de imprensa ao seu OpenAI Five bot jogando Dota 2]. Mas eles não podem. Se assim fosse, seriam estudos muito úteis, mas isso simplesmente não é verdade. Por exemplo, veja o OpenAI Five: ele não conseguia lidar com a complexidade do Dota 2, porque ele era treinado em 16 personagens e não podia espalhar conhecimento para todo o jogo, no qual existem mais de 100 caracteres. Foram necessários 45.000 anos de jogabilidade para treiná-lo - novamente, observe como os requisitos para dados de treinamento crescem junto com a complexidade da tarefa - no entanto, o modelo resultante acabou sendo muito frágil: jogadores não-campeões poderiam encontrar estratégias para derrotar o bot através alguns dias depois que a IA ficou disponível ao público.

Se você quiser aprender a lidar com a complexidade e a incerteza do mundo real, comece a fazer perguntas como: qual é a universalidade da inteligência? Como medimos e aumentamos a versatilidade em nossos sistemas de aprendizado? E isso não é nada parecido com o que estamos fazendo agora, quando lançamos 10 vezes mais dados em uma grande rede neural para que ela melhore suas habilidades em vários por cento.

Então, qual medida de inteligência é melhor para a indústria?Em resumo, devemos parar de avaliar habilidades em tarefas conhecidas, como xadrez, Dota ou StarCraft, e começar a avaliar a capacidade do sistema de adquirir habilidades. Isso significa que devemos usar apenas novas tarefas que não eram conhecidas anteriormente pelo sistema, medir o conhecimento preliminar da tarefa com a qual o sistema foi iniciado e medir a eficácia do sistema (quantos dados são necessários para aprender como concluir a tarefa). Quanto menos informações (conhecimento e experiência anteriores) você precisar para atingir um certo nível de habilidades, mais inteligente será. Dado o exposto, de fato, os sistemas modernos de inteligência artificial não são muito inteligentes.

Além disso, com essa medida de inteligência, as máquinas se parecerão mais com as pessoas porque podem haver diferentes tipos de inteligência, e a inteligência humana é o que indiretamente queremos dizer quando falamos sobre inteligência universal. E isso também inclui tentativas de entender com que conjunto de conhecimentos as pessoas nascem no mundo. As pessoas aprendem incrivelmente efetivamente - elas precisam de muito pouca experiência para adquirir novas habilidades - mas não o fazem do zero. Eles usam conhecimento inato, além das habilidades e conhecimentos acumulados ao longo da vida.

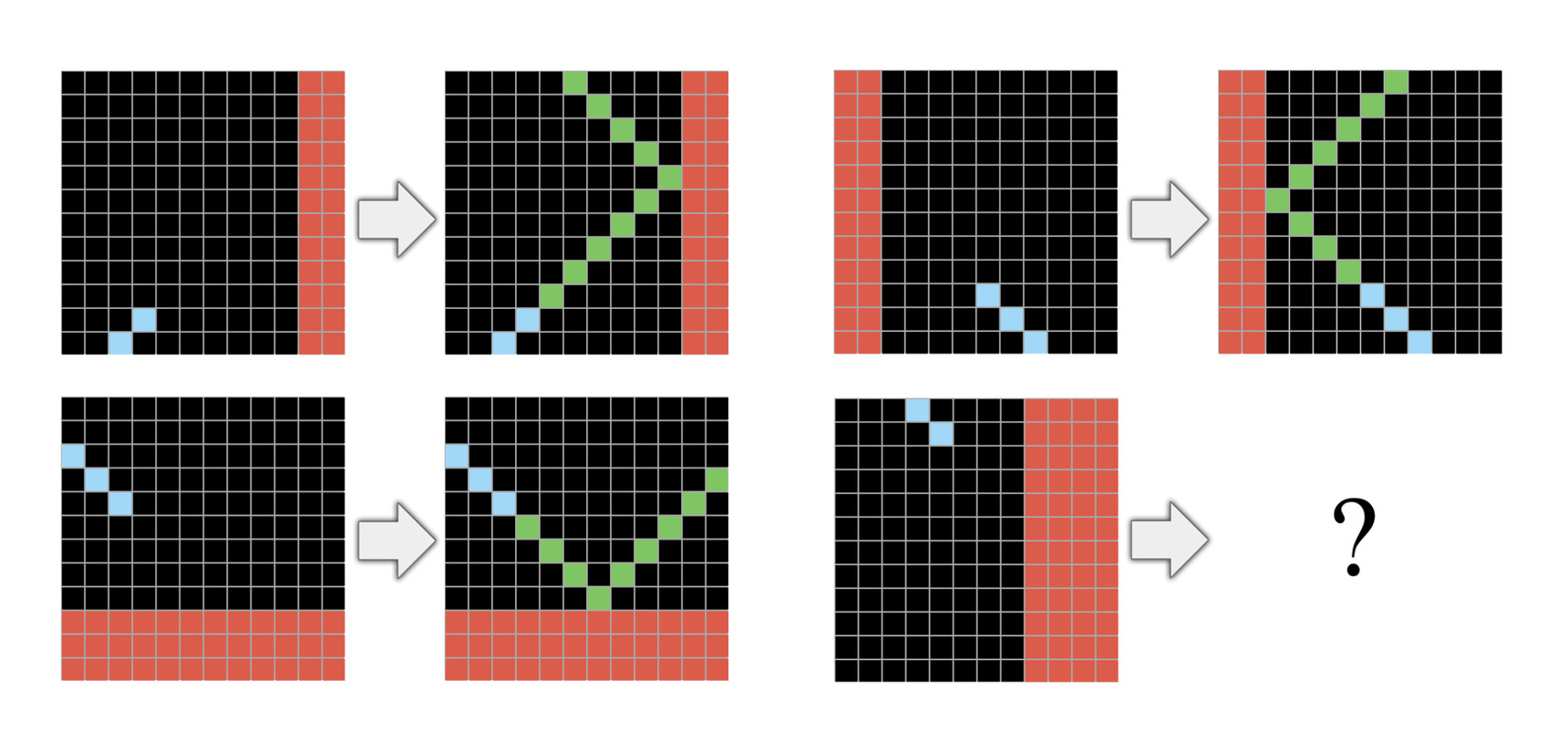

No meu artigo recente, proponho um novo conjunto de dados de avaliação, o ARC, que é muito semelhante ao teste de QI. O ARC é um conjunto de tarefas mentais em que cada tarefa é explicada em uma curta sequência de demos, geralmente três, e você deve aprender como concluir a tarefa com essas poucas demos. A idéia por trás do ARC é que todas as tarefas que avaliam seu sistema devem ser completamente novas e incluir apenas conhecimento que seja consistente com o conhecimento inato humano. Por exemplo, a linguagem humana não pode ser usada em tais tarefas. Atualmente, as pessoas podem resolver o ARC sem nenhuma explicação verbal ou preparação preliminar, mas nenhum dos sistemas de IA atualmente conhecidos pode resolvê-lo. Este é um marcador importante de que precisamos de novas idéias.

Você acha que o mundo da IA será capaz de continuar seu progresso simplesmente aumentando o poder da computação para resolver problemas? Alguns argumentam que, ao longo dos anos, essa foi a maneira mais eficaz de aumentar a produtividade. Quando outros sugerem que, se seguirmos esse caminho, os resultados e as taxas de crescimento começarão a se deteriorar.

Você acha que o mundo da IA será capaz de continuar seu progresso simplesmente aumentando o poder da computação para resolver problemas? Alguns argumentam que, ao longo dos anos, essa foi a maneira mais eficaz de aumentar a produtividade. Quando outros sugerem que, se seguirmos esse caminho, os resultados e as taxas de crescimento começarão a se deteriorar.Isso é absolutamente verdade se você estiver trabalhando em uma tarefa específica. O uso de mais dados de treinamento e mais poder de computação para uma tarefa vertical aumentará a produtividade dessa tarefa. Mas ele proporcionará uma compreensão praticamente nula de como obter versatilidade na inteligência artificial.

Se você tiver um modelo suficientemente grande de treinamento aprofundado e uma boa amostra para a tarefa, aprenderá como resolver esse problema, seja Dota ou StarCraft, qualquer coisa. E é extremamente valioso. Isso pode ser usado em um número quase infinito de tarefas relacionadas à percepção da máquina. O único problema é que a quantidade de dados necessária é uma função combinatória relativa à complexidade da tarefa, portanto, mesmo tarefas um pouco complexas podem se tornar muito caras.

Tomemos, por exemplo, carros de piloto automático. Milhões de situações de treinamento não serão suficientes para um modelo que usa apenas treinamento aprofundado para aprender a dirigir com segurança. É por isso que ainda não temos um piloto automático de quinto nível. E nos sistemas mais avançados de piloto automático, o aprendizado profundo é usado principalmente para vincular dados de sensores e modelos criados manualmente. E se tivéssemos um aprendizado profundo universal, teríamos um piloto automático de nível 5 em 2016 na forma de uma grande rede neural.

E, finalmente, dado que você está falando sobre as limitações da IA moderna, parece-me que vale a pena perguntar sobre o medo de que uma IA extremamente poderosa possa prejudicar a humanidade em um futuro próximo. Você acha que esses são medos bem fundamentados?Não, não acredito na validade dessa ideia. Nunca criamos uma IA autônoma. E não há absolutamente nenhum sinal de que seremos capazes de criá-lo em um futuro próximo. (A indústria de IA não está se movendo nessa direção agora.) E não podemos nem imaginar quais seriam suas características se, finalmente, a criarmos em um futuro distante. Se você quer uma analogia, é como perguntar em 1600: “A balística está se desenvolvendo rapidamente! Mas e se tivermos uma arma que pode destruir uma cidade inteira. Como podemos ter certeza de que ela só matará os bandidos? Essa é uma pergunta pouco formulada, e sua discussão na ausência de qualquer conhecimento exato sobre essa IA futura, na melhor das hipóteses se resume a um argumento filosófico.

E, no entanto, esses medos em relação à inteligência desviam a atenção de outras áreas nas quais a IA pode ser muito perigosa atualmente. Certas maneiras de usar a IA são perigosas sem super inteligência. Escrevi sobre como a IA pode ser usada para sistemas de propaganda algorítmica. Muito já foi escrito sobre a tendência crescente de usar a IA em sistemas de armas ou sobre a IA como uma ferramenta para controle totalitário.

Há uma história sobre o cerco de Constantinopla em 1453. Enquanto a cidade lutava contra o exército otomano, seus estudiosos e governantes discutiram que tipo de anjo poderia ser de gênero. E quanto mais energia e atenção dedicamos ao debate sobre o sexo dos anjos ou para pensar sobre os valores que uma IA super inteligente deve ter, menos prestamos atenção à solução de problemas prementes e reais. Existe um líder bem conhecido em TI que gosta de falar sobre IA superinteligente como a principal ameaça à humanidade. Bem, embora essas idéias ocupem todas as manchetes, você não está discutindo se é ético produzir carros com piloto automático insuficientemente preciso em nossas estradas, o que leva a acidentes e mortes.

Se você aceita essas críticas - de que no momento não há base técnica para esses medos - por que, na sua opinião, elas são tão populares?Eu acho que essa é apenas uma história bonita e as pessoas gostam. Não é por acaso que tudo lembra muito as histórias religiosas sobre o fim do mundo, porque essas histórias se espalham e ressoam entre as pessoas há muito tempo. Pela mesma razão, esse medo é frequentemente usado em filmes e romances de ficção científica. Isso é porque é uma história bonita.

E as pessoas precisam de histórias para entender o mundo. E essas histórias são muito mais procuradas do que entender a natureza da inteligência ou entender o que impulsiona o progresso tecnológico.Também há peças mais interessantes no canal Telegram .