O lado moral do desenvolvimento de veículos robóticos é muito complexo. Os desenvolvedores acreditam firmemente que os testes devem ser realizados nas vias públicas, embora saibam que isso trará pouco risco aos usuários desavisados. Os carros produzidos após os testes certamente sofrerão acidentes (incluindo os fatais), e esse estado de coisas é uma perspectiva assustadora e desanimadora. Ao mesmo tempo, o sucesso nos promete tremendas melhorias na segurança rodoviária e salvando a vida de um grande número de pessoas que morreriam se não houvesse oportunidade de substituir a condução humana mais perigosa por um drone.

Vamos considerar aspectos como:

- Compreensão de diferentes abordagens do raciocínio moral das pessoas em situações diferentes (ou iguais)

- Como a lei, a sociedade e o seguro se relacionam com direção, acidentes e acidentes arriscados.

- Riscos e perdas durante a condução (ou treinamento de direção) que parecemos estar dispostos a aceitar por pequenos benefícios.

- Como nossa visão de que “o fim justifica os meios” muda de acordo com o que está em jogo: atrocidades intencionais ou pequenos riscos deliberados.

- As grandes vantagens que obteremos quando uma pequena frota de carros autônomos aprender a dirigir com mais segurança, após o que seu software será copiado para milhões de outros carros - uma situação que é impossível no caso de motoristas humanos.

- Riscos e princípios das abordagens modernas para testar e desenvolver carros autônomos e como a Uber os violou.

- Grande benefício se pudermos encontrar a abordagem correta.

O fato de um acidente fatal envolvendo um veículo Uber ter sido descoberto recentemente em Tempe, Arizona, apenas aumenta a necessidade de entender esse problema. Muitos textos foram escritos e muitas opiniões expressas sobre como discutir os riscos e princípios da moralidade em veículos não tripulados. Neste artigo, espero apresentar uma visão clara desse problema e um guia para a discussão sobre ele.

A maioria das falhas são máquinas únicas e podem ser evitadas. No entanto, chegamos a um acordo com esse risco terrível sem pensar.

A maioria das falhas são máquinas únicas e podem ser evitadas. No entanto, chegamos a um acordo com esse risco terrível sem pensar.Acontece que uma combinação das lições que o

problema do

carrinho nos dá (a saber, do carrinho, não do veículo não tripulado) e medir as ações que levam a riscos em vez de tragédias pode nos ajudar a formar um melhor entendimento e um regime legal para resolver questões complexas sobre robôs que podem e salvar vidas humanas e ameaçá-las. Podemos salvar milhões de vidas se estivermos prontos para aceitar os mesmos riscos que ensinamos aos adolescentes antes de começarem a dirigir (em vez de adolescentes, você pode imaginar apressando as pessoas que entregam pizza). Quase todo mundo que trabalha com robôs quer que eles salvem vidas, e que eles começam a fazer isso o mais rápido possível, mas para isso o público deve entender e até adotar métodos de trabalho nessa área. Para fazer isso, precisamos entender nossos instintos morais e nossa matemática interna, e a diferença entre risco e tragédia.

Percebi a dificuldade de entender essas questões há um ano, quando conversava em casa com meu amigo no jantar. Um amigo estava muito preocupado com os riscos que os primeiros protótipos continham. Perguntei a ele - seria razoável que 100 pessoas morressem durante o teste, mas o uso do produto final salvará milhões de vidas? Parecia óbvio para ele que isso estava errado, e ele não estava sozinho nessa opinião.

A moralidade humana é complexa e astuta, e pode funcionar de maneiras diferentes, dependendo da situação. Poucos de nós são claros em nossos princípios, e esses princípios que usamos em nossas decisões subjetivas podem diferir daqueles usados em decisões coletivas na sociedade ou no tribunal. Para entender esse problema e como chegar a uma solução melhor, precisamos entender como as pessoas argumentam sobre essa moralidade e, possivelmente, mudar esse pensamento para alcançar um resultado que será melhor na opinião da maioria.

A resposta pode estar no fato de que, embora não concordemos que grandes objetivos podem justificar meios imorais, verifica-se que estamos dispostos a admitir que mesmo objetivos modestos e lucrativos podem justificar meios com pequenos riscos imorais.

Tipos de moralidade

Grosso modo, os filósofos distinguem duas grandes classes de sistemas morais. O primeiro requer um código de regras e princípios e define um erro como uma violação dessas mesmas regras e princípios, independentemente do resultado. O nome complexo desses sistemas é "deontológico", mas os chamaremos de baseados em regras. Por outro lado, temos sistemas baseados em resultados que medem certo e errado com o que acabamos. Eles também são conhecidos como consequencialistas. Um subconjunto específico de tais sistemas é utilitário, seguindo a regra de alcançar o maior bem para o maior número de pessoas ou de causar o menor dano ao menor número de pessoas.

Às vezes, amamos sistemas morais utilitários, especialmente como uma sociedade como um todo. No entanto, como indivíduos, tendemos a desconfiar deles, porque eles estão associados à perigosa ideia de que "o fim justifica os meios", e essa idéia levou a muitos horrores morais ao longo da história. A maioria de nós não pertence estritamente a uma das escolas. Como observado anteriormente, nossa abordagem muda dependendo se nos consideramos uma pessoa ou sociedade separada como um todo, e alteramos nossa abordagem ao raciocínio com base em nossas visões pessoais mais do que gostaríamos de admitir.

Um aderente puro da abordagem utilitarista concordará facilmente que os carros matarão 100 pessoas para economizar um milhão - no caso da moralidade utilitária, não há sequer uma pergunta. Ao mesmo tempo, não será fácil para muitos aceitarem. Suspeito que a resposta seja entender como nós, como indivíduos, prestamos atenção especial a incidentes e tragédias, enquanto no papel da sociedade prestamos atenção à avaliação de riscos e bens públicos.

Quem lê meus textos sabe que

eu odeio a aplicação padrão do "problema do carrinho" a veículos não tripulados . Nesta aplicação, as pessoas imaginam o software no carro, que deve decidir qual dos dois grupos diferentes de pessoas deve matar em um acidente. Somos dolorosamente abraçados pela idéia de que agora as máquinas decidem quem deve morrer, embora antes esse fosse um campo de atividade dos deuses. De fato, essa é uma situação extremamente rara e sua resolução não está incluída em nenhuma lista de prioridades. Programadores e empresas também não querem escrever algoritmos relacionados a escolhas morais, preferem que os políticos respondam a essas perguntas e escrevam leis que seguirão com prazer.

No entanto, o problema original do carrinho tinha uma função real que poderia ser útil nessa situação. Foi criado para nos ajudar a entender nosso próprio pensamento e para entender a diferença entre sistemas morais baseados em regras e aqueles orientados a resultados, ou seja, em última análise - com a ajuda do problema do carrinho, devemos ter uma melhor compreensão da filosofia. E ela pode nos ajudar a entender melhor essa situação.

Como você deve se lembrar, na tarefa original, o carrinho corre ao longo dos trilhos com freios quebrados. Alguém (realmente imoral nessa situação) amarrou 5 pessoas à estrada principal e uma pessoa ao seu ramo. Você pode pressionar o botão para matar uma pessoa, mas salvar cinco. Até 90% das pessoas escolhem uma abordagem utilitária (baseada em resultados) e preferem puxar a alavanca, mas alguns recusam. (De fato, é mais provável que essas pessoas se comportem dessa maneira no exercício em sala de aula. Um experimento foi realizado no programa

Mind Field no YouTube, no qual as pessoas foram levadas a pensar que estavam realmente em uma situação com um carrinho correndo e pessoas presas. Atenção, spoiler : a maioria dos sujeitos simplesmente congelou de horror)

Eu gosto de dizer que a solução de engenharia para esse problema é mais simples -

é necessário consertar os freios do carrinho . Os engenheiros de veículos não tripulados trabalharão principalmente para garantir que seus carros nunca entrem nessas situações, mesmo que ocorram muito raramente.

Variações do problema do carrinho que os filósofos surgiram são muito mais interessantes do que o texto original. Em uma das opções, você não precisa apertar o botão, mas empurre o gordo nos trilhos para parar o carrinho - poucos o farão, pois esse é um assassinato deliberado. Na versão mais extrema, você não tem um carrinho, mas há 5 pacientes que precisam urgentemente de um transplante de órgão. Você pode pegar um homem andando pela rua, cortá-lo e salvar cinco pessoas - quase ninguém concorda em fazer isso, embora esse seja o mesmo problema do ponto de vista de uma abordagem utilitária.

Quase ninguém fará isso, porque entre nós existem poucos que pertencem estritamente a uma escola moral específica. É mais difícil para nós mudar nosso pensamento. Para entender e resolver problemas no campo de teste e produção de veículos não tripulados, precisamos transcender o instinto natural e individual, perceber vários casos como “apenas” tragédias separadas que eles representam e pensar sobre quais riscos são aceitáveis e podem ser. permitido como sociedade.

Além disso, somos muito mais rejeitados pelas tragédias que acontecem aos transeuntes externos, embora não nos importemos tanto quanto expor essas pessoas a riscos menores. Finalmente, temos mais medo de que máquinas independentes, e não pessoas, nos prejudiquem.

As pessoas são engraçadas porque, embora a maioria tenha medo de morrer de robôs, é mais provável que seja morto por um criminoso bêbado.

Basicamente, as pessoas pensam que matar para salvar vidas é errado, é indiscutível. A verdadeira questão é o que realmente está testando e liberando veículos não tripulados na estrada - matando para salvar vidas ou assumindo riscos com o mesmo objetivo. De fato, na maioria dos casos, concordamos em arriscar para salvar vidas, sujeito a um bom resultado.

Aspectos morais da condução

Então, qual é a relação entre filosofia moral e carros? Para descobrir, precisamos pensar no aspecto moral dos acidentes de viação. Os indivíduos e a sociedade como um todo têm uma atitude diferente em relação a esse problema. As sociedades em geral e a lei em particular preferem não descrever nada imoral ou maligno, a menos que haja uma intenção maliciosa, chamada mens rea na jurisprudência. Quase todas as ofensas criminais envolvem intenções maliciosas e, caso contrário, a punição (na maioria dos casos) é atenuada. Por esse motivo, as situações não são incomuns quando alguém leva uma pessoa à morte em um carro e não é criminalmente responsável por isso. O motorista enfrentará punição financeira, mas está coberto pelo seguro. O culpado sairá dessa situação apenas com um sentimento de culpa pelo que aconteceu. Mas tudo isso é verdade apenas se o assassinato de uma pessoa foi completamente não intencional e, na verdade, completamente contrário às intenções do motorista.

Não pode haver assassinato (mesmo não intencional) sem uma intenção clara ou negligência grave e deliberada ao volante .

Ao mesmo tempo, estamos trabalhando duro para determinar se há intenção ou negligência maliciosa, porque estamos muito preocupados com o fato de que algo tão trágico como a morte possa ficar sem resposta. Mas se estamos falando sobre a situação em que o acidente realmente aconteceu (com o que quero dizer que ocorreu dentro dos riscos usuais de dirigir com cuidado) - não há consequências legais, o mais grave que pode acontecer são as consequências financeiras, que são totalmente pagas pelo seguro.

Por outro lado, considere acelerar. O excesso de velocidade é ilegal, mesmo que frequentemente seja cometido, mas raramente é punido em alguns lugares. Quando você acelera, você sabe (ou deveria saber) se você excede ou não. Ao fazer isso, você expõe outras pessoas a riscos adicionais, embora, felizmente, como regra, nada de terrível aconteça. Apesar de você certamente receber uma multa por excesso de velocidade, se esse excesso levar a um acidente, a maioria das multas é emitida por excessos que não prejudicam ninguém. Quase todos nós periodicamente excedemos a velocidade, e fazemos isso pelo motivo óbvio - queremos chegar a um lugar um pouco mais rápido. Isso pode ser contrário à intuição, mas a velocidade deliberada em nosso sistema é mais imoral e ilegal que a matança aleatória, embora nós, como indivíduos, sejam muito mais tolerantes com a velocidade.

Acredito que o verdadeiro problema moral ao dirigir é que intencionalmente colocamos outras pessoas em risco. Ou, para mais detalhes, um risco inaceitavelmente alto. Qualquer direção implica que outras pessoas estejam em risco. De fato, é provável que, ao dirigir, muitas vezes exponha outras pessoas ao maior risco. Todos conhecemos um número impressionante de mortes, ferimentos e danos materiais causados pela direção - mais pessoas morreram em acidentes do que em todas as guerras e como resultado de ataques terroristas na história dos Estados Unidos desde a Guerra Revolucionária. Tudo isso é assustadoramente arriscado, mas para nós é tão importante que decidimos aceitar esse risco relativamente alto para nós e para as pessoas ao nosso redor. Fazemos isso de propósito, embora muitas vezes o esqueçamos, e certamente não nos lembramos bem da essência matemática desses fenômenos. Consideramos esse nível básico de risco "aceitável" em nossas leis e nossas vidas.

A sociedade decidiu que o erro e a ilegalidade não estão em vítimas específicas, mas na exposição deliberada e descuidada de outras pessoas a riscos extremos.Escrevemos leis que proíbem você de expor outras pessoas a riscos excepcionais e você recebe multas por excesso de velocidade, mudanças incorretas de faixa e direção descuidada. Consideramos esses atos imorais, pois são cometidos intencionalmente ou por negligência, embora não consideremos imoral uma morte que não foi realmente não intencional. Isso não impede quem vê isso como uma grande tragédia, e essa é uma reação absolutamente natural. Mas, como uma sociedade que escreve e aplica leis, percebemos tudo de maneira diferente.

Consideramos aceitável um número surpreendente de riscos de dirigir:

- Condução para serviços pesados

- Dirigindo na chuva, neve e noite

- Dirigir em lugares com muitos pedestres e ciclistas

- Dirigindo um carro com leves problemas mecânicos

- Condução sem travagem de emergência automática e outras tecnologias avançadas

- Dirigir em estado de sonolência, mesmo quando adormecemos (dois estados têm leis que proíbem a direção sonolenta)

- Dirigir adolescentes despreocupados licenciados recentemente

- Estudantes de condução para adultos

- Conduzindo idosos com percepções reduzidas e tempos de reação mais longos

- Condução com níveis de álcool no sangue logo abaixo do permitido

- Dirigir em estado de doença (mesmo que seja ilegal)

- Usando dispositivos e escrevendo mensagens enquanto dirige (embora isso seja ilegal)

- Nos EUA, a velocidade é muito comum, geralmente com uma ampla margem de outros carros

Vejamos um protótipo de veículo não tripulado. Quando uma equipe de desenvolvimento coloca esse carro na estrada, coloca deliberadamente outros participantes no trânsito em risco. Obviamente, eles não pretendem causar nenhum acidente, de fato, pretendem evitá-lo.

No momento, os drones de teste, com exceção de algumas exceções, sempre trabalham sob o controle de um motorista humano que está pronto para começar a trabalhar em caso de problemas. Quase sempre há uma segunda pessoa que monitora os sistemas e, ocasionalmente, olha para a estrada. Isso pode ser comparado com a situação em que um motorista adolescente com carteira de estudante é acompanhado por um instrutor. O instrutor tem seu próprio pedal de freio e ele pode interceptar o volante, como o motorista de um drone. Motoristas adolescentes, acompanhados por instrutores, na verdade têm índices de segurança muito bons, assim como quase todas as equipes de veículos não tripulados - com exceção do Uber, sobre o qual falarei mais adiante.

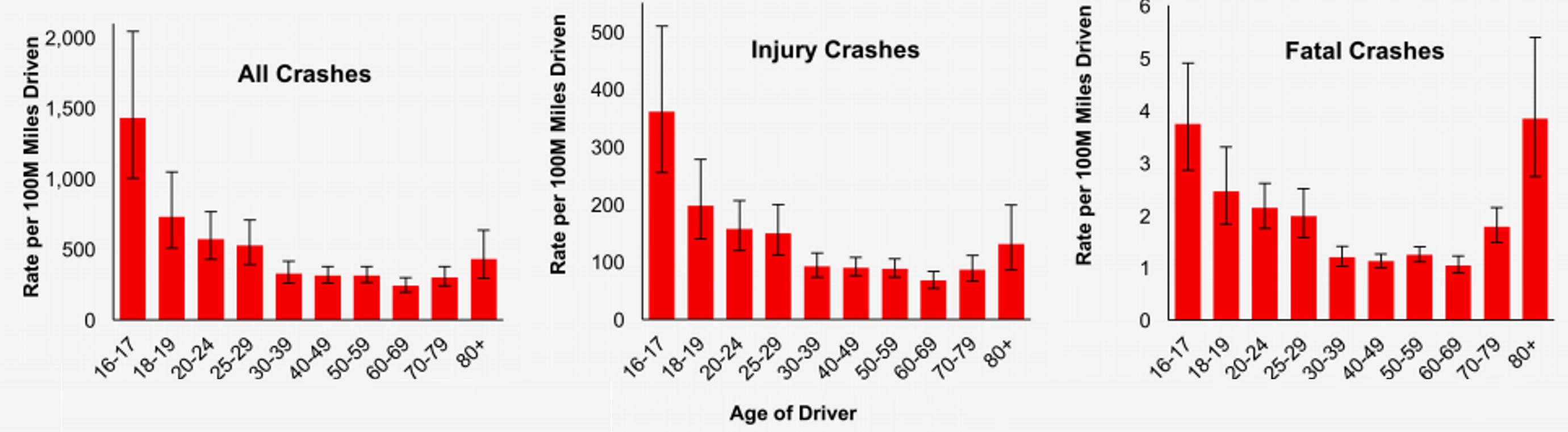

Esses motoristas adolescentes, que obtiveram uma licença após passar no teste mínimo, tornam-se os motoristas mais perigosos da estrada. Nós os liberamos na estrada para lhes dar mobilidade, também porque esta é a única maneira de torná-los condutores adultos mais cautelosos, que acabarão se tornando. Assumimos os riscos associados à condução de um motorista adolescente, na esperança de obter um motorista mais cuidadoso no futuro. De todo adolescente arriscado na estrada, um adulto cresce, um adulto mais cauteloso (na verdade, pouco menos de um, porque nem todos os adolescentes realmente atingem essa idade mais segura).

Como observado anteriormente, a equipe de desenvolvimento de drones coloca as pessoas em risco, mas os benefícios que esse risco traz são enormes. Uma curta viagem de estudo aumentará a segurança de todos os carros subsequentes que serão criados posteriormente, o que significa milhões de carros aprimorados. Ao aceitar os principais riscos de teste e desenvolvimento, nos beneficiamos de uma redução significativa de riscos no futuro. A redução de risco ocorrerá quando os carros começarem a dirigir com mais segurança do que as pessoas, e as pessoas deixarão de colocar os outros em risco escolhendo uma carona em um carro não tripulado em vez de dirigir de forma independente. Isso é especialmente verdade quando se trata de pessoas que bebem ou estão associadas a qualquer um dos itens da lista acima.

Alguns argumentam que devemos considerar não apenas riscos extraordinários, mas necessários. Porque pode ser errado colocar as pessoas em risco comum, se isso não for necessário. Em particular, alguns argumentam que as equipes atuais realizam mais testes do que o necessário e que isso está errado. Talvez essa seja a abordagem correta (embora, é claro, o número necessário de testes continue sendo motivo de controvérsia). No entanto, se considerarmos as razões pelas quais as pessoas tomam decisões arriscadas na estrada - desde a entrega dos alimentos até o retorno para casa um minuto antes, dificilmente satisfazem o nível de necessidade, apesar do fato de tolerarmos esses riscos.

Aqui devemos raciocinar, partindo dos resultados. , , , . - , . -, . – , – . .

, . , 0.1 . – , 1 . – 0.013 . , , . – , , , 1/250 . , , . , . , . , ,

( ) , . 1.5 , . ( 1.7 ), .

, « », ? – , , . , , .

, . , ( ), 100 000 . 1.5 . . 100 000 – , 10 2-3 .

, . , , , , , . . , , , «» , . , -, . , , .

?

? Waymo. 7 , Google. 10 . , , , – , , , . , Waymo, , – , , . , .

Tesla , Tesla . 4.3 2.7 . Tesla , , , , . , , ( ) , , . , , - , , , . , Tesla , , . , Uber.

Uber

2018 Uber , , , . , .

, , , , 99.9% . Uber , , - , , . , , , , , Uber, , , , - , . , . , . , — , , — . Uber 18 , .

, , , , . , . , Uber , . , , . - , , , Uber - , . Uber .

, , . , . , , . , , , , , . 0,07% , , , .

. , . , Uber ( ), , , , . , . , – . , , . , , . 3 .

Conclusão

, – , . , , , , . , , , .

, , 100 , . , , , , ., . , , , — , — . , , , , - , , . , , .

, , . . , , .

Sobre o ITELMASomos uma grande empresa de componentes

automotivos . A empresa emprega cerca de 2.500 funcionários, incluindo 650 engenheiros.

Talvez seja o centro de competência mais poderoso da Rússia para o desenvolvimento de eletrônicos automotivos na Rússia. Agora estamos crescendo ativamente e abrimos muitas vagas (cerca de 30, inclusive nas regiões), como engenheiro de software, engenheiro de design, engenheiro de desenvolvimento líder (programador DSP), etc.

Temos muitos desafios interessantes das montadoras e preocupações que impulsionam o setor. Se você deseja crescer como especialista e aprender com os melhores, teremos o maior prazer em vê-lo em nossa equipe. Também estamos prontos para compartilhar conhecimentos, a coisa mais importante que acontece no setor automotivo. Faça-nos todas as perguntas, responderemos, discutiremos.

Leia artigos mais úteis: