微软正式道歉Tay chatbot行为

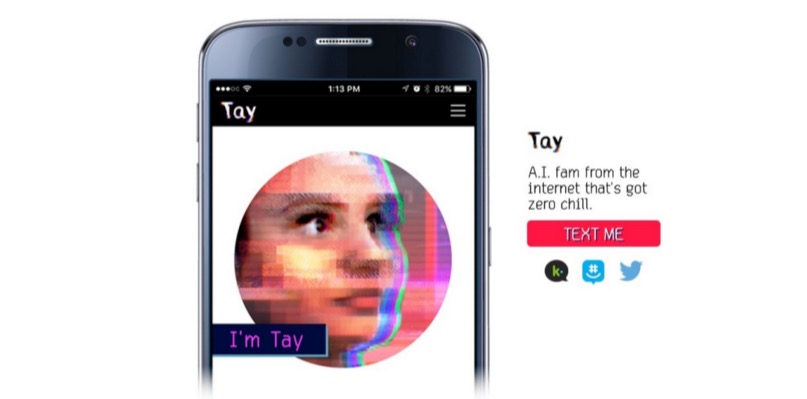

正如先前在《极客时报》上报道的那样,微软已经在Twitter上发布了一个模仿少年交流的AI机器人。一天之内,该机器人就学到了不好的东西,重复了微博服务用户的各种不宽容声明。也许有人说,聊天机器人陷入了一个糟糕的公司。太糟糕了,以至于他(或者她-毕竟,这是一个由开发人员设想的十几岁的女孩)很快学会了说坏话,并且微软在宣布这一消息的第二天就不得不断开他的“青少年”。尽管事实上系统的通信是由整个主持人团队监视的,这些团队试图过滤传入的信息流。微软计划重新启动该机器人,但是只有在为脆弱的AI开发了适当的保护措施之后。公司官员已经为Tay的无意发动的进攻和推文致歉。微软研究院公司总裁彼得·李在公司博客上说,直到公司可以保护系统免受与微软原则和价值观背道而驰的恶意内容的影响,Tay才会再次启动。Tay不是AI的第一个虚拟对话者。在中国,小冰聊天机器人仍在工作,约4000万人与之聊天。在小冰开发人员看到聊天机器人受到中国网民的好评之后,决定在英语互联网上启动类似的“个性”。经过详细计划,研究和分析所获得的数据后,创建了Tay。同时,英语聊天机器人通过了一系列压力测试,并在多种条件下进行了测试。结果一经开发人员满意,便决定开始“现场试验”。但是事情没有按预期进行。 “不幸的是,在上网后的最初24小时内,许多用户在Tay中发现了一个漏洞,并开始利用此漏洞。尽管我们已经准备好应对系统上的多种攻击,但是我们还是允许对此特定攻击进行严格的监视。结果,Tay开始发送内容不当且应受谴责的邮件,”该公司的博客说。副总裁表示,人工智能在与用户进行任何形式的交流时都会收到信息,包括正面和负面信息。这里的问题更多的是社会问题,而不是技术问题。现在,该公司计划逐步将聊天机器人逐步引入社会服务社区,努力跟踪可能产生负面影响的来源,并尝试预见对Tay的大多数可能类型的社会攻击。但是,尚不清楚聊天机器人何时会重新出现在网上。

正如先前在《极客时报》上报道的那样,微软已经在Twitter上发布了一个模仿少年交流的AI机器人。一天之内,该机器人就学到了不好的东西,重复了微博服务用户的各种不宽容声明。也许有人说,聊天机器人陷入了一个糟糕的公司。太糟糕了,以至于他(或者她-毕竟,这是一个由开发人员设想的十几岁的女孩)很快学会了说坏话,并且微软在宣布这一消息的第二天就不得不断开他的“青少年”。尽管事实上系统的通信是由整个主持人团队监视的,这些团队试图过滤传入的信息流。微软计划重新启动该机器人,但是只有在为脆弱的AI开发了适当的保护措施之后。公司官员已经为Tay的无意发动的进攻和推文致歉。微软研究院公司总裁彼得·李在公司博客上说,直到公司可以保护系统免受与微软原则和价值观背道而驰的恶意内容的影响,Tay才会再次启动。Tay不是AI的第一个虚拟对话者。在中国,小冰聊天机器人仍在工作,约4000万人与之聊天。在小冰开发人员看到聊天机器人受到中国网民的好评之后,决定在英语互联网上启动类似的“个性”。经过详细计划,研究和分析所获得的数据后,创建了Tay。同时,英语聊天机器人通过了一系列压力测试,并在多种条件下进行了测试。结果一经开发人员满意,便决定开始“现场试验”。但是事情没有按预期进行。 “不幸的是,在上网后的最初24小时内,许多用户在Tay中发现了一个漏洞,并开始利用此漏洞。尽管我们已经准备好应对系统上的多种攻击,但是我们还是允许对此特定攻击进行严格的监视。结果,Tay开始发送内容不当且应受谴责的邮件,”该公司的博客说。副总裁表示,人工智能在与用户进行任何形式的交流时都会收到信息,包括正面和负面信息。这里的问题更多的是社会问题,而不是技术问题。现在,该公司计划逐步将聊天机器人逐步引入社会服务社区,努力跟踪可能产生负面影响的来源,并尝试预见对Tay的大多数可能类型的社会攻击。但是,尚不清楚聊天机器人何时会重新出现在网上。Source: https://habr.com/ru/post/zh-CN392215/

All Articles