IBM“抵抗性”处理器将使神经网络的训练过程加快3万倍

欢迎来到iCover博客页面!为了开发智能功能,使Google AlphaGo在游戏Guo Lee Sedoll中击败世界冠军,AI花费了数千枚筹码和漫长的训练。同时,IBM工程师已经在实现一个概念,该概念将允许将这些甚至更多令人印象深刻的智能功能集成到一个节能芯片中。 IBM的Watson研究中心的Tayfun Gokmen和Yuri Vlasov开发了一种新的电阻处理单元(RPU)芯片,该芯片结合了中央处理器和非易失性存储器,可以显着加速神经网络(Deep Neural Networks,GNN)的深度学习过程。与具有相对较低功耗值的现有处理器相比。“该系统由RPU加速器集群组成,将能够完成大数据任务,同时处理数万亿个参数。这种阵列的一个例子是世界上所有语言对之间自然语音的识别和翻译,实时科学和商业信息密集流的分析或来自大量IoT传感器的多模式数据流的分析,”研究人员对此事件发表了评论。在arxiv.org资源的页面上。在过去的几十年中,机器学习的速度取得了令人瞩目的进步。这是通过使用图形处理器,可编程逻辑FPGA阵列和专用芯片(ASIC)来实现的。今天,为了确保进一步加快进程,根据开发人员的说法,可以使用并行性和信息处理算法的局部性概念。在IBM实验室中成功实施此类概念的基础已成为下一代非易失性存储技术(相(PCM)和电阻式(RRAM))中实现的原理。

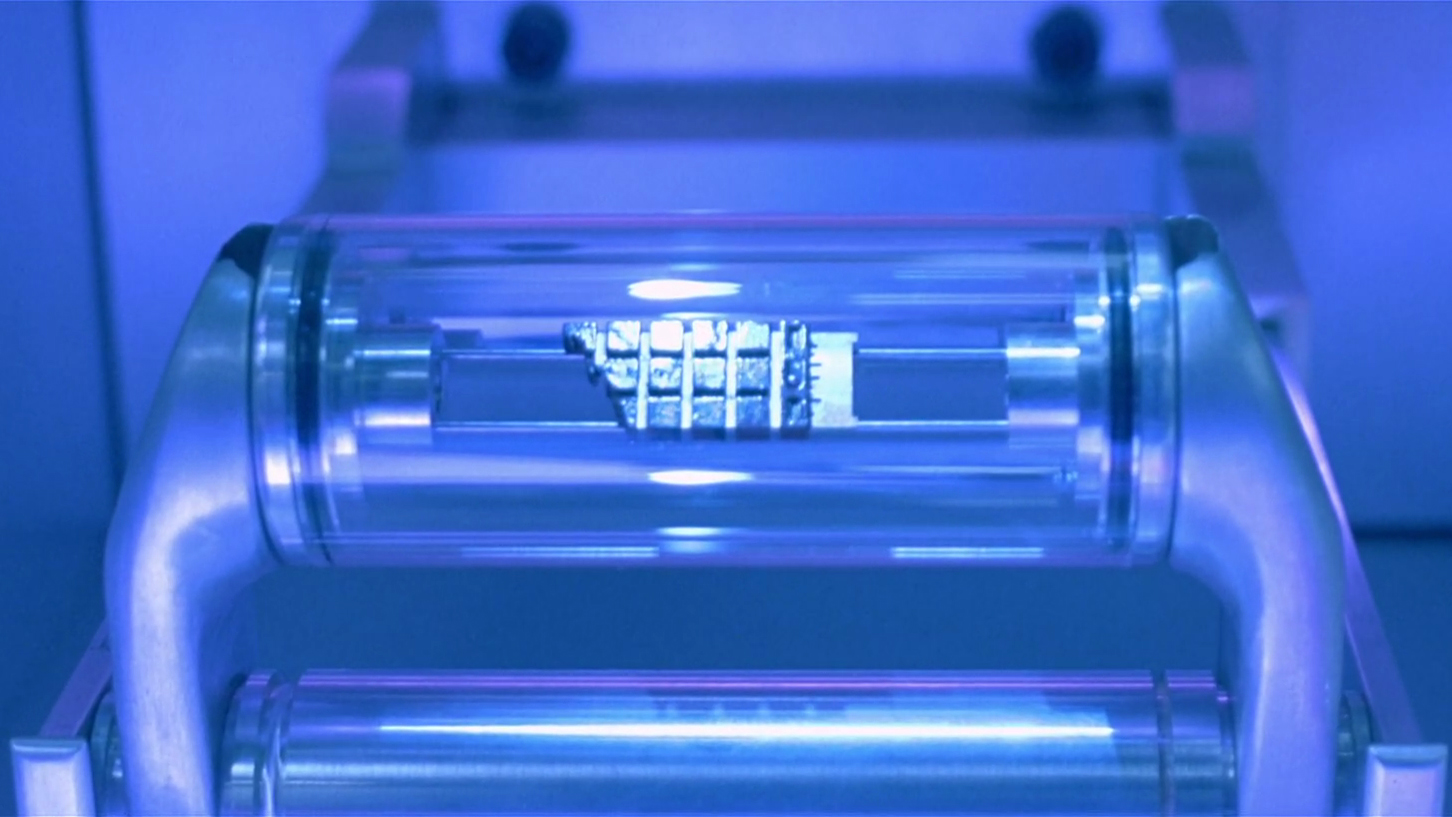

IBM的Watson研究中心的Tayfun Gokmen和Yuri Vlasov开发了一种新的电阻处理单元(RPU)芯片,该芯片结合了中央处理器和非易失性存储器,可以显着加速神经网络(Deep Neural Networks,GNN)的深度学习过程。与具有相对较低功耗值的现有处理器相比。“该系统由RPU加速器集群组成,将能够完成大数据任务,同时处理数万亿个参数。这种阵列的一个例子是世界上所有语言对之间自然语音的识别和翻译,实时科学和商业信息密集流的分析或来自大量IoT传感器的多模式数据流的分析,”研究人员对此事件发表了评论。在arxiv.org资源的页面上。在过去的几十年中,机器学习的速度取得了令人瞩目的进步。这是通过使用图形处理器,可编程逻辑FPGA阵列和专用芯片(ASIC)来实现的。今天,为了确保进一步加快进程,根据开发人员的说法,可以使用并行性和信息处理算法的局部性概念。在IBM实验室中成功实施此类概念的基础已成为下一代非易失性存储技术(相(PCM)和电阻式(RRAM))中实现的原理。 Schematics of original weight update rule of Eq.1 performed at each cross-point. (B) Schematics of stochastic update rule of Eq.2 that uses simple AND operation at each cross-point. Pulsing scheme that enables the implementation of stochastic updates rule by RPU devices for © up and (D) down conductance changes.拟议的内存本身使您可以将DNN(深度机器学习过程)加速27-2140倍,但是研究人员坚信,通过消除存储单元的某些结构限制,它们将能够提供更令人印象深刻的结果。根据致力于创新技术的专家联合团队的说法,基于新的非易失性存储器的芯片是根据他们开发的规范创建的,与最强大的微处理器相比,该算法的速度将提高3万倍。Vlasov和Gokmen认为,有可能在传统CMOS技术的基础上实现此类芯片。同时,很可能有可能在指定的存储技术“进入”市场之前的几年内,在商业解决方案级别实现上述概念。专家称,IBM进行的研究以及理论上取得的成果在当今看来非常有前途,因为它们为机器学习技术的发展提供了新的定性和定量机会的途径。重要的是,除了IBM本身之外,TJ Watson研究中心专家的联合开发很可能会成为Google和其他IT巨头的关注焦点,他们已经进入了长期争夺首先限制人工智能功能的权利的长期竞赛。反过来,这也将成为在商业产品级别上快速引入技术的另一种强大动力。来源技术可行性(pdf)

Schematics of original weight update rule of Eq.1 performed at each cross-point. (B) Schematics of stochastic update rule of Eq.2 that uses simple AND operation at each cross-point. Pulsing scheme that enables the implementation of stochastic updates rule by RPU devices for © up and (D) down conductance changes.拟议的内存本身使您可以将DNN(深度机器学习过程)加速27-2140倍,但是研究人员坚信,通过消除存储单元的某些结构限制,它们将能够提供更令人印象深刻的结果。根据致力于创新技术的专家联合团队的说法,基于新的非易失性存储器的芯片是根据他们开发的规范创建的,与最强大的微处理器相比,该算法的速度将提高3万倍。Vlasov和Gokmen认为,有可能在传统CMOS技术的基础上实现此类芯片。同时,很可能有可能在指定的存储技术“进入”市场之前的几年内,在商业解决方案级别实现上述概念。专家称,IBM进行的研究以及理论上取得的成果在当今看来非常有前途,因为它们为机器学习技术的发展提供了新的定性和定量机会的途径。重要的是,除了IBM本身之外,TJ Watson研究中心专家的联合开发很可能会成为Google和其他IT巨头的关注焦点,他们已经进入了长期争夺首先限制人工智能功能的权利的长期竞赛。反过来,这也将成为在商业产品级别上快速引入技术的另一种强大动力。来源技术可行性(pdf)

亲爱的读者,我们很高兴在博客页面上见面并等待您。我们准备继续与您分享最新新闻,评论材料和其他出版物,并会尽力使与我们一起度过的时间对您有用。并且,当然,不要忘记订阅我们的专栏文章。我们的其他文章和事件 Source: https://habr.com/ru/post/zh-CN392285/

All Articles