让我在5-10分钟的阅读和理解短篇文章的简历中添加“机器学习”和“神经网络”这两个字吗? 对于那些远离编程的人,我将消除关于AI的复杂性的所有神话,并表明大多数有关机器学习的项目都是基于极其简单的原理构建的。 走吧-我们只有五分钟。

考虑一下神经网络最基本的例子-感知器; 在这个例子中,我自己才完全意识到神经网络是如何工作的,因此,如果我不搞乱的话,您就可以理解。 记住:这里没有魔术,高中五年级的简单数学。

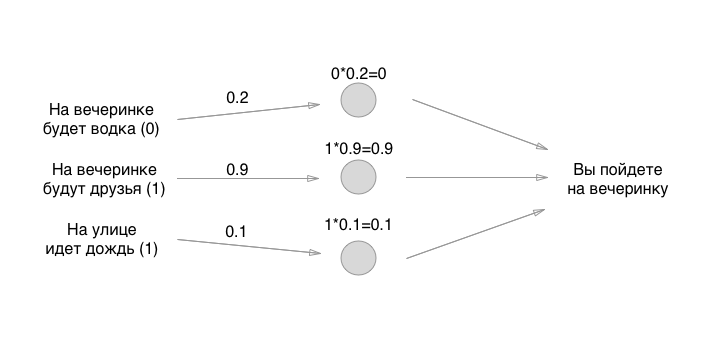

假设我们有三种不同的二进制条件(是或否)和一个二进制解(输出是(是或否)):

具有三个输入和一个输出的简单模型。 该模型可以对不同的人完美地工作,并根据他们对神经网络的训练方式为他们提供不同的结果。 但是什么是神经网络? 这些只是单独的块-神经元相互连接。 让我们从三个神经元创建一个简单的神经元:

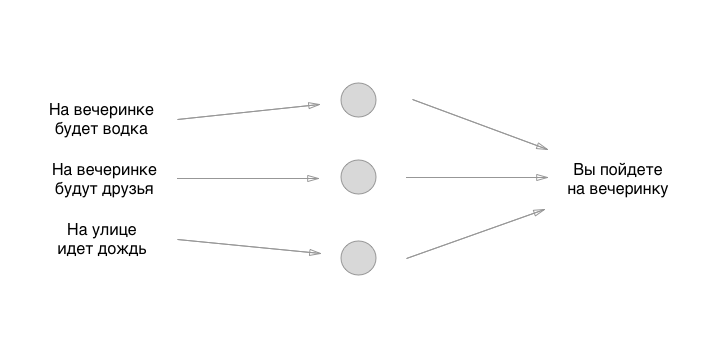

您在输入和输出之间看到的是神经元。 到目前为止,它们与任何事物都没有任何联系,但这也反映了它们的主要特征,每个人都忘了谈论:它们是一个完全抽象的shnyag。 也就是说,神经元本身根本不解决任何问题,而是决定了我们接下来将要绘制的内容。 同时,请记住:除了简化和简化人类的概念外,神经元对神经元完全不起作用。 让我们画出神经元最重要的部分-连接:

哇,听起来很酷。 现在,我们将添加一些魔术,我们将以某种方式用左脚跟训练神经元,扭动,大笑,将胡椒粉洒在我们后邻居的右肩上,一切都会起作用,对吗? 事实证明,这仍然更容易。

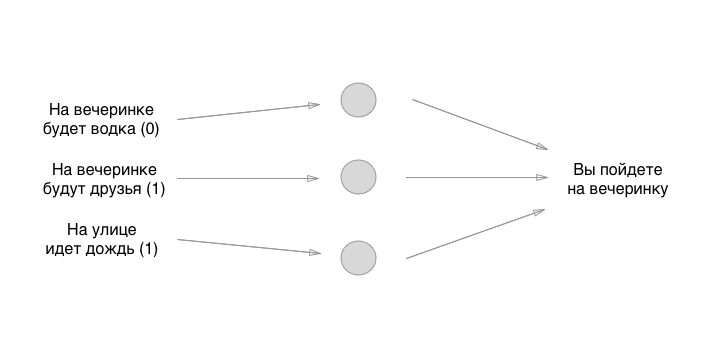

左侧的每个输入都有一个值:0或1,是或否。 让我们将这些值添加到输入中,假设聚会上没有伏特加酒,会有朋友,请下雨:

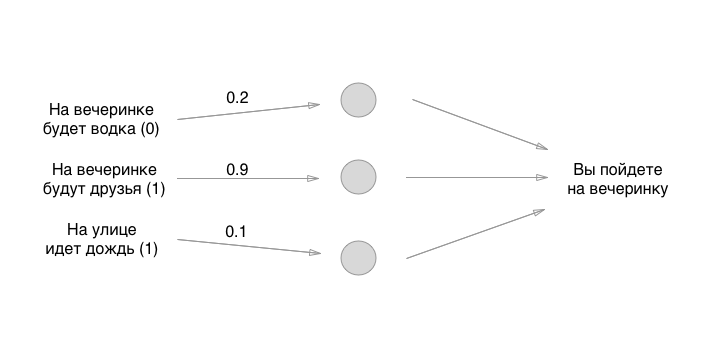

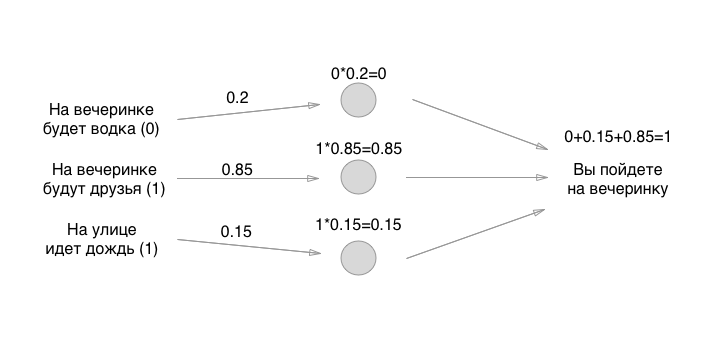

所以,我们弄清楚了。 接下来我们要做什么? 这很有趣:让我们使用最古老的方法来设置神经元的初始状态-大随机性:

我们设置的数字是债券的权重。 还记得神经元是废话吗? 因此,通信正是神经网络的组成部分。 但是债券的权重是多少? 这些就是我们乘以输入值并将它们临时存储在空的神经元中的东西。 我们实际上并没有存储它,但是为了方便起见,我们将想象可以在神经元中放入一些东西:

你喜欢数学吗? 可以繁殖吗? 等一下,最困难的部分才刚刚开始! 接下来,我们添加值(在一种感知器实现中):

好吧,就是这样! 神经元已创建,您可以将其用于任何需要。 如果金额超过0.5,则需要参加聚会。 如果少于或等于,则无需参加聚会。 感谢您的关注!

当然,以上模型几乎没有实际好处,我们需要对其进行训练。 令人恐惧的“训练神经元”不是吗? 不是那样的 一切都变得笨拙且尽可能简单:您获取随机输入数据(如我们所做的那样),通过这三个神经元运行输入,查看答案-使其肯定(参加聚会)-并检查神经元是否正确预测了答案。 如果正确,则什么也不做。 如果错了,您可以将神经元的权重(一次或一次全部)向任意方向稍微移动。 例如,像这样:

然后您再次检查:哦,好吧,当我不想去那里时,他又说去参加聚会! 然后,您再次稍微移动权重(最有可能朝同一方向),然后再次将输入数据通过神经元传递,并再次比较结果-要么不加权重要么再次移动它们。 数万亿次,万亿次,以及各种不同的输入数据。 当然,在这里,我们只有8个输入组合,但是有不同的任务(下面将详细介绍)。

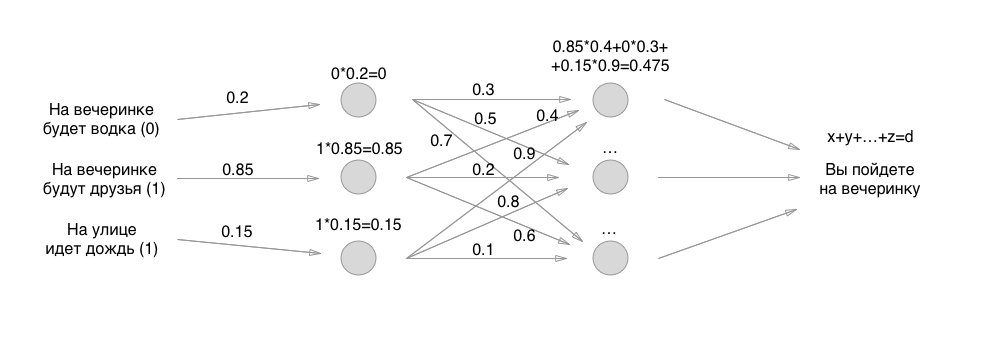

这是神经网络工作的主要原理-乘法对于微分是必要的,对感知器工作的理解对于创建卷积网络,递归神经元,甚至某些奇异的游戏也是必要的。

结果,在根据一个人的决定训练了一个神经元之后,经过了数十亿次的遍历,遍历了所有可能的神经元权重,您最终将到达一个黄金的最佳中间位置,以便一个人输入三个初始值-机器将其运行通过具有三个神经元的稳定且有效的公式,并给出了答案。

我们中仅有的三个未知数是神经元连接的权重,而正是这些未知数使我们得以克服。 因此,我说神经元是无法解决任何问题的假人,而宴会之王就是联系的重物。

这样,一切就变得简单了:我们不做一层神经元,而是做两层,然后再次按照完全相同的原理对所有事物进行排序,只有所有神经元已经为其他神经元赋予了价值。 如果起初我们只有3个连接,那么现在有权重的3 + 9个连接。 然后是固定在自己身上的三层,四层递归层,例如游戏:

但是,他们说,问我,神经元复杂的结果是什么? 为何机器学习专家的薪水会很高? 而这正是如何实现上述感知器的事情:有太多不同的细微差别要列出来。

如果在入口处有图片并且您需要对猫和猫的所有图片进行分类怎么办? 图片尺寸为512x512,每个像素都是一个输入-那么我们将沿着神经元追逐多少个值? 有卷积神经元! 例如,这种shagaaga相隔9个像素,并对它们的RGB值求平均值。 事实证明,压缩图片以进行更快的处理。 或者,例如,完全消除图片中的红色,因为它并不重要(例如,我们仅查看绿色和蓝色的衣服)。 这些是卷积网络-输入处的附加“神经元”层,用于处理对于网络清晰可见的视图的输入。

您还需要了解权重移动的方向和方向-有各种各样的简单算法可以理解,它们从头开始考虑误差-从右(从结果)到左(在神经元的第一层)-其中一种算法称为反向传播。

有各种各样该死的简单算法来标准化值-这样一来,输出时或加法运算时,得到的数字不是0到500 000,而是0到1。它极大地简化了计算和计算数学。

正如您已经了解的那样,非常出色的机器学习专家不仅了解构建优化的神经网络的大多数现有方法,而且还提出了自己的方法,从最简单但最深入的了解如何构建感知器之间的因果关系开始,以及它在数学上的作用。 他们不仅可以使神经元正常工作,还可以更改算法或使用其他算法来快速,最佳地运行。

好了,仅此而已-我为您提供了了解神经网络的基础。 我也希望向您展示,魔鬼并不像他画的那么可怕-在乘法和加法的层面上,一切都变得非常简单。 然后,我建议您开始在YouTube或Udemy上观看教程-帅哥真棒,可以解释所有很酷的内容。

下次,当他们要求您为一个机器学习项目付费时,请以神经网络的工作大纲将乞from从乞shake中摇摇欲坠-哪一层,如何组织,为什么和为什么,这里是,没有。 在最多11个类的级别上,所有这些都是(这是关于积分和微分的)-然后在描述中将发生一次,也许是两次。 尽管该项目没有此模型(什么层以及如何定位),但该项目没有产品,因为这种结构是机器学习专家的最初2-4周。

PS,作为一个解释的例子,我毫不客气地从

一个关于神经网络的

宏伟视频中提取。 我强烈建议您看看-谢谢大家! 订户帮助将链接恢复到原始视频,我曾尝试从内存中恢复该视频的示例。 如果有人对如何编写上面的任务感兴趣,那么我邀请您在这里观看此视频。 非常感谢作者!