其中一个画笔用于删除/添加树木,另一个画笔用于删除人,等等。生成竞争网络(GAN)可以创建令人惊叹的逼真的图像,通常与真实图像没有区别。 自2014年发明此类网络以来,在该领域已进行了大量研究,并创建了许多应用程序,包括

图像处理和

视频预测 。 已经开发了几种GAN变体,并且正在进行实验。

尽管取得了巨大的成功,但仍然存在许多问题。 目前尚不清楚造成这种极其不现实的人工产物的确切原因是什么,生成特定对象所需的知识最少,为什么一个GAN变体比另一个变体更好,为什么在其尺度上编码了哪些基本差异? 为了更好地了解GAN的内部工作原理,麻省理工学院,MIT-IBM Watson AI和IBM Research的研究人员开发了GANDissection框架和

GANpaint程序,该程序是生成对抗网络上的图形编辑器。

这项工作还附有

科学文章 ,详细解释了框架的功能并讨论了研究人员试图寻找答案的问题。 特别是,他们正在尝试研究生成性竞争网络的

内部表示 。 “用于在单位,对象和场景的级别上可视化和理解GAN的分析结构”,即GANDissection框架,应该会有所帮助。

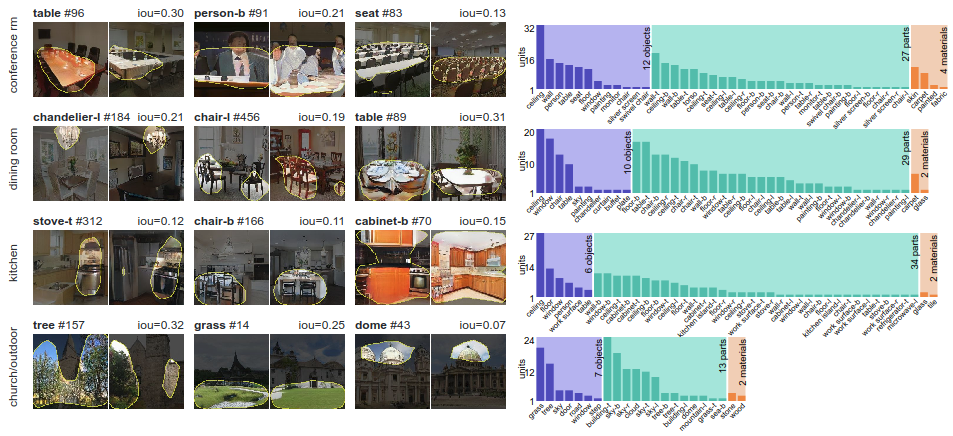

通过将图片划分为多个部分的方法(基于分段的网络解剖),系统可以确定与对象概念密切相关的“解释单元”组。 然后,对引起解释的单位发生变化的原因进行定量评估。 “通过测量干预措施控制出口处物体的能力来完成”。 简而言之,研究人员通过将检测到的物体引入新图像中来研究特定物体与其环境之间的上下文关系。

GAN Dissection框架证明了GAN中特定的神经元是根据他正在学习绘制的场景类型进行训练的:例如,学习会议室时出现夹克神经元,而绘制厨房时出现板状神经元。

GAN Dissection框架证明了GAN中特定的神经元是根据他正在学习绘制的场景类型进行训练的:例如,学习会议室时出现夹克神经元,而绘制厨房时出现板状神经元。为了确保神经元集控制对象的绘制,而不仅仅是关联,框架会介入网络并直接激活和停用神经元。 这就是图形编辑器GANpaint的工作方式-这是分析框架的直观展示。

GANpaint可激活和停用经过训练可创建图像的网络中的神经元。 左侧面板上的每个按钮对应一组20个神经元。 只有七个按钮:

GANpaint可以添加或删除此类对象。

通过直接切换神经元,您可以观察到神经网络已学会建模的视觉世界的结构。

在研究其他生成竞争性网络的工作结果时,局外人可能会问一个问题:GAN是否真的在创建新图像,还是仅由训练中遇到的物体组成一个场景? 也许网络只是记住图像,然后以相同的方式播放它们? 这组作者说,这项研究工作和GANpaint编辑器表明,网络确实了解了组成的某些方面。

一个有趣的发现是,即使对象的最终外观变化很大,相同的神经元也会在不同的上下文中控制特定类别的对象。 相同的神经元可以切换到“门”的概念,而无论您是需要在大石墙上添加重型门还是在小木屋上添加小门。 GAN还了解何时以及何时无法创建对象。 例如,当门神经元被激活时,门确实会出现在建筑物的正确位置。 但是,如果您在天空或树木上进行相同操作,则通常这样的尝试将无效。

科学文章

“ GAN解剖:可视化和理解生成的对抗网络”已于 2018年11月26日在预印本网站arXiv.org(arXiv:1811.10597v2)上发布。

交互式演示,视频,代码和数据

在Github和

MIT网站上

发布 。