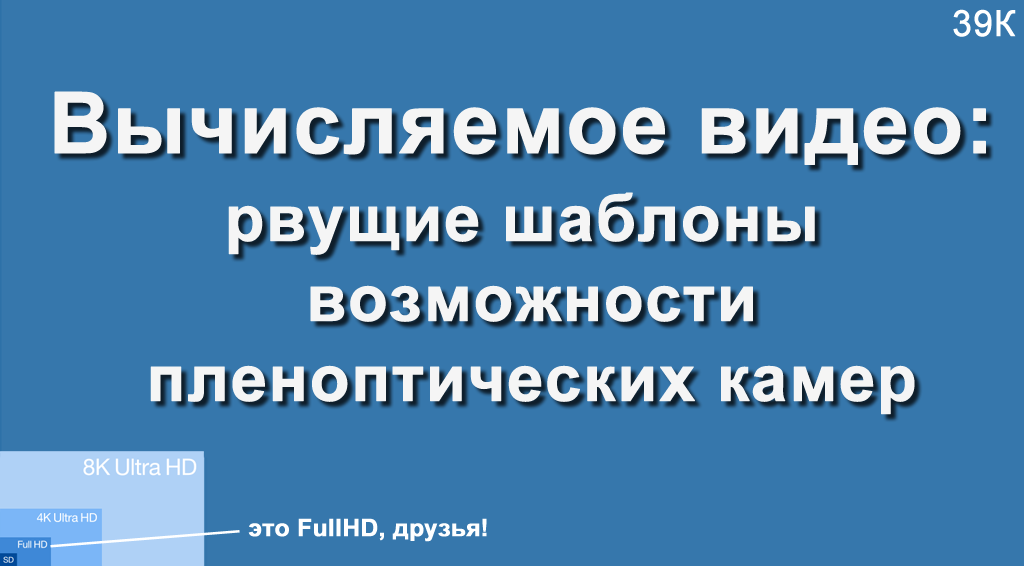

前段时间,作者有机会在VGIK上发表演讲,观众中有很多人来自摄影棚。 观众被问到:“您以什么最大分辨率拍摄?”,事实证明,大约有三分之一拍摄4K或8百万像素,其余的-不超过2K或2百万像素。 这是一个挑战! 我不得不说说这款相机的分辨率为755兆像素(准确地说,是原始分辨率,因为它具有最终的4K分辨率),这对于专业拍摄有什么迷人的可能性。

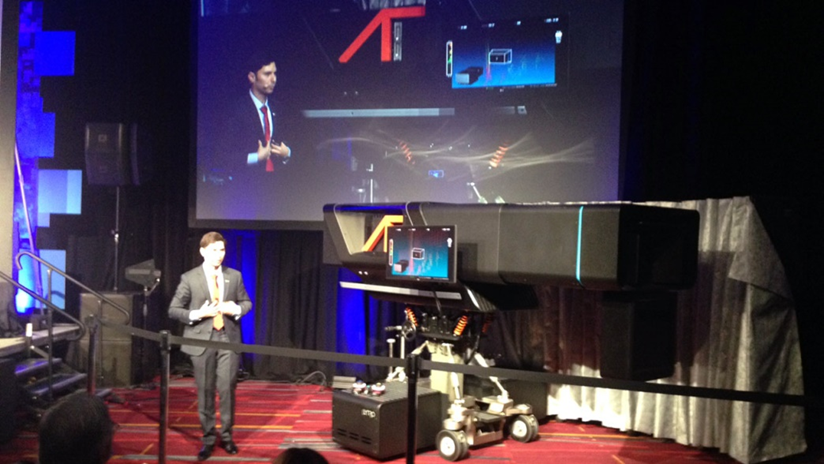

相机本身看起来像这样(一种小象):

此外,我要公开一个可怕的秘密,为了拍摄这张照片,我们正在寻找一个更好的角度和一个更大的人。 我碰巧觉得这台相机是实时的,我会说它看起来更大了。 下图与Yon Karafin在一起,与我们处于同一高度,更准确地反映了灾难的规模:

谁会原则上关心他们很少写的计算视频的功能-整个事实都被削减了! )

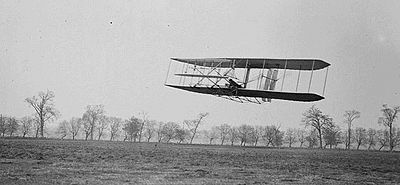

有关全光可能性的讨论使我想起了有关第一架飞机的讨论:

人们怎么说:

-

非常昂贵...-

是的!-

这是完全不切实际的,现在还不成功...-

是的!-

使用有危险...-

该死,是的!-

看起来很可悲!-

该死,是的,但是飞了,你看,LE-TA-ET !!!

50年后,这些实验带来了一种全新的,便捷且相当安全的跨大洋移动方式(不仅是)。

这里的情况是一样的。 绝对一样! 现在它需要不合理的成本,该死的使用不便,看起来很糟糕,但这确实是在飞! 并且要了解原则和新兴前景-这简直是令人难以置信的鼓舞(至少是您卑微的仆人)!

上图中的怪物有点让人想起第一批相机,它们也很大,有一个巨大的镜头,并在一个特殊的框架上旋转:

资料来源: 1936年奥运会刚开播时,电视的奥运拍摄

资料来源: 1936年奥运会刚开播时,电视的奥运拍摄这里看起来很像,也是一个巨大的镜头(因为光线不足),一台带有特殊悬挂装置的笨重相机,巨大尺寸:

资料来源: Lytro准备永远改变电影制作

资料来源: Lytro准备永远改变电影制作有趣的是:下面的“手提箱”是一个液体冷却系统,万一发生故障,相机将无法进一步拍照。

镜头下方的大矩形(在上面的第一张照片中清晰可见)不是背光,而是激光雷达-激光测距仪,可在相机前面提供三维场景。

背景左下角的厚黑色止血带是一束直径约4厘米的光缆,摄像机通过该光缆将巨大的信息流发送到特殊的存储装置。

主题中的人们已经认识到

Lytro Cinema ,其中3件作品被创作出来。 第一个通常出现在所有图片中,很容易被镜头下方的一个

激光雷达识别。 1.5年后,创建了第二个腔室,纠正了第一个和两个激光雷达的结构问题(可惜,几乎没有人写过)。 而且,例如,激光雷达在1.5年内的发展进步是如此之大,以至于第二个腔室的两个激光雷达给出的点数是第一个腔室的一个激光雷达的十倍。 假定第三台相机具有大致相同的分辨率特性(以满足电影制片人的要求),但尺寸仅为其一半(这对实际使用至关重要)。 但是...但是稍后会更多。

无论如何,我想以各种方式认识到Lytro在普及

全光拍摄技术中所发挥的杰出作用,我想指出,光线并没有在其上会聚。 全光相机生产商

雷特里克斯(Raytrix)的

弗劳恩霍夫研究所 (

Fraunhofer Institute)安全地制造了一台类似的相机,再次不允许我拍摄Lytro Cinema,因为我非常担心有几家中国公司正在朝这个方向积极开展工作(我找不到关于它们的新信息)。

因此,让我们写下全光镜所提供的所有优点,以及它们几乎没有写的优点。 但是正因为如此,它才能保证成功。

而不是介绍

仅在哈布雷(Habré)上,并且

在大约300页上仅提及Lytro,因此我们将做简短介绍。

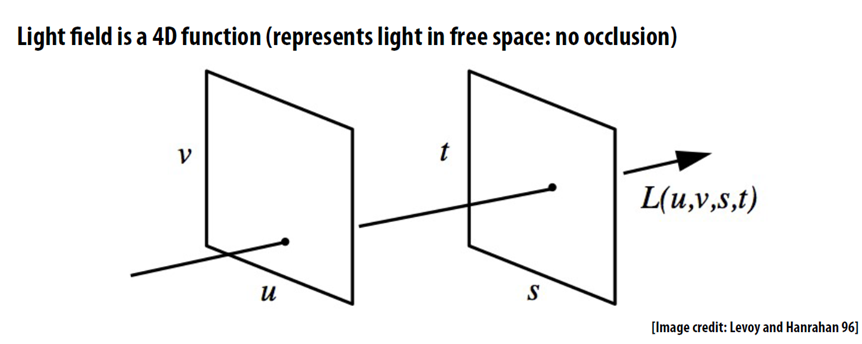

全光拍摄的关键概念是光场,即我们不固定每个点的像素颜色,而是固定一个二维像素矩阵,将一个痛苦的二维帧变成一个正常的四维帧(到目前为止,通常在t和s上分辨率很小):

在

英语维基百科中 ,

然后在俄语中有关光场的文章中,都说“光场”这个短语“是

A. Gershun在1936年使用

的 。” 公平地说,我们注意到这不是

偶然的 “惯用语”,而是一

本 178页的

小书的名字,称为“光场”:

甚至在那时,这些作品还是在自然界中得到了广泛应用,并且在6年后的1942年战争最激烈的时期,作者以中断方法获得了第二度的斯大林奖。

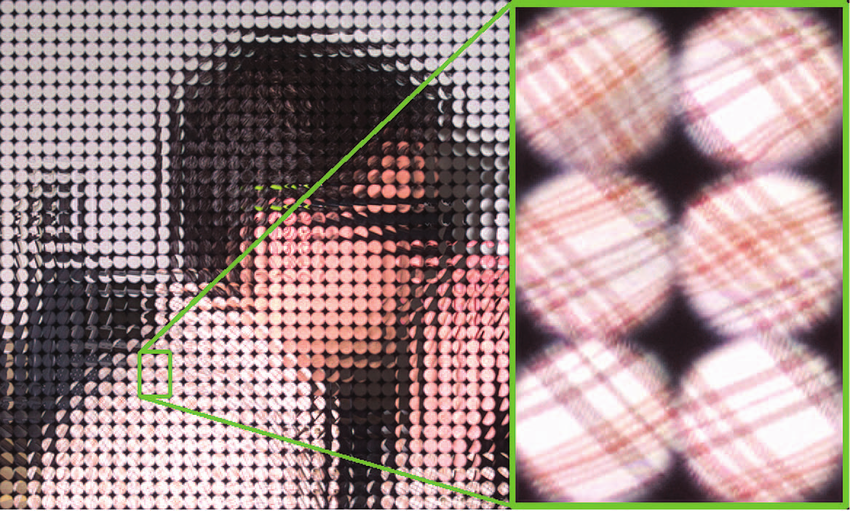

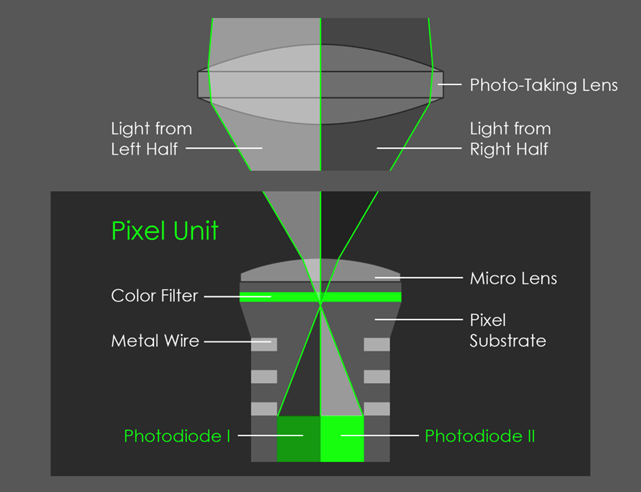

实际上,拍摄光场的四维框架会在相机传感器的前面提供一系列微透镜:

来源: plenoptic.inf®(您可以单击并以完整分辨率查看)

来源: plenoptic.inf®(您可以单击并以完整分辨率查看)实际上,正是因为我们有一个微透镜阵列,它们之间的距离很小,才有可能创建Lytro Cinema,其传感器由边界位于透镜边界上的传感器阵列组装而成。 需要液体冷却以冷却非常热的地块。

来源: 使用聚焦全光相机进行丰富的图像捕获

来源: 使用聚焦全光相机进行丰富的图像捕获结果,我们得到了最著名的全光相机的可能性,只有懒惰者才写过-在拍摄后改变聚焦距离(这些可爱的小鸟不会等待聚焦):

资料来源:Lytro

资料来源:Lytro几乎没有关于全光如何以适合电影的分辨率(单击即可打开)的外观写的:

资料来源: 永远观看Lytro更改摄影

资料来源: 永远观看Lytro更改摄影我要揭开另一个秘密:计算得出的焦点是整个全景的冰山一角。 在我看来,仍然低于记者兴趣水平的90%的机会更加有趣。 他们中的许多人都值得写单独的文章,但至少让我们纠正不公正之处,至少给他们打电话。 走吧

计算的光圈形状

由于我们在谈论散焦,因此值得一提的是所谓的

散景效果 ,其中眩光不一定是圆形的

对于摄影师来说,

发布了所谓的

散景套件 ,它可以使您获得各种形状的眩光:

这使您可以获得漂亮的图片,下面的照片清楚地表明,心形的火花甚至在前景中都有石头,只有心形较小。 很明显,在Photoshop中尝试以类似方式自然模糊非常困难,至少建议使用深度图:

同时,让全光“计算”一个不同的光圈是一个相对容易的任务:

这样啊 我们计算了聚焦距离,计算了光圈的形状,走得更远,在这里更有趣!

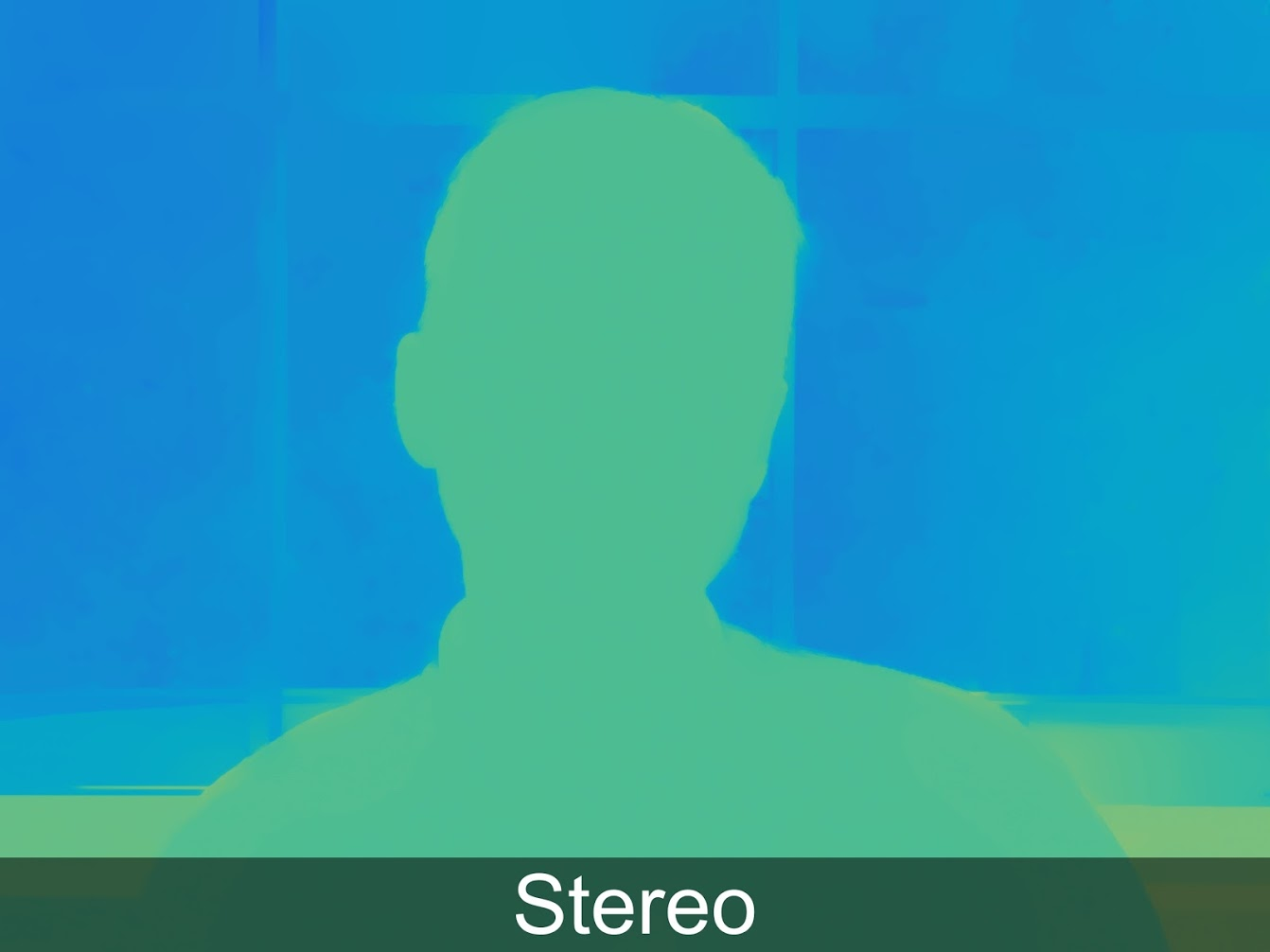

计算立体声

全光传感器的一个非常有用的功能是能够从不同的点计算图像,几乎没有人提到它,但是已经赋予它第二次生命。 该点的位置实际上取决于镜头的大小。 如果镜头较小,则框可能会左右稍微偏移,如本例所示(如果您看最近鸟的胸部,则可以看到此立体照片):

资料来源:Lytro

资料来源:Lytro如果镜头较大,例如Lytro Cinema,则拍摄点可以移动10厘米。 让我提醒您,我们的眼睛之间大约有6.5厘米,即最大距离为10厘米,您可以拍摄总体平面图(与您用眼睛看相比,它将是“三维”)和特写镜头(任何视差而不会不适)。 实际上,这意味着我们可以用一个镜头拍摄完整的立体声视频。 而且,它不仅将是立体声,而且将是具有完美音质的立体声,并且今天听起来很棒-拍摄后虚拟相机的光轴之间的距离可变。 这两者以及另一个-绝对不可思议的机会,这些机会将来可能会在将来拍摄立体声音响时改变情况。

由于未来在某种程度上可以进行三维拍摄,因此让我们更详细地介绍这两点。 如今,绝大部分的3D电影(尤其是大片)都没有被删除而是转换为3D,这已不是什么秘密。 这样做是因为拍摄时会出现一长串问题(以下是列表的一部分):

- 这些帧可以旋转,垂直移动或相对于另一个放大 (不要说这很容易固定,请参阅此类帧进入电影发行版的频率-这是一种安静的恐怖……令人头疼)。 因此,即使操作员决定放大平面图,全光立体声也会完美对齐(由于两个摄像头的机械原理,很难使逼近严格同步)。

- 相框的颜色可能会有所不同 ,尤其是在拍摄时要求相机的光轴之间的距离很小并且您必须使用分束器时(有关于此的详细文章 )。 事实证明,在拍摄任何耀斑物体(晴天的背景中的汽车)的情况下,我们注定要在后期制作中使用绝大多数相机进行娱乐,而在全光下,我们将获得具有任何眩光的完美图像。 这是个假期!

- 镜架的清晰度可能会有所不同 -再次是分束器中的一个明显问题,全光镜中完全没有。 在需要什么锐度的情况下,我们将从角度计算绝对完美。

- 帧会及时浮动 。 与斯大林格勒材料合作的同事讨论了轨道时间戳之间4帧之间的差异,这就是为什么饼干仍然有用的原因。 我们在105部电影中发现了500多个具有时差的场景。 不幸的是,时间差很难检测到,尤其是在慢动作场景中,同时根据我们的测量,这也是最痛苦的伪影。 在全光的情况下,我们将实现完美的时间同步。

- 拍摄3D时的另一个头痛是视差太大,当在大屏幕上观看时,视线会向两侧转向“无限远”以外的物体,或者对于某些前景物体会聚, 从而导致不适 。 正确的视差计算是操作员应该有一个很好的命令的单独的困难主题,并且意外进入镜框的物体可能会破坏拍摄效果,使其不舒服。 对于全光,我们自己选择拍摄后的视差,因此任何场景都可以使用PERFECT视差进行计算,此外,对于大屏幕和小屏幕,可以轻松计算出相同的已拍摄场景。 这就是所谓的视差更改,在不损失质量的情况下通常非常困难且昂贵,尤其是在前景中具有半透明物体或边框的情况下。

通常,计算完美立体声的能力是下一波3D普及浪潮的真正基础,因为在过去的100年中5浪已被区分。 而且,从激光投影和全光技术的进步来看,最多10年(当Lytro的主要专利到期或在中国更早时)正等着我们使用新的铁杆和更高水平的高质量3D胶片。

这样啊 他们从一个镜头获得了完美的计算立体声(顺便说一下,这对于大多数人来说是不可能的)。 他们不仅得到了它,而且在事后重新计算了视差,即使对象在前景中没有聚焦。 让我们更深入!

计算的射击点

更改拍摄点在普通2D视频中具有应用。

如果您在场景中或至少看过照片,则可能要注意相机旅行的轨道。 通常对于一个场景,您需要将它们放置在多个方向上,这需要花费大量时间。 滑轨可确保摄像机平稳运行。 是的,当然有一个

稳定器 ,但是在很多情况下,铁轨别无选择。

在Lytro中更改拍摄点的功能用于证明有足够的车轮。 实际上,当摄像机移动时,我们会形成一个直径为10厘米的虚拟“管”,在其中可以更改拍摄点。 而且,该管道可以补偿较小的波动。 该视频很好地展示了这一点:

此外,有时您需要解决反问题,即在运动过程中增加振动。 例如,没有足够的动力,导演决定爆炸。 施加声音的时间不长,但建议同步摇动相机,最好不仅将照片平移,使其可见,而且要“诚实”摇动。 使用全光镜,可以完全“诚实地”晃动拍摄点-改变拍摄点,角度,运动模糊等。 会有一种完全的错觉,那就是相机剧烈晃动,轻轻,安全地骑在车轮上。 同意-一个了不起的机会! 下一代替身将显示奇迹。

当然,要使其成为现实,您需要等到全光摄像机的尺寸减小到合理的水平。 但是考虑到在微型化和提高智能手机和平板电脑传感器分辨率方面投入了多少钱,看来等待时间并不长。 并且有可能创建一个新的全光相机! 每年,它变得越来越容易。

这样啊 计算了拍摄点,并在必要时移动,稳定或不稳定了相机。 让我们走的更远!

计算照明

由于我们正在谈论附近的爆炸...

有时有必要改变主体的照明,例如,现实地增加闪光灯。 后期制作工作室很清楚这是一个困难的问题,即使我们角色的服装相对简单。

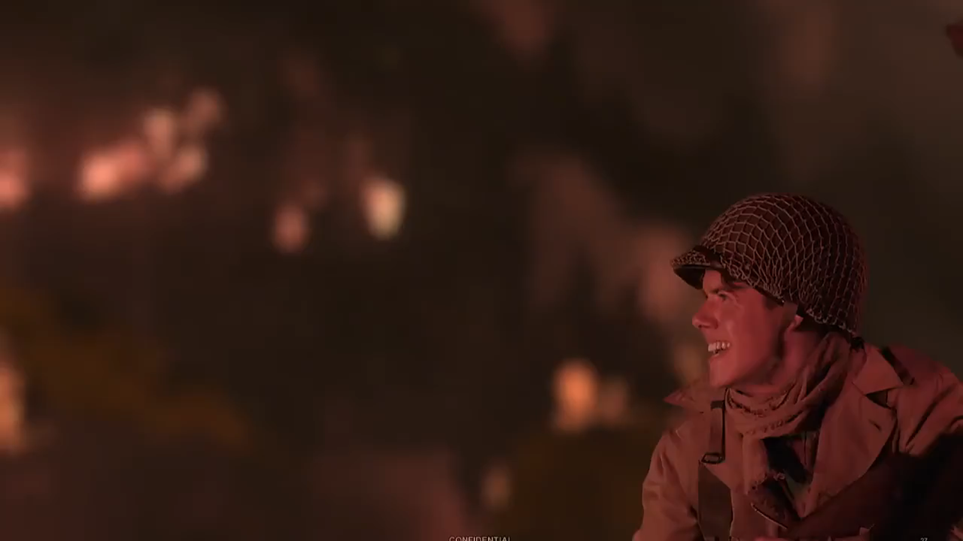

这是一个带有Flash叠加层的视频示例,其中考虑了衣服,阴影等(点击即可打开):

资料来源: Yon Karafin访谈

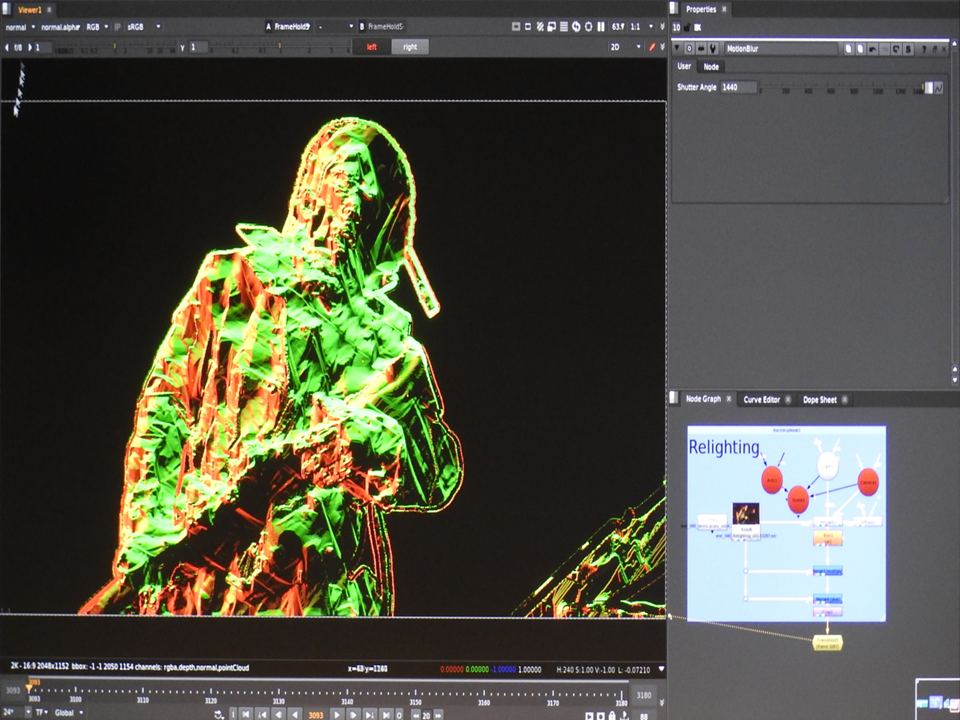

资料来源: Yon Karafin访谈在引擎盖下,它看起来像是Nuke的插件,可以与演员的完整三维模型配合使用,并在考虑到法线贴图,材质,运动模糊等情况下为其赋予新的亮点:

资料来源:Lytro Materials

资料来源:Lytro Materials这样啊 计算已经捕获的对象的新照明。 让我们走的更远!

计算分辨率

那些尝试过第一款Lytro的人经常会注意到-是的,玩具很酷,但是分辨率完全不足以进行普通摄影。

在

上一篇有关Habr的

文章中,描述了拍摄点的微小偏移如何有助于显着提高分辨率。 问题:这些算法是否适用于全光? 答:可以! 此外,由于具有深度图,所有像素均一次拍摄,因此超分辨率算法更容易在全光图像上工作,并且可以非常准确地知道偏移。 也就是说,与超分辨率算法在普通2D模式下工作的条件相比,全光情况简直是不可思议的。 结果是对应的:

来源:来自Adobe技术报告“使用Plenoptic Camera 2.0的超分辨率”的天真,智能和超分辨率全光镜框恢复

来源:来自Adobe技术报告“使用Plenoptic Camera 2.0的超分辨率”的天真,智能和超分辨率全光镜框恢复唯一的主要问题(真的很大!)是所需的数据量和计算量。 尽管如此,今天在晚上加载计算场并在明天需要的地方获得两倍的分辨率是完全现实的。

所以-找出计算出的分辨率! 让我们走的更远!

计算环境

在后期制作阶段,尤其是在某种奇幻或奇幻项目中,产生的另一个任务是将捕获的对象小心地粘贴到三维场景中。 在全球范围内没有大问题。 今天的规范是对拍摄区域进行三维扫描,剩下的就是仔细地将拍摄模型和三维场景结合起来,这样当演员的腿有时掉入漆成的不平坦地板上时,就不会出现这种流派的经典作品(这种门框在小屏幕上不是很明显,但是可以清楚地看到在电影院,尤其是在IMAX中)。

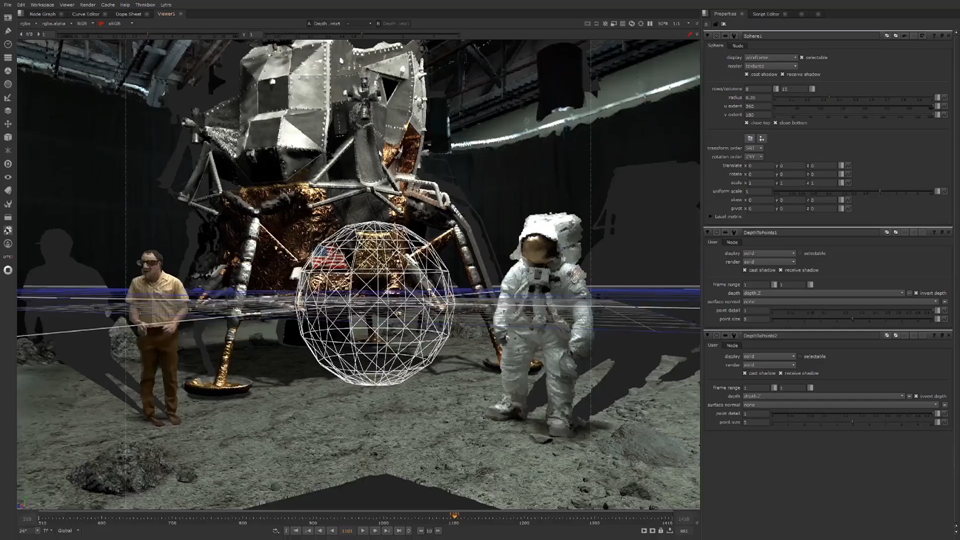

并非没有幽默感,例如,以相机操作为例,使用了拍摄月球着陆的场景(在相机看不到的地方清晰可见“三维阴影”):

资料来源: 月亮| Lytro | VR Playhouse | 光场后期制作

资料来源: 月亮| Lytro | VR Playhouse | 光场后期制作根据定义,由于在全光摄像机中拍摄的是多角度视频,因此构建深度图并不是一个大问题。 而且,如果将相机与激光雷达结合使用,我们将立即拍摄三维场景,从而在下一阶段从根本上简化了真实拍摄和图形的结合。

因此,我们计算了周围的三维场景(结合了激光雷达数据和全光数据)。 现在,您猜对了,月球勘测的渲染效果会更好! 来吧

计算色度键

但这还不是全部!

在应该将计算机背景放置在绿色胶合板护板上或拉动绿色横幅的地方,现代电影通常使用的技术是

绿色屏幕 。 这样做是为了在背景变化时在半透明边界处没有问题。 4 — ( ) .

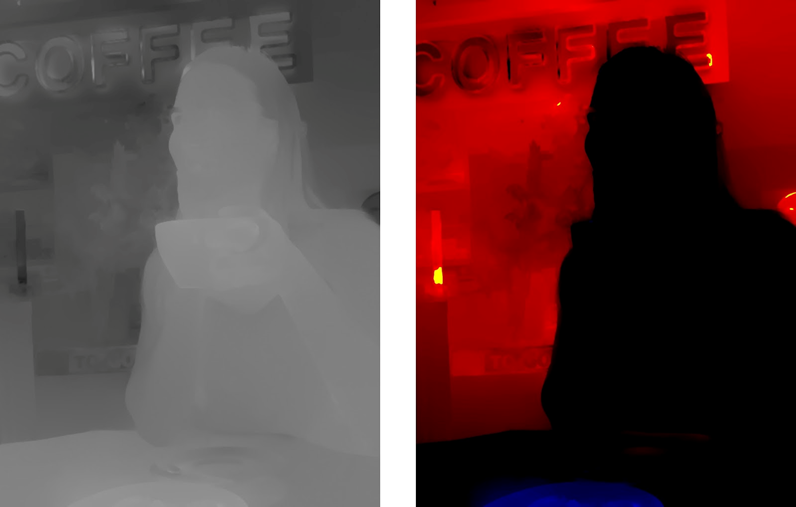

, , , , . , , :

:

: Lytro , (

- — !), ( challenge), , ( , , ):

, ? . , , ( ). ,

.

« », . . , 2D . .

, , !

— . , , , , . , «» .

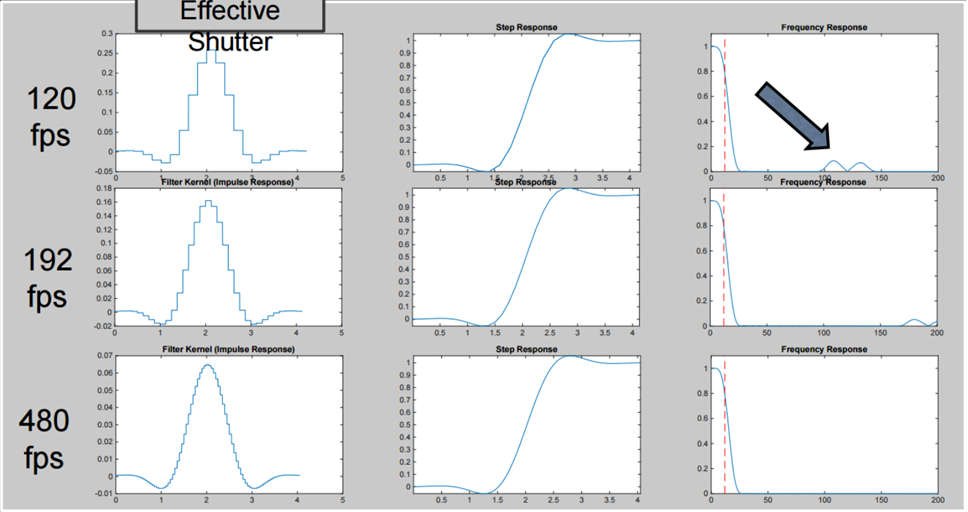

, «» «» , , , , , , ( Lytro Cinema 300 fps, , ):

«» , , , «» «» , ( , , ):

: https://vimeo.com/114743605

: https://vimeo.com/114743605, , :

: https://vimeo.com/114743605

: https://vimeo.com/114743605, . !

通常,在今天进行全光讨论时,通常会以

“老板不见了:灰泥被取走,客户要走了!”的方式进行典型的对话

。 Lytro去年廉价地收购了Google,Pelican Imaging实验并未进入批量生产,总的来说,一切都只是一个美丽的理论...

来源: 鹈鹕成像:20美元的智能手机全光相机模块

来源: 鹈鹕成像:20美元的智能手机全光相机模块所以你去了! 关于全光镜死亡的谣言被大大夸大了。 很强!

相反,目前,全光传感器的生产和使用规模

前所未有 。

臭名昭著的Google公司并没有大张旗鼓地发布带有全光传感器的Google Pixel 2和Google Pixel 3。 如果您看电话,则可以清楚地看到该摄像头有一个摄像头:

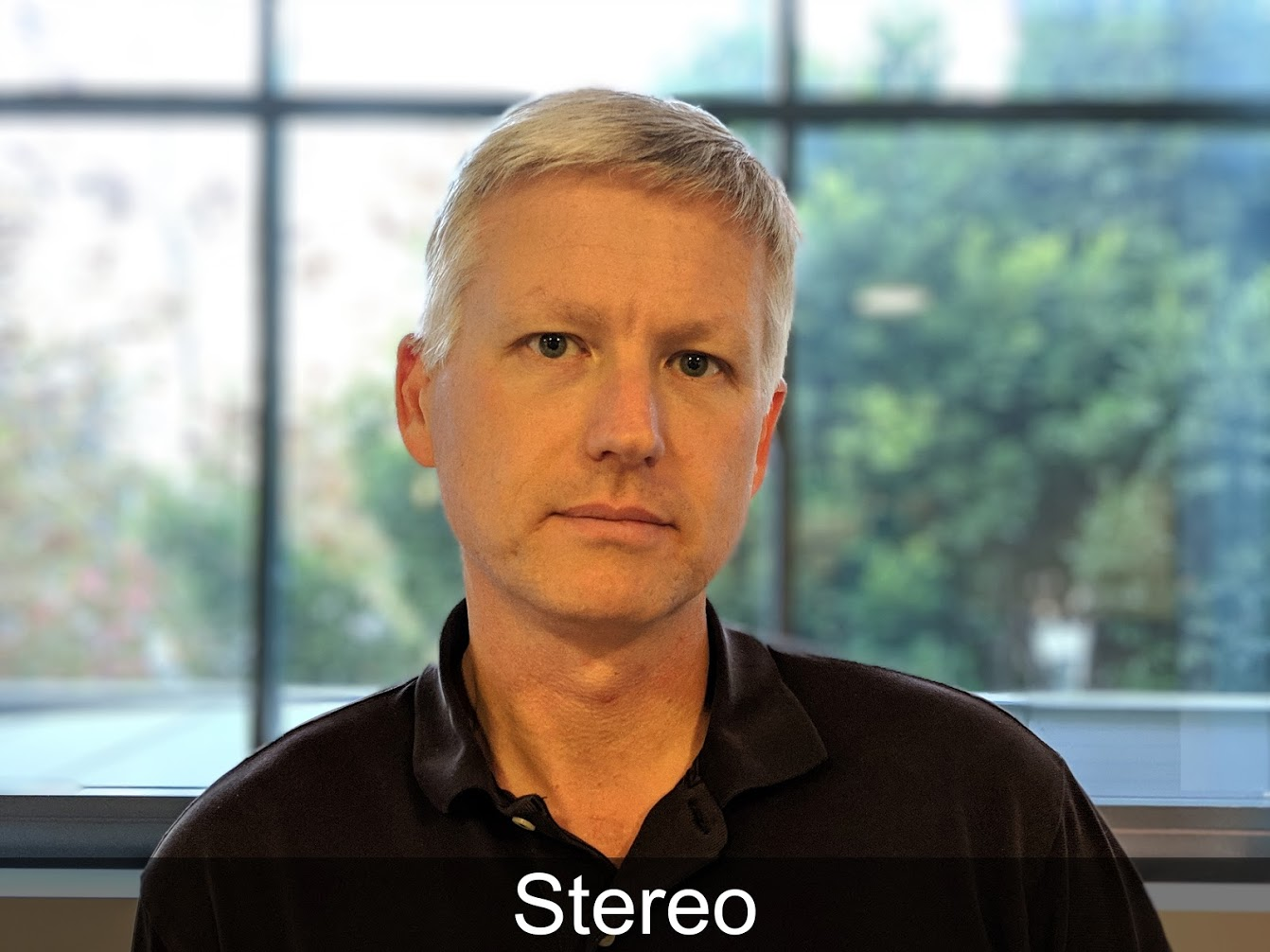

但是,与此同时,手机的背景模糊效果非常好,通常不比其“两眼”,“三眼”和“四眼”同事差(同意以下照片特别受益于此效果):

来源: AI Google Blog(您可以单击以查看较大的尺寸,主要是在前景对象的边框上)

来源: AI Google Blog(您可以单击以查看较大的尺寸,主要是在前景对象的边框上)他们是怎么做到的?

不可思议的奇迹之源正在被使用,这是近来无法避免的-神经网络的非幼稚魔术?

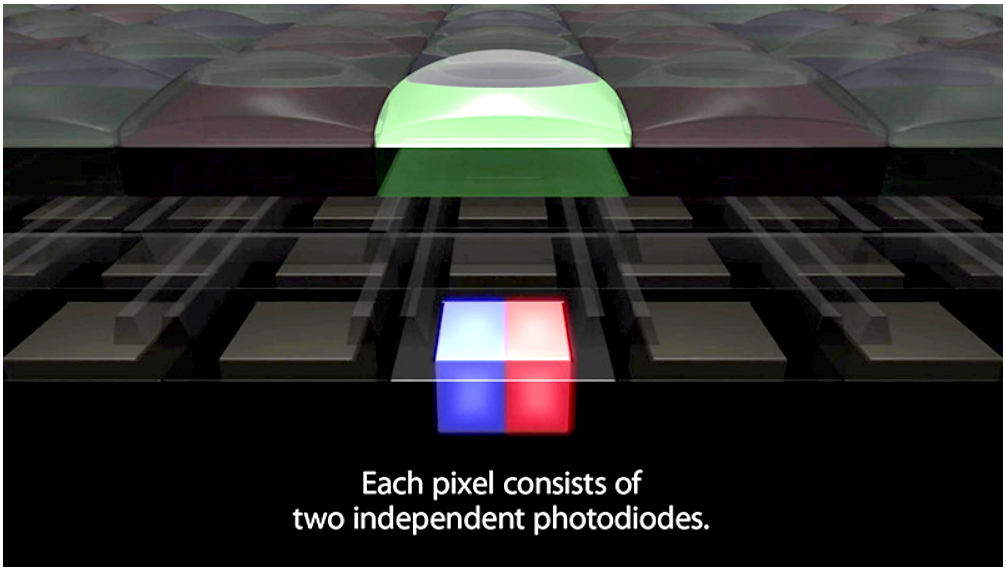

神经网络,尤其是在Pixel 3中,也被积极地用于此任务,但以后会更多。 效果质量的秘诀是,尽管镜头仅覆盖两个像素,但智能手机的传感器还是全光的,如图所示:

资料来源: AI Google Blog

资料来源: AI Google Blog结果,我们得到了一个微立体图片,在运动中可以看到非常轻微的偏移(右边的图片是动画的,并且可以上下移动,因为拍摄时手机是这样握住的):

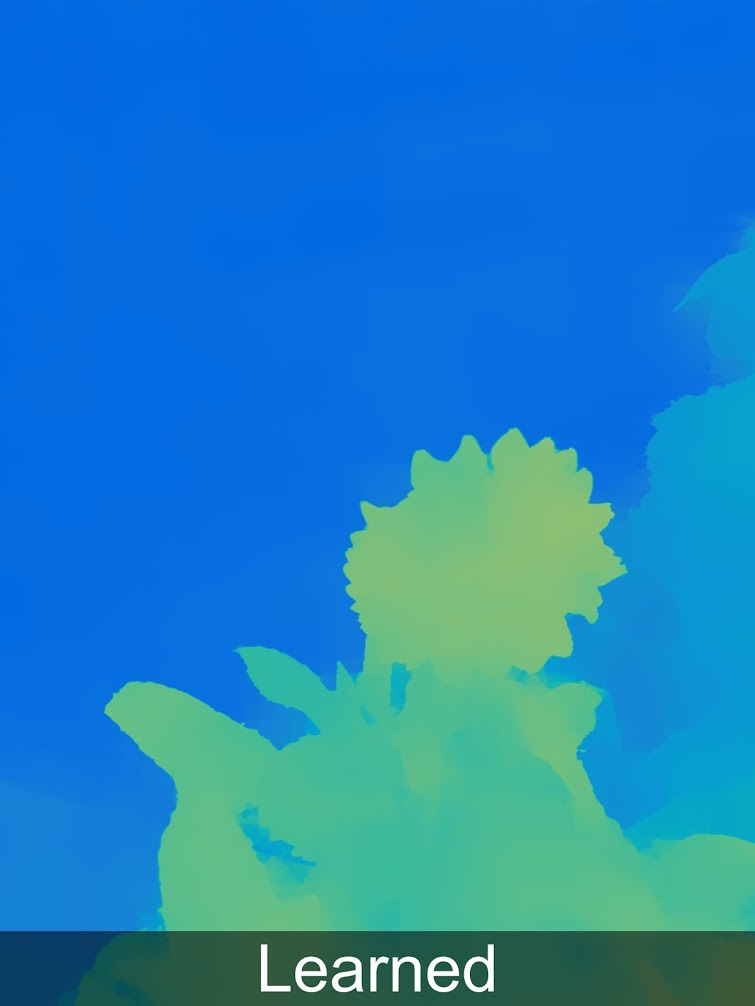

但是,即使这个极小的偏移也足以为正在拍摄的照片建立深度图(关于亚像素偏移的用法已

在上一篇文章中介绍 ):

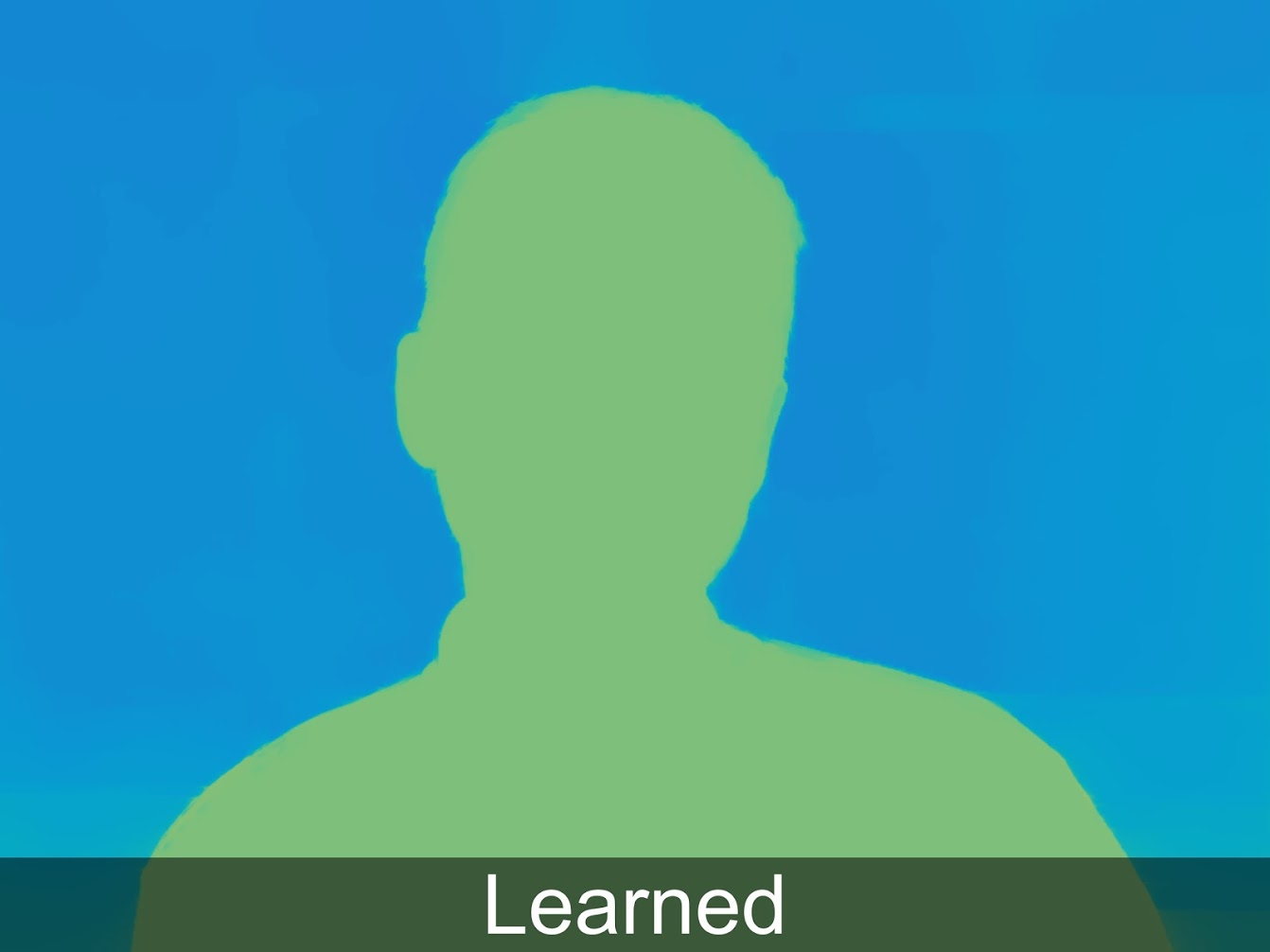

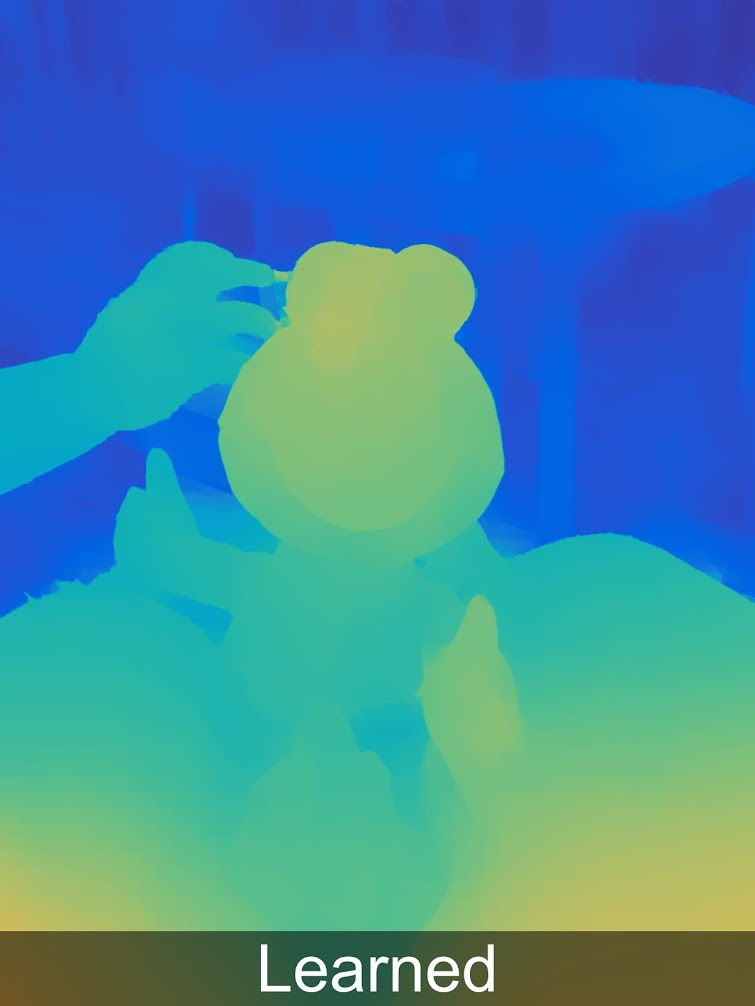

同时,通过使用机器学习,可以显着改善结果,并且已在Pixel 3中实现。在下面的示例中,Learned表示Stereo + Learned,有关此的更多信息,希望还会有单独的文章:

对于那些喜欢以全分辨率观看深度的人,

特殊画廊中有更多示例。

可以清楚地看到,并不是所有的东西都是完美的,并且我们有一些典型的伪像,这些伪像通常用于从立体声生成深度图(顺便说一下,Pixel的两眼同事也可以找到),并且有一点视差影响。 但是,已经很清楚,深度的质量足以自信地按深度分割图像,并进一步施加不同的效果,更加自信地将对象添加到场景中,依此类推。 MEASURED深度的结果比基于各种假设(任意神经网络)的结果好一个数量级。

因此,恭喜所有阅读本文的人! 即使您根本不了解,您仍可以在成功的大众市场产品中发布全光摄像机期间!

当然,故事还没有结束:

- 首先,有趣的是,全光镜几乎是“免费的”,因为在现代智能手机相机中,传感器的小型化和分辨率的提高,导致了光通量的灾难性缺乏,因此每个像素都被微透镜覆盖。 也就是说,这样的传感器并不会花费更多(这非常重要!),尽管我们在某种程度上牺牲了由于另一种技术而刚刚增加的分辨率。 应用两种技术的结果是,结果在2D(更好的噪声,更低的分辨率,HDR)中变得更好,并且同时被测得的深度所补充,也就是3D。 问题的代价是每帧计算数量的急剧增加。 但是对于照片来说,今天已经可以实现,并且已经可以在真正的智能手机中使用。

- 其次,在一次会议上,一位Google员工表示他们正在考虑用一个镜头覆盖4个像素,之后深度图的质量将显着提高,因为将有2个立体声对,其立体基数要大1.4倍(两个对角线),这将大大改善深度图的质量,包括边界处的许多立体文物。 竞争对手只有连续放置至少3台摄像机才能达到这种质量。 这样的质量提高对于AR很重要。

- 第三,谷歌不再孤单,下面是在Vivo V11 Pro中描述类似技术的示例,您看到的,您已经看到了类似的图片:

资料来源: 什么是双像素技术?

资料来源: 什么是双像素技术?全光镜还可用于专业相机的自动对焦,例如,

佳能 (google

DPAF-双像素自动对焦)。 谁会想到30年前的理论笑话-用一个镜头拍摄立体声的能力-将是全光镜的首次大规模应用...

总的来说-话题去了产品!

她已经在飞了! 你看,

LE-TA-ET!

总结一下

电影院的电影光学

上面,我们研究了两种使用全光镜的情况-在电影制作和智能手机中。 这不是一个完整的列表,例如,全光在

显微镜检查中非常重要-您可以制作具有较大“诚实”景深的经

计算的立体显微照片 。 全光与工业相机相关,尤其是在需要拍摄半透明多级物体等的情况下。 但是另一回事。

回想一下用于电影制作的相关内容:

- 计算焦距

- 计算的散景

- 计算分辨率

- 计算完美立体声

- 计算的射击点

- 计算照明

- 计算环境

- 计算的绿屏

- 计算快门

在未来几年中,随着传感器的小型化和分辨率的提高,可以开发出一种技术来创建实用的,根本上是新的电影摄影机,该摄影机可以消除材料以更快地施加特殊效果(没有绿屏)并且花费更少的时间(更容易固定点)。 这些新功能非常有趣,以至于可以将具有合适胶卷分辨率的全光传感器制造得紧凑时,这种相机注定要成功。

这样的相机什么时候出现?在接下来的十年中,将有一个谨慎的答案。

该术语取决于什么?从许多因素来看。 很好的问题:谷歌现在拥有的Lytro专利许可能力会如何? 这可能很关键。 幸运的是,关键成员将在10年后过期(在这里我们没有礼貌地记住可以加快这一过程的Lytro中国同事)。 同样,应该简化由全光摄像机生成的大量数据的工作:对于现代云而言,这变得越来越容易。 好消息是-一次感谢Lytro,在一个

非常流行的作曲程序中 ,该

程序被大量演播室用于立体声处理,因此支持了全光数据格式。 正如他们所说,Lytro死了,但是为Nuke编写支持全光视频的插件的机会仍然存在。 这可以简化使用专业产品进入该市场的过程,因为重要的是,工作室可以立即使用新相机的格式工作,而无需培训人员并按照相同的程序进行操作。

智能手机中的Plenoptika

如果我们谈论智能手机,那么一切看起来都会更好。 与这个行业最相关的是全光相机使用单个传感器(可能很快)测量深度的能力,并且很快将成为一项巨大需求。

这样的相机什么时候出现?已经存在。 明天,其他制造商将重复使用该技术。 此外,下一阶段的关键驱动力将是智能手机和平板电脑上的

增强现实 ,而如今,这些技术缺乏准确性,无法“看到”三维场景。

该术语取决于什么?使用Google Pixel可能很快会出现使用主传感器实时测量距离的功能,因为Google一直在朝着这个方向发展很长时间(请参阅

Project Tango ,该公司已经关闭,但业务仍在继续)。

ARCore以及竞争的

ARKit看起来都非常有前途。 正如您现在所猜测的那样,突破并没有多久等待,因为传感器像素的值呈指数下降,所以他们称10年内平均速度为10倍,而我们需要下降2倍。 然后为自己计数。 不是明天,但不会很久。

而不是结论

还记得吗,一开始我们是在谈论VGIK的讲座? 我必须说,我没想到最终会有什么反应。 一言以蔽之,这是令人哀悼的。 如果用两个词来说,那就普遍哀悼。 一开始我不明白这是怎么回事。 演讲结束后走过来的操作员很好地向我解释了这种情况。 甚至摄影艺术也没有减少。 尽管有一个很好的例子:一个电影片段大约有6秒钟,当一个人接近公寓的门,敲门时,另一个人打开门,招呼并向前移动一点,同时摄像机将焦点对准走廊,然后对准门框,然后立即聚焦在发现它的人身上,然后进入房间。 并且操作员需要完美地掌握相机,以便在类似

电影院的浅景深下熟练

掌握变焦,记住背光,构图框,用手拍摄时晕车以及另外1000件事。 所以在这里。 这甚至都不是那么容易。 这甚至很好。 由于某个地方的操作员没有时间或没有错过任何机会,因此收成更少。 他讲述了最近如何为该频道拍摄4K系列节目。 事实证明,解决方案的存量很大。 结果,导演在后期制作时剪切了帧,在某些地方,仅帧的片段被用于打断。 结果,构图简直糟透了,这位操作员想从学分中删除他的名字。

电影摄制机的上述功能意味着将许多效果从拍摄阶段转移到后期制作阶段。 如果处理镜头的人员在构图,对焦距离控制等方面不识字,那将是极大的悲伤。 如果他们识字,这些都是新的绝佳机会。

因此,我们希望我们所有人都有更多的能力,这在这个瞬息万变的世界中并不总是那么容易!而迦太基将……到本世纪末,所有视频都将是三维的!致谢

我衷心感谢:

- 莫斯科国立大学VMK计算机图形学实验室 MV Lomonosov不仅对俄罗斯计算机图形学的发展做出了贡献

- 视频小组的同事们,感谢您看了这篇文章,

- Konstantin Kozhemyakov亲自做了很多工作,使本文变得更好,更直观,

- 乔恩·卡拉芬(Jon Karafin)担任利特罗(Lytro)光场视频负责人时,由于这个原因,我们几乎开始着手改进其产品(并且出于我们无法控制或出于我们的原因而没有开始),

- Lytro为他们在光场的普及及其功能方面的贡献做出了贡献,并抓住了下降的信号; Google和其他基于这种有趣技术制造产品的公司,

- 最后,非常感谢Sergey Lavrushkin,Roman Kazantsev,Ivan Molodetsky,Evgeny Kuptsov,Yegor Sklyarov,Evgeny Lyapustin和Denis Kondranin所作的许多明智的评论和更正,使本文更加完善!