为什么经典的自动车是不可能的并且没有商业前景

那些至少了解汽车创新技术的人都深知,成熟的自动驾驶汽车应该在道路上行驶很长一段时间。 但是他的出现每5年一次,不断地转移了另外5年。 显然,事情出了问题,甚至最顽固的乐观主义者也被模糊的怀疑折磨,而那些记得“人工智能的冬天”的人,则普遍陷入困境。

人工智能陷入了理解的障碍 。 显而易见,如果无限能力的Google(Weimo)在10年内除了昂贵的玩具之外什么也没做,那么现在该认识到利用当前的人工智能技术,这是一款成熟的商用五级自动车(AA)不可能做。 间接地,这甚至在Weimo本身中也得到认可,并且在2018年12月的最后一次测试中

(Waymo在美国推出了有偿无人驾驶出租车服务),驾驶员

被放回了方向盘(每辆车中,以防万一,驾驶员将被放倒在方向盘上以便他们对力做出反应) -重大情况或无人系统的故障)。 而在2019年,成熟的AA距离我们越来越远,而不是越来越近,不再有很多缺点

(第5级越来越远,而不是越来越近) 。

在本文中,我们将分析在多次尝试创建经典AA的过程中出现的不可克服的障碍。 也就是说,我们将谈论今天的真实情况,而不是谈论N年中光明前景的广告承诺。

什么是自动车(AA)?

在外行看来,这是由计算机控制的汽车,即某种人工智能(AI)。 因此,显而易见的解决方案是:制作

普通的 AI,将其连接到一个旋转立体摄像机,将其安装在任何汽车上,将其发送到普通的驾驶培训课程中,并聘请合格的驾驶员。 但是,我们看不到这个决定附近的任何事情。 也就是说,现有的AI无法与驾驶员竞争。 因此,AA的开发人员被迫作弊,提供了一种替代(一堆昂贵的传感器,不了解做什么和如何做的神经网络,等等)。 请注意,所有这些都是

临时解决方案,直到出现成熟(强大)的AI。 随着这些技术的问世,所有这些昂贵的雷达和激光雷达将被不必要地丢弃(一个人没有它们)。 也就是说,创建AA的经典方法本身就带有某种欺骗性。 让我们找出原因。

让我们从定义开始,什么是第五级成熟的AA? 所谓的自动驾驶综合体(ACS)是指能够在实际道路条件下驾驶具有普通驾驶员特征的汽车。 问题立即出现-这样的“普通驾驶员”是什么样的野兽? 这是医院的平均温度吗? 但是,我建议将解决此问题的方法留给公关经理,并大大简化任务,将AA与仅获得驾驶执照并因此可以使用公共道路的

新手驾驶员的水平进行比较。

也就是说,我们将比较新手驱动程序和最先进的自动驾驶仪,甚至不是某些特定的自动驾驶仪,而是在当前技术开发水平上最有可能的驱动程序。 为此,您需要构建一个对照表,其中包含驾驶新手驾驶员和最完美的自动驾驶仪的所有特征。

我们看到了什么? 从原则上说,AA(责任制)甚至无法达到新手的水平。 也就是说,严格来说,经典的AA甚至从理论上讲都

无法达到新手的水平。

也许她,这个责任? 让我们做对。 我们看到,即使自动驾驶仪的潜在特性也是“好”,但不是“优秀”。 因为到处都有

不可克服的限制。 简要地:

控制的准确性取决于有关路面的信息。 在一般情况下,此信息不完整。

一般情况下,对道路状况的评估是基于不完整的信息,因此不能准确。

通常不可避免地缺乏信息的决策本质上是概率性的,即使在理论上也不能保证是正确的。

结果,很明显,即使是理想的自动驾驶仪,也无法从理论上保证事故的发生。

那么谁来为不可避免的交通事故受害者负责呢?

因此,当下一位PR专家告诉您成熟的AA已经完全准备就绪时,但这只是古法的问题,请不要相信。

如果制造商承担起人类责任的责任,那么法律将立即改变 。 但是现实是,还没有真正的机管局,“伪造品”中已经有尸体,没有人愿意为他们作答。 马斯克说他与这无关 并且有必要不相信Ilon Mask和广告,而是相信最后写成小字体的东西(

所有责任都由

驾驶员承担 )。

因此,经典AA的责任问题甚至无法从理论上解决。 因此,

即使从理论上讲 ,完整的

经典AA也是不可能的 。

顺便说一句,这并不意味着它不能被制造或出售,它意味着

首先 ,您将必须以某种方式解决责任问题,或者以出售方式摆脱这种责任。

在这里,我们知道以自然的方式(没有直接的状态指令)很难做到这一点。

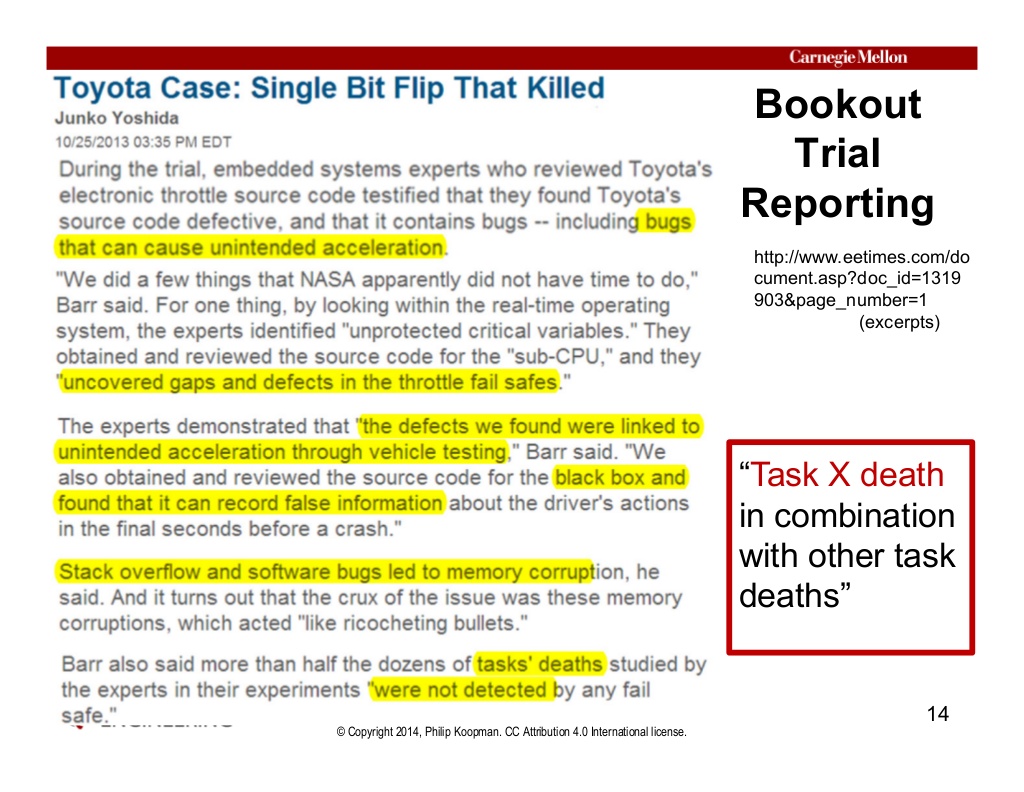

而且,问题更加严重。 责任,这是建立内的结果。 但这是一个大问题。 一方面,AA上存在黑匣子简化了该任务,另一方面使它复杂化,因为来自AA制造商的

所有信息都是来自相关方的信息。 您不必走太远,例如:自然地,将汽车切换为柴油门模式并没有反映在日志中。 甚至更糟的是,可以在日志中故意写入虚假信息。 这是油门踏板踩踏调查的报告页面:

报告的幻灯片14-驾驶员单击的内容可能出现黑框。

然后,AA制造商是特定州的公司,州会以哪种方式支持该州,最后要注意事实。 例如,在非常相似的情况下,丰田和通用汽车,美国当局做出了截然不同的决定。

让我简短地提醒您,那里到那里都有一个技术缺陷,他们了解他,他们躲藏了很长时间,并且谈论此事的人都被解雇了。

PR专家没有告诉我们如何解决此问题。

但是,假设我们仍然认为AA有罪。 接下来要做什么? 我们需要找出原因,但是在这里我们了解到当前的伪III,即神经网络,原则上不能解释为什么做出了错误的决定,从而导致了事故。

关于神经网络的一点题外话。 他们的问题对于

“人工智能的复兴”领域的专家来说是众所周知的,

无非就是为了实施旧观念而投入的昂贵硬件和广告 。 许多人已经开始公开谈论AI的第二个冬天。 如果您用手指进行解释,那么您需要了解有关神经网络的一件事:这些只是多维统计。 不多,但不多。 因此,它们的功能和局限性显而易见:

- 像任何统计信息一样,它们非常依赖于输入数据,也就是说,即使输入数据中的微小变化也可能严重改变最终结果。

- 由于这是经验性的,而不是分析性的,而且是多维的,因此开发人员原则上不理解神经网络如何工作以及哪些元素会影响什么。 这可以通过任何复杂的经验公式来说明,该公式是具有许多系数的多项式。 通常不可能理解特定系数负责什么以及如何起作用,否则就有可能编写一个简单的分析公式。

- 从前两点来看,输入数据的任何更改都需要对整个系统进行全面测试。 否则,事实证明,通过更正一个错误,我们可以添加以前不存在的其他错误。 也就是说,过去的测试结果失去了意义。

- 足够的原始数据收集在组织和经济上都是无法承受的。

结果,传统的故障排除方法不起作用。 结果,该软件的每个新版本都不会比以前的版本更好。 然后如何认证AA?

但是,我们所有人都是在这样的假设下考虑这种情况的,即从技术角度来看,理想的机管局已经存在。 但这远非如此。 这里有几个原因,如果没有终止经典方法,则每个原因

至少都会推迟决策并增加最终AA的成本 。 而且他现在非常昂贵。

不可能从车上看到一切

经典的问题根本无法解决,因为根本就没有钱的传感器。 因此,在一般情况下,机管局必须在缺乏信息的情况下做出决策,也就是说,想想即将发生的事情。 一个人对这些想法负责,而一台计算机呢? 请注意,根据实际责任,具有相同经验和资格的同一个人在实际道路和汽车模拟器上

会做出根本不同的决定 。 而且,如果驾驶员仍然被迫为大量乘客接听电话,那么他就必须获得另一类驾驶执照。 因此,

责任是基本的管理准则,其他管理特征直接依赖于此 。 传统的机管局完全没有这个关键标准。

甚至没有完全的人工智能,也没有完全的人工意识,就不可能做出决定。

在危险情况下,这通常是必需的。 例如,遵循书面规则(我们直接刹车)和不成文的规则(我们搁在一边)会导致事故。 向左绕行,出口驶向迎面驶来的车道,可避免发生事故。 显然,没有完全的人为意识的问题无法解决,因为它需要在缺乏信息的情况下做出

有意违反交通规则的决定。 鉴于真正缺乏信息和概率预测,谁将对后果负责?

没有正确的道路

很容易猜到,解决机管局和驾驶员之间冲突情况的问题不能得到明确解决(一个人总是声称他同意与另一个人互动)。 由于法官不太可能是客观的,因此在法庭上解决该问题非常成问题。 因为法官可能会代替人的驾驶员,但永远不会代替驾驶员计算机。

原来所有不适合主人的跳过情妇

只能为严格遵守交通规则而对真实AA进行编程,但不幸的是,

严格遵守交通规则并没有歧义。 因此,机管局会肥大以遵守“以愚者行事”的规则。 当然,傻瓜驾驶员会使用它,从而减少了有罪不罚的AA。 而且他会刹车,让

所有人前进。 机管局局长多久会感到无聊?

无法保证安全(它们不会崩溃到您体内)

没有安全解决方案的手推车问题会通过机管局的故障

向受害者

提供保证 。 自然,无业的专业驾驶员会利用任何事故对当局施加政治压力,以禁止AA。 但是这些都是真正的选民。

低的可靠性和抗干扰性

绝对所有的AA传感器都容易被卡住或欺骗。 因此,禁用道路任何部分上的所有AA是非常简单且便宜的。 我们为孩子们提供自行车的“激光反射器”,并要求他们沿着马路骑行。 我们将WiFi,GPS,白噪声从一架直升机上散射到树木上。 我们绘制“原始”道路标记。 我们稍微修改一下路标,使普通的摄像头迷惑,

特斯拉可能会从Arduino那里骗取40美元的套件,以及会产生声波的超声波发射器-汽车将无法找到自由的停车位或错过真正的障碍物 。 便宜又有效。 而且我们根本不考虑黑客! 这些只是新奇石。

专业的驾驶员绝对反对并且会灰心

因此,通过简单而廉价的干扰(例如简单的电子战),您可以保证停止任何防空导弹。 在这种情况下,即使从理论上讲也无法工作,但是驾驶员

可以 。 尝试提出至少一个为什么没有工作的人不会使用此方法的原因。 但是没有人需要可以无限期地停止的运输。 出租车司机,这是目前抬高价格的人,将迅速把想要节省AA出租车的人数减少到零。

骇客

即使到现在,来自几十个国家的数百家公司也都获得了AA。 如何检查,认证和服务所有这一切? 但是,您如何认证不断更新的软件? 如何保证下一个冒犯的员工没有泄漏访问密码? 将来,所有自动驾驶仪都将在省级汽车服务中心进行维修。 如何控制将在那里安装哪些固件? 谁负责这些固件? 驾驶员会说他们将其投入使用,而我对神的激活模式一无所知,我认为每个人都是如此。 就是说,存在大量的安全问题,无论怎么说,经典的AA只是黑客的梦想!

黑客的好目标_如何欺骗人工智能并使他做出危险的决定底线:对于经典的AA,目前存在许多技术和法律问题,目前尚无可接受的解决方案 。 理论上,当然,所有问题都可以解决或“解决”,但这将需要大量时间和金钱。

在这里,我们跌倒了。 也就是说,来自“哇! 机管局“到”宴会,宴会由谁出钱? 实际上,AA价格标签中没有包含许多重要的额外费用:

- AA本身。 它只是昂贵,但至少是诚实的。

- 准确的高分辨率地图。 以及如何保持它们的相关性? 有两种方法,两者都不好。 首先,将公司本身组装成AA制造商。 但是,您需要多少辆车? 第二种方法,让汽车自己组装。 但是如何确定此数据的可靠性(而不是黑客或竞争对手试图向您的神经网络传授坏消息)。 也就是说,必须认真检查这些数据,并且所有检查都需要金钱。 但是这些卡片在一般情况下的实际相关性问题根本不能解决任何金钱问题 。

- 这些准确的卡需要通过无线网络加载,否则,原则上它们是不相关的。 因此,事实证明,我们仍然到处都需要宽带Internet,即使在联邦高速公路上,我们也到处都没有蜂窝通信。 由谁来承担? 请注意,即使特斯拉罕见的更新也只能通过免费WiFi进行。 这并不是说根本不说。 但是在最好的情况下,这里到处都是小字体,并且始终没有指定价格。

- 4)意外险。 出于某种原因,人们认为保险可以解决责任问题。 但是事实并非如此,保险只是将责任分配给了许多无辜的人。 当然,特斯拉的所有者不希望对无人驾驶的卡马兹的错误负责,反之亦然。 很难说情况如何,但是在最初阶段,该保险是高额的(每辆车在加利福尼亚进行测试需要花费数百万美元)。 然后是经典的恶性循环(小AA,昂贵的保险,昂贵的保险,很少的AA)。 此外,关于经典AA比人更安全的说法并不是基于任何事实,因为它们不能基于缺乏真正AA的观点 。

机管局的经济效率神话来自何方?

乍一看,显然,我们节省了驾驶员,节省了他的薪水。 但实际上,并非一切都那么简单。 毕竟,我们不只是丢掉司机,我们丢人。 对于卡车,汽车中

唯一的人。 但这是一个强盗的梦想! 我们抑制交流,模拟事故,在空旷的道路上停下无人货车。 我们装载货物,卸下激光雷达,雷达等。 我们放火离开。 所有这一切甚至可以不归类为盗窃,而是流氓行为。 那里没有人,所以没有抢劫。

我们摘下激光雷达进行实验。 货物被随机人偷走了。 应对这种情况非常困难。 由于攻击者会经常在许多地方阻塞连接,因此实际上不可能为每种情况都派出防暴警察。

将防御设备放在车上也不是一种选择,因为您将对被袭击者特制的死去的孩子负责。

因此,无论如何应该是一个人。是的,它可能不是驱动程序,而是转发器。但是一个人的存在不可避免地需要一种劳逸结合的制度。也就是说,AA的主要优点是全天候工作消失了。而且,例如,有几辆货车紧紧地紧追黑客,并在很长一段时间内完全挡住了道路,例如一辆救护车?也就是说,在可预见的将来,每辆车应该成为一名司机。就是说,甚至不可能有一位司机陪着他,而由两位司机来工作。是的,当然,可以降低他的薪水,因为只有在自动驾驶仪上才需要他。但这使人想起了需要多挤牛奶但少喂奶的原则。司机的薪水根本无法降低,在美国,现有薪水严重缺乏司机。还有另一个问题:如果汽车在大多数情况下处于标准条件下会自动驾驶,那么驾驶员将很快失去技能。在自动驾驶仪无法应付的情况下,具有这么低资格的他如何能够在困难的条件下驾驶?飞机自动驾驶仪是众所周知的问题。是的,它可以通过模拟器,考试等系统成功解决。但是,这些费用也必须添加到AA估算中!而且仍然存在潜在的计划外维修(更换车轮)等问题。中间结论:经典AA的经济获利能力这一概念远没有人们普遍认为的那么明显。请注意,在对旅行车的卡车移动进行成功的广泛测试之后,已经过去了三年,尽管旅行车的移动技术没有技术或法律问题,但该技术尚未实现商业化。经典的自动车会增加交通拥堵并使规则复杂化:

但是,让我们假设上述所有问题都得到了奇迹般的解决,并且我们拥有完全的AA第五级自主权,而没有方向盘和踏板。哇!哇!但是谁需要他,谁为他付出呢?自然,该过程不会立即发生,并且肯定会来回遇到这些害羞的人,但是引入经典AA的逻辑如下:- 该技术在自动出租车中最有效。

- 司机薪水不足会大大降低旅行价格。

- 这将大大增加对公共交通乘客的需求。Uber证明,廉价出租车不是从私家车转移,而是从公共交通工具转移。

- 根据Uber模型,满足需求后,企业和私人业主将大幅增加自动出租车的数量。

- , ( 80% , ).

- , , ( ). , , ( , ).

- ( Vision Zero). , ! , , .

- ( , , , ). , .

, :

- , « ». , - - . , , - . , . , , .

- , « ». «» , , .

- , . , , , .

- , .

« », , . , . , .

, Vision Zero .

,

_ ,

, LSE Cities_ — , , ,

, , 。但是,没有人试图不谈这将不可避免地导致什么。这是一种“专业效果”,因为只有专业人士才能知道这些问题,但是如果他们大声谈论经典AA的徒劳,投资者将停止向这些专业人士支付经典AA的无用技术的钱。而且他自己的衬衫更贴近身体。结论:成熟的经典AA具有大量的安全问题,包括技术,经济,交通拥堵,法律等。在目前的技术发展水平上,大多数这些问题根本没有解决方案,而且,即使这些问题的存在也被仔细地掩盖了。因此,真正的商业机管局第五级的出现被搁置了。问题本身是,是否有可能使用成熟的经典AA来回答两个问题:- 经典的机管局能否保证在交通事故中完全没有死亡?

- 如果没有,那么谁将对受害者负责?

如果没有对这些问题的法律上重要的答复,那么经典的AA仍将是昂贵的玩具。也就是说,您可以做经典的AA,但不可能做。PS这是ITS SPRUT描述周期的第三篇文章,此处是第一篇文章。这是通过对道路安全的经典方法和经典的AA的创建来分析当前状况的结尾,在下一篇文章中,我将开始详细描述如何完全解决所有这些问题。