与人类不同,卷积神经网络在分类失真图像方面做得很好。

在本文中,我将展示先进的深度神经网络为何能够完美识别失真的图像,以及这如何帮助揭示神经网络用于对自然照片进行分类的惊人简单策略。 这些发现

发表在ICLR 2019上,产生了许多后果:首先,它们证明,找到“

ImageNet ”解决方案比想象的要容易得多。 其次,它们帮助我们创建了更易于理解的图像分类系统。 第三,他们解释了在现代卷积神经网络(SNA)中观察到的几种现象,例如,它们寻找纹理的趋势(请参阅ICLR 2019中的其他

工作和相应的

博客条目 ),而忽略了对象各部分的空间排列。

好的老款“包包”

在过去的好日子里,在深度学习出现之前,自然图像的识别非常简单:我们定义了一组关键的视觉特征(“单词”),确定每个视觉特征在图像(“袋”)中出现的频率,并根据这些图像对图像进行分类数字。 因此,计算机视觉中的此类模型称为“单词袋”(word-of-words或BoW)。 例如,假设我们有两个视觉特征,人眼和钢笔,并且我们想将图像分为两类:“人”和“鸟”。 最简单的BoW模型是这样的:对于图像中发现的每只眼睛,我们将对“人”的证词增加1。反之亦然,对于每只笔,我们将对“鸟”的证言增加1。哪个类别获得更多的证据,就是这样。

这样简单的BoW模型的一个便利属性是决策过程的可解释性和清晰度:我们可以准确地检查图像的哪些特定特征对特定类别有利,特征的空间整合非常简单(与深度神经网络中特征的非线性整合相比),因此只需了解模型如何做出决策即可。

传统的BoW模型非常受欢迎,并且在入侵深度学习之前非常有效,但是由于效率相对较低,很快就过时了。 但是我们确定神经网络使用与BoW根本不同的决策策略吗?

具有袋功能的深度解释网络(BagNet)

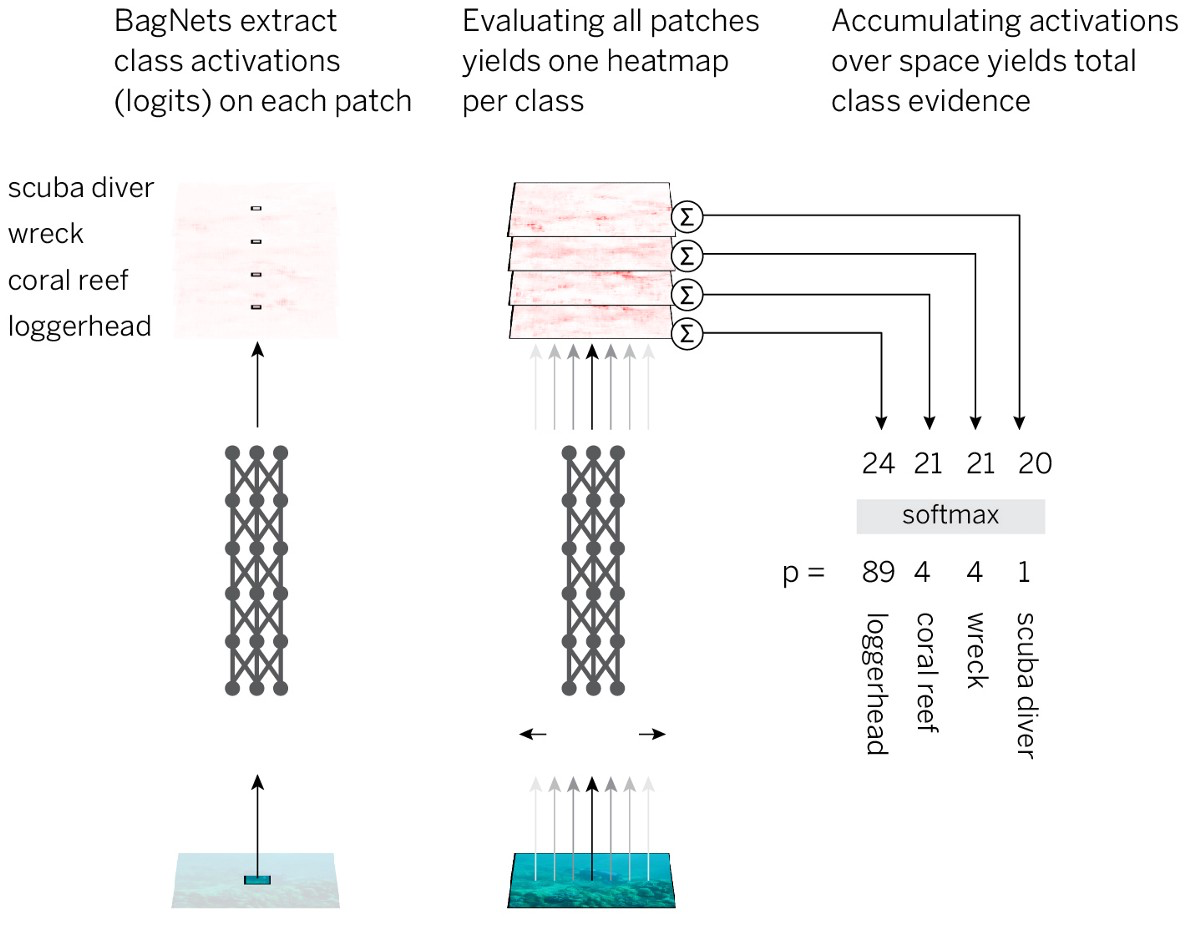

为了验证这一假设,我们将BoW模型的可解释性和清晰度与神经网络的效率相结合。 该策略如下所示:

- 将图像分成小块qx q。

- 我们通过神经网络传递这些片段,以获得每个片段的类成员资格(登录)证据。

- 总结所有方面的证据,以得到整个图像层面的解决方案。

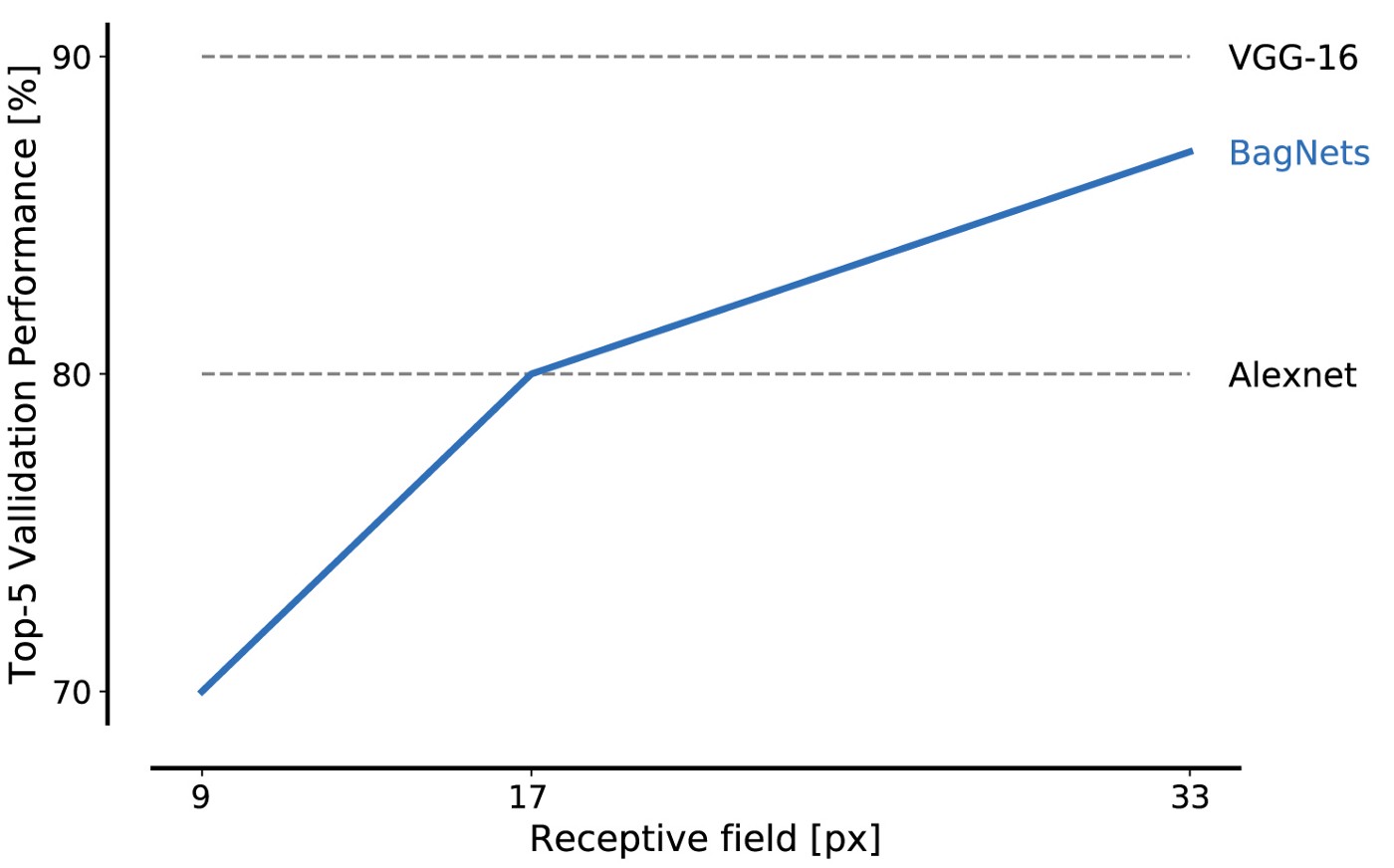

为了以最简单的方式实施此策略,我们采用标准的ResNet-50架构,并用1x1卷积替换几乎所有3x3卷积。 结果,最后一个卷积层中的每个隐藏元素仅“看到”图像的一小部分(也就是说,它们的感知范围远小于图像大小)。 因此,在应用预先计划的策略的同时,我们避免了图像的标记,并尽可能接近标准SNA。 我们将结果架构称为BagNet-q,其中q表示最顶层的感知字段的大小(我们用q = 9、17和33测试了模型)。 BagNet-q的运行时间比ResNet-50长约2.5。

即使使用小块,BagNet在ImageNet数据库数据上的性能也令人印象深刻:17x17像素的片段足以达到AlexNet级别的效率,而33x33像素的片段足以达到87%的精度,进入前5名。 您可以通过更仔细地放置3x3软件包并调整超参数来提高效率。

这是我们的第一个主要结果:ImageNet只能使用一组小的图像功能来解决。 可以完全忽略合成物各部分的遥远空间关系,例如对象的形状或对象各部分之间的相互作用; 绝对不需要它们来解决问题。

BagNet'ov的显着特征是其决策系统的透明度。 例如,您可以找出给定类别的图像的哪些特征最有特色。 例如,丁ch(一条大鱼)通常通过绿色背景上的手指图像识别。 怎么了 因为在该类别中的大多数照片上,都有一个渔夫举着丁字裤作为他的奖杯。 当BagNet错误地将图像识别为线条时,通常会发生这种情况,因为照片中的某处绿色背景上有手指。

图像最具特色的部分。 每个单元格的最上面一行对应正确的识别,最下面一行对应导致注意力不正确的分散注意力的片段

图像最具特色的部分。 每个单元格的最上面一行对应正确的识别,最下面一行对应导致注意力不正确的分散注意力的片段我们还获得了准确的“热图”,该图显示了图像的哪些部分有助于决策。

热图不是近似值;它们可以准确显示图像各部分的贡献。

热图不是近似值;它们可以准确显示图像各部分的贡献。BagNet的演示表明,仅当图像的局部特征与对象类别之间的统计相关性较弱时,使用ImageNet才能获得较高的准确性。 如果这足够了,那么为什么标准的ResNet-50神经网络会学到根本不同的东西? 如果图像的大量局部特征足以解决问题,为什么ResNet-50应该研究复杂的大规模关系(例如对象的形状)?

为了检验现代SNA遵循与最简单的BoW网络类似的策略的假设,我们在BagNet的以下“标志”上测试了不同的网络-ResNet,DenseNet和VGG:

- 这些解决方案与图像特征的空间改组无关(只能在VGG模型上检查)。

- 图像不同部分的修改不应互相依赖(就它们对类成员的影响而言)。

- 标准SNA和BagNet'ami所犯的错误应该相似。

- 标准的SNS和BagNet应该对相似的功能敏感。

在所有四个实验中,我们发现SNS和BagNet的行为惊人地相似。 例如,在上一个实验中,我们表明BagNet对图像中与SNA相同的位置最敏感(例如,如果它们重叠)。 实际上,BagNet热图(空间敏感性图)比通过归因方法(例如DeepLift)(直接计算DenseNet-169的热图)获得的热图更好地预测DenseNet-169的敏感性。 当然,SNA不能完全重复BagNet的行为,但可以证明存在某些偏差。 尤其是,网络越深入,特征的尺寸就越大,依赖关系就越扩展。 因此,深度神经网络确实是对BagNet模型的改进,但是我认为它们的分类基础并没有发生任何变化。

超越BoW分类

以BoW策略的方式观察SNA决策可以解释SNA的一些奇怪特征。 首先,这解释了为什么SNA如此

依赖纹理 。 其次,为什么SNA对

混合图像的部分不敏感。 这甚至可以解释对抗性贴纸和对抗性干扰的存在:令人困惑的信号可以放置在图像中的任何位置,并且SNS一定会捕获此信号,而不管其是否适合图像的其余部分。

实际上,我们的工作表明,SNA在识别图像时会使用许多薄弱的统计规律,并且不会像人们那样在对象级别上对图像的某些部分进行整合。 其他任务和感觉方式也很可能如此。

我们需要仔细计划我们的体系结构,任务和培训方法,以克服使用弱统计相关性的趋势。 一种方法是将SNA训练的失真从较小的局部特征转换为更全局的特征。 另一个是删除或替换神经网络不应依赖的那些功能,我们在ICLR 2019的另一

本出版物中做了此操作,使用样式转换预处理来消除自然物体的纹理。

但是,最大的问题之一仍然是图像的分类:如果局部特征足够了,就没有动机去研究自然界的真实“物理学”。 我们需要以移动模型来研究对象的物理性质的方式来重组任务。 为此,最有可能的是,您将不仅仅是纯粹的观察性教学,而是输入和输出数据的相关性,以便模型可以提取因果关系。

在一起,我们的结果表明SNA可以遵循一个非常简单的分类策略。 可以在2019年做出这样的发现的事实强调了我们对深度神经网络工作的内部特征仍然知之甚少。 缺乏理解不允许我们开发从根本上改进的模型和体系结构,从而弥合人与机器之间的感知鸿沟。 加深了解将使我们能够发现缩小这一差距的方法。 这可能非常有用:尝试将SNA转向对象的物理属性,我们突然实现

了对人类水平的

抗噪声能力 。 我希望在SNA的发展道路上还会出现许多其他有趣的结果,这些结果真正地理解了我们世界的物质和因果关系。