近年来,人们对机器学习模型的兴趣增加了,包括对视觉图像和面部的识别。 尽管这项技术远非完美,但它已经可以让您计算犯罪分子,在社交网络上查找个人资料,跟踪更改等等。 Simen Thys和Wiebe Van Ranst证明,仅对卷积神经网络的输入信息进行较小的更改,就可以替换最终结果。 在本文中,我们将研究进行识别攻击的视觉补丁。

对识别系统的首次攻击是输入图像像素的微小变化,以欺骗分类器并得出错误的分类。

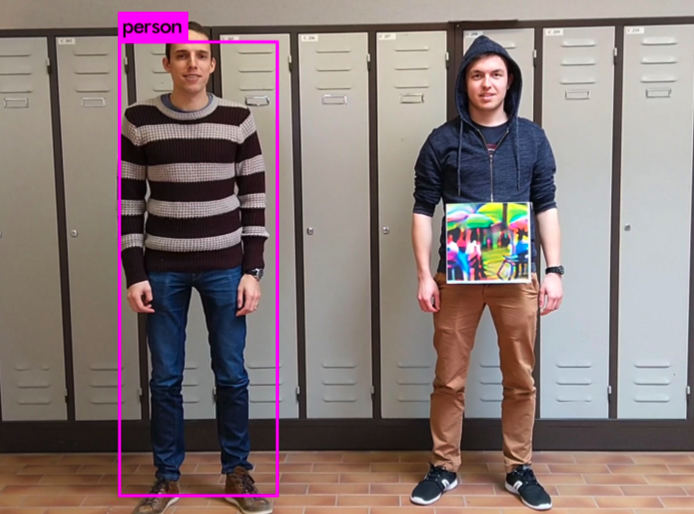

目的是创建一个可以成功将人员隐藏在检测器中的补丁。 结果是一种可以用于例如绕过监视系统的攻击方案。 攻击者可以无意识地偷偷溜走,他们将一个带有“补丁”的小纸板平板对准自己的监视摄像机。

卷积神经网络

卷积神经网络 (SNA)的发展已在计算机视觉领域取得了巨大的成功。 在其中对SNA进行图像训练的数据驱动的端到端传送带已在各种计算机视觉任务中显示了最佳结果。 由于这些架构的深度,神经网络能够研究位于网络底部(数据输入的地方)的最基本的过滤器,从而在顶部实现抽象的高级功能。 为此,典型的SNA包含数百万研究的参数。 尽管这种方法可以得出非常准确的模型,但可解释性却大大降低了。

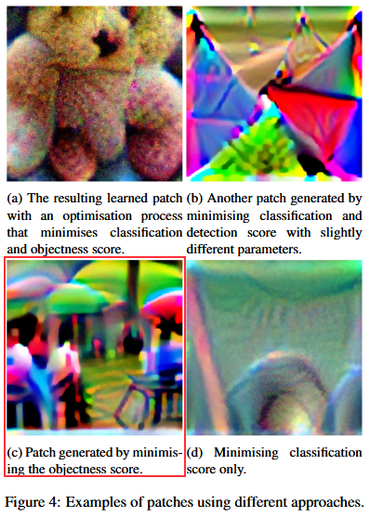

在研究中,各种各样的图像被用来欺骗监视系统,包括抽象的“噪声”和模糊。

为了创建补丁,使用了原始图像,该图像经过以下转换:

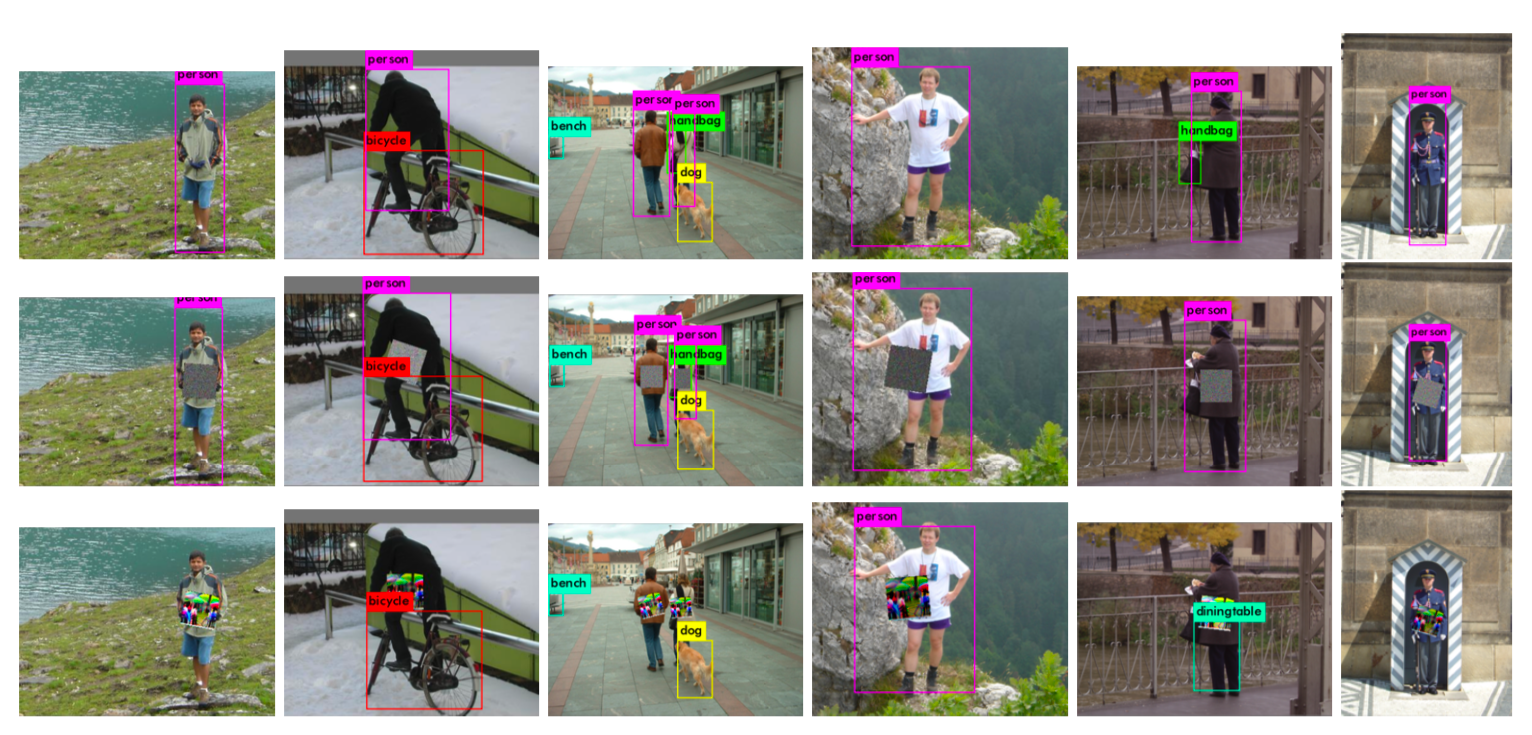

研究人员进行了许多

Inria测试,以确定一个人的最佳“隐蔽性”。

为了获得理想的效果,应将40x40厘米的图像(由专家报告中的单词补丁指示)放置在相机检测框的中间,并始终位于其视场中。 当然,该方法不会帮助人遮住脸,但是,原则上,用于检测人的算法将无法检测到帧中的人,这意味着后续的面部特征识别也不会启动。

作为演示,研究人员发布了有关视频补丁功能的视频演示:

GitHub项目代码。

研究 。